20170315 deeplearning from_scratch_ch01

- 1. Tomomi Research Inc. Ch01. Python (Python╚ļķT) 2012/03/13 (Mon) Seong-Hun Choe

- 3. Tomomi Research Inc. Class 2017/9/11 class Man: """źĄź¾źūźļź»źķź╣""" def __init__(self, name): self.name = name print("Initilized!") def hello(self): print("Hello " + self.name + "!") def goodbye(self): print("Good-bye " + self.name + "!") m = Man("David") m.hello() m.goodbye() C:/Users/SChoe672007022/Dropbox /Python/deep-learning-from- scratch-master/ch01/man.py Initilized! Hello David! Good-bye David! Process finished with exit code 0

- 4. Tomomi Research Inc. Perceptron -> Neural Network 2017/9/11 ųąķgīėŻ║Hidden Layer

- 5. Tomomi Research Inc. Review: Perceptron 2017/9/11

- 6. Tomomi Research Inc. Review: Perceptron : Activate Function 2017/9/11

- 7. Tomomi Research Inc. Activate Function ╗Ņąį╗»ķv╩²Ż║ķōéÄż“Š│ż╦żĘżŲ│÷┴”ż¼ŪążĻ╠µż’żļķv╩²ĪŻ 2017/9/11 1. Step Function 2. Sigmoid Function

- 8. Tomomi Research Inc. Activate Function : New Star 2017/9/11 3. ReLu Function ReLU : Rectified Linear Unit ź└źżź¬®`ź╔ż╬IV╠žąįż╬╦ŲżŲżżżļż½żķ

- 9. Tomomi Research Inc. Multiplying the Matrix 2017/9/11

- 10. Tomomi Research Inc. Neural Network 2017/9/11 [X] [W] [Y] ? = ?1 ?2 ? = 1 3 5 2 4 6 ? = ?1 ?2 ?3 [X][W] = [Y] ?1 ?2 1 3 5 2 4 6 = ?1 ?2 ?3

- 11. Tomomi Research Inc. 3 Layer Neural Network 2017/9/11 Input layer (Oth layer) 1st hidden layer (1st layer) 2nd hidden layer (2nd layer) Output layer (3rd layer)

- 12. Tomomi Research Inc. 3 Layer Neural Network 2017/9/11 Original Adding bias Adding Activate function

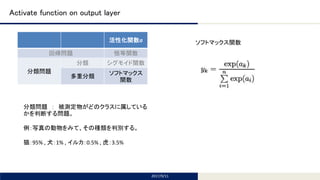

- 13. Tomomi Research Inc. Activate function on output layer 2017/9/11 ? ÖCąĄč¦┴Ģż╬å¢Ņ}żŽĪó┤¾żŁż»Ęųż▒żŲŻ▓ĘNŅÉ 1. ╗žÄóå¢Ņ} Ż©Regression ) 2. ĘųŅÉå¢Ņ} Ż©Classfication) ╗Ņąį╗»ķv╩²”ę ╗žÄóå¢Ņ} ║ŃĄ╚ķv╩² ĘųŅÉå¢Ņ} ĘųŅÉ źĘź░źŌźżź╔ķv╩² ČÓųžĘųŅÉ źĮźšź╚ź▐ź├ź»ź╣ ķv╩²

- 14. Tomomi Research Inc. Activate function on output layer 2017/9/11 ╗Ņąį╗»ķv╩²”ę ╗žÄóå¢Ņ} ║ŃĄ╚ķv╩² ĘųŅÉå¢Ņ} ĘųŅÉ źĘź░źŌźżź╔ķv╩² ČÓųžĘųŅÉ źĮźšź╚ź▐ź├ź»ź╣ ķv╩² ╗žÄóå¢Ņ}Ż║ ╚ļ┴”źŪ®`ź┐ż½żķ▀BŠAĄ─╩²éÄż“ ėĶ£yż╣żļå¢Ņ}ĪŻ └²ż©żąĪóą┤šµż╦ą┤ż├żŲżżżļ╚╦╬’ż╬╠Õųž Ż©54.7kg)ż“ėĶ£yż╣żļĪŻ ║ŃĄ╚ķv╩²

- 15. Tomomi Research Inc. Activate function on output layer 2017/9/11 ╗Ņąį╗»ķv╩²”ę ╗žÄóå¢Ņ} ║ŃĄ╚ķv╩² ĘųŅÉå¢Ņ} ĘųŅÉ źĘź░źŌźżź╔ķv╩² ČÓųžĘųŅÉ źĮźšź╚ź▐ź├ź»ź╣ ķv╩² źĮźšź╚ź▐ź├ź»ź╣ķv╩² ĘųŅÉå¢Ņ} Ż║ ▒╗£yČ©╬’ż¼ż╔ż╬ź»źķź╣ż╦╩¶żĘżŲżżżļ ż½ż“┼ąČŽż╣żļå¢Ņ}ĪŻ └²Ż║ą┤šµż╬äė╬’ż“ż▀żŲĪóżĮż╬ĘNŅÉż“┼ąäeż╣żļĪŻ ├©Ż║95% , ╚«Ż║1% , źżźļź½Ż║0.5% , ╗óŻ║3.5%

- 16. Tomomi Research Inc. Number of neurons at output layer 2017/9/11 In case of reading handwriting numbers. the # of neurons will be 10. (0,1,2,ĪŁ 9)

- 17. Tomomi Research Inc. żżżĶżżżĶMNIST 2017/9/11 Handwritten digits : forward propagation in neural network https://rstudio.github.io/tensorflow/tutorial_mnist_beginners.html * Mixed National Institute of Standards and Technology database

- 18. Tomomi Research Inc. Training with Python 2017/9/11

- 19. Tomomi Research Inc. Summary 1. Activate function at NN : Sigmoid, ReLU function 2. ╗žÄóå¢Ņ}Īó ĘųŅÉå¢Ņ} 3. │÷┴”īėż╬╗Ņąį╗»ķv╩²Ż║╗žÄóå¢Ņ} ║ŃĄ╚ķv╩²Īó ĘųŅÉå¢Ņ} źĮźšź╚ź▐ź├ź»ź╣ķv╩² 4. ĘųŅÉå¢Ņ}żŪż╬Īó│÷┴”īėż╬ź╦źÕ®`źĒź¾ż╬╩² 5. MNISTīgū░ 2017/9/11

![Tomomi Research Inc.

Neural Network

2017/9/11

[X] [W] [Y]

? =

?1

?2

? =

1 3 5

2 4 6

? =

?1

?2

?3

[X][W] = [Y]

?1

?2

1 3 5

2 4 6

=

?1

?2

?3](https://image.slidesharecdn.com/20170315deeplearningfromscratchch01-170911034351/85/20170315-deeplearning-from_scratch_ch01-10-320.jpg)