CVPR 2015 読み会 "Understanding Deep Image Representations by Inverting Them"

- 1. CVPR 2015 読み会 ! A. Mahendran and A. Vedaldi Understanding Deep Image Representations by Inverting Them 加藤大晴 http://hiroharu-kato.com/

- 2. 自己紹介 ? 加藤 大晴 (かとう ひろはる) ? 2014/04- ソニー株式会社(音響信号処理) ? 2014/03 修士(情報理工学)東京大学 原田研究室 ? http://hiroharu-kato.com/ ? @hiroharu_kato など ? 本発表は所属組織とは一切関係ありません ? 以降, 論文に記載のない内容については を付けます

- 3. 論文の概要 ? A. Mahendran and A. Vedaldi. Understanding Deep Image Representations by Inverting Them. ? CNN の出力を画像へと逆変換する手法を提案 ? ついでに SIFT と HOG も逆変換 ? いろいろ画像を再構成して観察 ? 手法: 誤差逆伝播で重みではなく入力画像を最適化 ? モチベ: CNN が何を捉えているか理解したい 元画像 再構成1 再構成2 再構成3

- 4. 読んだ動機 ? 加藤の修士論文:? Image Reconstruction from Bag-of-Visual-Words (CVPR 14) ? BoVW を画像へと再変換 ? ついでに識別器の分析や画像の生成 ? 修論の反省 ? Bag-of-Visual-Words は相当時代遅れ ? そもそも画像再構成の役立て方がよくわからない

- 5. なぜ画像再構成? ? 画像特徴の性質について, 我々は実はよく知らない ? とりあえず実験的に良い性能が出ればOK ? 特にニューラルネットワークでは顕著 ? 画像特徴って実のところ何を捉えているんだろう? ? 画像特徴から画像を再構成してみれば? 画像特徴に残されている情報が感覚的にわかるのでは?

- 6. 既存の画像再構成の例 ? HOG 特徴の視点からは誤識別しても仕方ない? ? ? ? Bag-of-Visual-Words にも局所既述子の位置情報は? (潜在的に)残されている [Vondrick+ 13] [Kato+ 14]

- 7. 提案手法 (1) ? 一般的な画像識別器の学習 ? 画像 x とその教師ラベル y を与え,? 最適なネットワークのパラメータ w を求める ? これは誤差逆伝播法で効率的に解ける ? 本論文での画像の再構成 ? 教師ラベル y と ネットワークのパラメータ w を与え,? 最適な画像 x を求める ? これも誤差逆伝播法で効率的に解ける! Lは Cross Entropy 誤差 Lは2乗誤差

- 8. 提案手法 (2) ? 提案手法の工夫 ? 画像がギザギザ化を防止する正則化項を追加 ? SIFT, HOG ? ニューラルネットワーク的な形で微分可能なように再定義(詳細は省略) ? 同様の手法で画像再構成が可能

- 9. Deep Dream との関係 ? Deep Dream ? ネットワークがよく? 反応するような画像に変形? ? ? ? ? ? 最適化問題 ? 識別器の学習? ? 画像の再構成? ? Deep Dream? Lは Cross Entropy 誤差 Lは2乗誤差 -

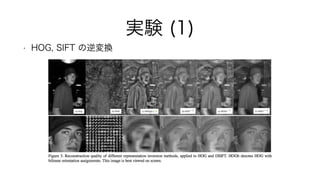

- 10. 実験 (1) ? HOG, SIFT の逆変換

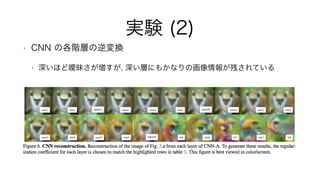

- 11. 実験 (2) ? CNN の各階層の逆変換 ? 深いほど曖昧さが増すが, 深い層にもかなりの画像情報が残されている

- 12. 実験 (3) ? CNN の不変性 ? 同じ特徴から複数の画像を再構成 ? いろいろな位置やサイズで現れる -> それらに対する不変性がある

- 13. 実験 (4) ? Receptive Field と再構成 ? Receptive Field の端の方は画像が再構成されない

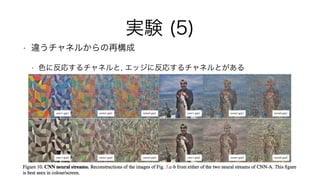

- 14. 実験 (5) ? 違うチャネルからの再構成 ? 色に反応するチャネルと, エッジに反応するチャネルとがある

- 15. 実験 (6) ? 正則化項の影響 ? 画像のギザギザを減らす正則化項の? 効果はかなり大きい ? ? HOG CNN

- 16. まとめ ? この論文は 1. CNN, SIFT, HOG を逆変換する手法を提案した ? 勾配降下法による最適化 ? 正則化項を入れてギザギザ化を防ぐのが 2. CNN の各レイヤーで表されている情報を明らかにした ? 深いほど不変性と抽象性が高まる

- 17. 疑問 1. 画像再構成で表現できないものもあるよね? 2. 画像再構成で画像識別の性能上がるの? 3. 実は画像再构成手法の性质を见てるだけでは?

- 18. 疑問 1. 画像再構成で表現できないものもあるよね? ? 名詞以外はビジュアルで表現しにくくないか? ? 抽象的すぎるものを捉えていたら? ? たとえば「美」や「真実」に反応するニューロンだったら? Simple Truth ? https://www.?ickr.com/photos/bamboobarnes/16445364238/ Abstract Beauty ? https://www.?ickr.com/photos/crazyshin/153621375/

- 19. 疑問 2. 画像再構成で画像識別の性能上がるの? ? 本論文は確かに興味深かった, が, これをどう活かせばいいのか? ? 特徴量設計の方法まで述べないとあまり意味がないのでは? ? そこまで述べたのは [Zeiler+ 14] のみ [Zeiler+ 14]

- 20. 疑問 3. 実は画像再构成手法の性质を见てるだけでは? ? 右の画像から SIFT の性質がわかるか? ? 本論文の場合でも ? 最適化がうまくいっていないのでは? ? 正則化項の影響は? [Weinzaepfel+ 11]

- 21. まとめ (2) ? この論文は 1. CNN, SIFT, HOG を逆変換する手法を提案した ? けれど実用に耐えうる性能なのかはよくわからない 2. CNN の各レイヤーで表されている情報を明らかにした ? けれどその知見をどう活かせばいいのかよくわからない ? 画像特徴可視化に期待すること 1. 提案手法で画像特徴を再設計して性能向上, まで示してほしい 2. ビジュアル化できないけれど捉えている情報, も示してほしい

- 22. 参考文献 ? [Mahendran+ 15] A. Mahendran and A. Vedaldi. Understanding Deep Image Representations by Inverting Them . CVPR. 2015. ? [Kato+ 14] H. Kato and T. Harada. Image Reconstruction from Bag-of-Visual-Words . CVPR. 2014. ? [Vondrick+ 13] C. Vondrick, A. Khosla, T. Malisiewicz, and A. Torralba. HOGgles: Visualizing Object Detection Features . ICCV. 2013. ? [Zeiler+ 14] M. Zeiler and R. Fergus. Visualizing and Understanding Convolutional Networks . ECCV. 2014. ? [Weinzaepfel+ 11] P. Weinzaepfel, H. Jégou and P. Pérez. Reconstructing an Image from Its Local Descriptors . CVPR. 2011.

![既存の画像再構成の例

? HOG 特徴の視点からは誤識別しても仕方ない?

?

?

? Bag-of-Visual-Words にも局所既述子の位置情報は?

(潜在的に)残されている

[Vondrick+ 13]

[Kato+ 14]](https://image.slidesharecdn.com/cvpryomikai-150725015738-lva1-app6892/85/CVPR-2015-Understanding-Deep-Image-Representations-by-Inverting-Them-6-320.jpg)

![疑問

2. 画像再構成で画像識別の性能上がるの?

? 本論文は確かに興味深かった, が, これをどう活かせばいいのか?

? 特徴量設計の方法まで述べないとあまり意味がないのでは?

? そこまで述べたのは [Zeiler+ 14] のみ

[Zeiler+ 14]](https://image.slidesharecdn.com/cvpryomikai-150725015738-lva1-app6892/85/CVPR-2015-Understanding-Deep-Image-Representations-by-Inverting-Them-19-320.jpg)

![疑問

3. 実は画像再构成手法の性质を见てるだけでは?

? 右の画像から SIFT の性質がわかるか?

? 本論文の場合でも

? 最適化がうまくいっていないのでは?

? 正則化項の影響は?

[Weinzaepfel+ 11]](https://image.slidesharecdn.com/cvpryomikai-150725015738-lva1-app6892/85/CVPR-2015-Understanding-Deep-Image-Representations-by-Inverting-Them-20-320.jpg)

![参考文献

? [Mahendran+ 15] A. Mahendran and A. Vedaldi. Understanding Deep Image

Representations by Inverting Them . CVPR. 2015.

? [Kato+ 14] H. Kato and T. Harada. Image Reconstruction from Bag-of-Visual-Words .

CVPR. 2014.

? [Vondrick+ 13] C. Vondrick, A. Khosla, T. Malisiewicz, and A. Torralba. HOGgles:

Visualizing Object Detection Features . ICCV. 2013.

? [Zeiler+ 14] M. Zeiler and R. Fergus. Visualizing and Understanding Convolutional

Networks . ECCV. 2014.

? [Weinzaepfel+ 11] P. Weinzaepfel, H. Jégou and P. Pérez. Reconstructing an Image

from Its Local Descriptors . CVPR. 2011.](https://image.slidesharecdn.com/cvpryomikai-150725015738-lva1-app6892/85/CVPR-2015-Understanding-Deep-Image-Representations-by-Inverting-Them-22-320.jpg)