Deep Learning§«À∆§øª≠œÒ§Ú“䧃§±§Îºº–g | OHS√„è䪷#5

- 1. Deep Learning§« À∆§øª≠œÒ§Ú“䧃§±§Îºº–g Open Hyper Scale√„è䪷#5 ∞Îπ»

- 2. Contents 1.å߻Π®C °∏À∆§∆§§§Î°π§À§ƒ§§§∆ 2.¿Ì’ì ®C Deep Learning§«ÓêÀ∆–‘§ÚíQ§¶§À §œ 3.ågº˘ ®C Chainer§À§Ë§Îåg◊∞

- 5. ¿˚”√¿˝(1) ª≠œÒ§Œó À˜ ? öð§À§ §Î•È•Û•◊§Œ‘îºö«ÈàÛ§Ú°¢ª≠œÒ§´§Èó À˜°£ÓêÀ∆…Ã∆∑§‚•¡•ß•√•Ø ? …Ã∆∑£®“Œ◊”£©§¨ågÎH§À π§Ô§Ï§∆§§§Î•§•·©`•∏§Ú§þ§∆§þ§Î ? Pinterest§«ª≠œÒ§´§ÈÓêÀ∆ª≠œÒ§Úó À˜§π§Î http://www.news.cornell.edu/stories/2016/08/where- can-i-buy-chair-app-will-tell-you https://engineering.pinterest.com/blog/introducing-new- way-visually-search-pinterest

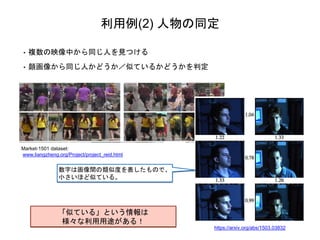

- 6. ¿˚”√¿˝(2) »ÀŒÔ§ŒÕ¨∂® ? —} ˝§Œ”≥œÒ÷–§´§ÈÕ¨§∏»À§Ú“䧃§±§Î ? Óܪ≠œÒ§´§ÈÕ¨§∏»À§´§…§¶§´£ØÀ∆§∆§§§Î§´§…§¶§´§Ú≈–∂® Market-1501 dataset: www.liangzheng.org/Project/project_reid.html https://arxiv.org/abs/1503.03832 ˝◊÷§œª≠œÒÈg§ŒÓêÀ∆∂»§Ú±Ì§∑§ø§‚§Œ§«°¢ –°§µ§§§€§…À∆§∆§§§Î°£ °∏À∆§∆§§§Î°π§»§§§¶«ÈàÛ§œ òî°©§ ¿˚”√”√Õ槨§¢§Î£°

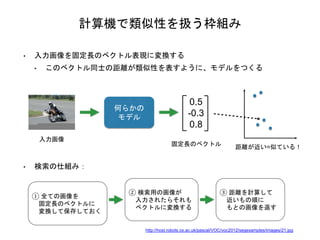

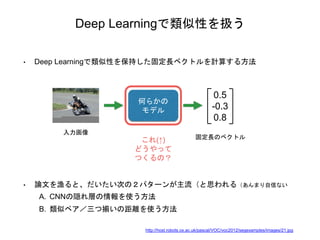

- 8. ”ãÀ„ôC§«ÓêÀ∆–‘§ÚíQ§¶ñòΩM§þ ? »Î¡¶ª≠œÒ§ÚπÃ∂®ÈL§Œ•Ÿ•Ø•»•Î±Ì¨F§Àâ‰ìQ§π§Î ? §≥§Œ•Ÿ•Ø•»•ÎÕ¨ ø§ŒæýÎx§¨ÓêÀ∆–‘§Ú±Ì§π§Ë§¶§À°¢•‚•«•Î§Ú§ƒ§Ø§Î »Î¡¶ª≠œÒ ∫Œ§È§´§Œ •‚•«•Î 0.5 -0.3 0.8 πÃ∂®ÈL§Œ•Ÿ•Ø•»•Î æýÎx§¨Ω¸§§=À∆§∆§§§Î£° ¢Ÿ »´§∆§Œª≠œÒ§Ú πÃ∂®ÈL§Œ•Ÿ•Ø•»•Î§À â‰ìQ§∑§∆±£¥Ê§∑§∆§™§Ø ¢⁄ ó À˜”√§Œª≠œÒ§¨ »Î¡¶§µ§Ï§ø§È§Ω§Ï§‚ •Ÿ•Ø•»•Î§Àâ‰ìQ§π§Î ¢€ æýÎx§Ú”ãÀ„§∑§∆ Ω¸§§§‚§ŒÌò§À §‚§»§Œª≠œÒ§Ú∑µ§π ? ó À˜§Œ ÀΩM§þ£∫ http://host.robots.ox.ac.uk/pascal/VOC/voc2012/segexamples/images/21.jpg

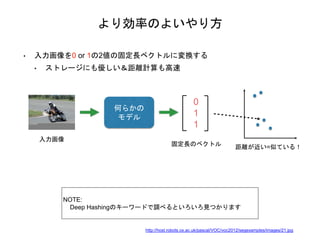

- 9. §Ë§ÍÑø¬ §Œ§Ë§§§‰§Í∑Ω ? »Î¡¶ª≠œÒ§Ú0 or 1§Œ2Ç駌πÃ∂®ÈL•Ÿ•Ø•»•Î§Àâ‰ìQ§π§Î ? •π•»•Ï©`•∏§À§‚Éû§∑§§£¶æýÎx”ãÀ„§‚∏þÀŸ NOTE: Deep Hashing§Œ•≠©`•Ô©`•…§«’{§Ÿ§Î§»§§§Ì§§§Ì“䧃§´§Í§Þ§π »Î¡¶ª≠œÒ ∫Œ§È§´§Œ •‚•«•Î 0 1 1 πÃ∂®ÈL§Œ•Ÿ•Ø•»•Î æýÎx§¨Ω¸§§=À∆§∆§§§Î£° http://host.robots.ox.ac.uk/pascal/VOC/voc2012/segexamples/images/21.jpg

- 10. Deep Learning§«ÓêÀ∆–‘§ÚíQ§¶ ? Deep Learning§«ÓêÀ∆–‘§Ú±£≥÷§∑§øπÃ∂®ÈL•Ÿ•Ø•»•Î§Ú”ãÀ„§π§Î∑Ω∑® »Î¡¶ª≠œÒ ∫Œ§È§´§Œ •‚•«•Î 0.5 -0.3 0.8 πÃ∂®ÈL§Œ•Ÿ•Ø•»•Î §≥§Ï(°¸) §…§¶§‰§√§∆ §ƒ§Ø§Î§Œ£ø ? ’쌃§ÚùO§Î§»°¢§¿§§§ø§§¥Œ§Œ£≤•—•ø©`•Û§¨÷˜¡˜£®§»Àº§Ô§Ï§Î£®§¢§Û§Þ§Í◊‘–≈§ §§ A. CNN§ŒÎL§Ï唧Œ«ÈàÛ§Ú π§¶∑Ω∑® B. ÓêÀ∆•⁄•¢£Ø»˝§ƒìB§§§ŒæýÎx§Ú π§¶∑Ω∑® http://host.robots.ox.ac.uk/pascal/VOC/voc2012/segexamples/images/21.jpg

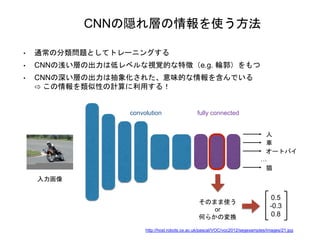

- 11. CNN§ŒÎL§Ï唧Œ«ÈàÛ§Ú π§¶∑Ω∑® ? Õ®≥£§Œ∑÷ÓêÜñÓ}§»§∑§∆•»•Ï©`•À•Û•∞§π§Î ? CNN§Œ«≥§§å”§Œ≥ˆ¡¶§œµÕ•Ï•Ÿ•Î§ “ï“ôµƒ§ Ãÿè’£®e.g. ðÜπ˘£©§Ú§‚§ƒ ? CNN§Œ…Ó§§å”§Œ≥ˆ¡¶§œ≥Ȝ۪اµ§Ï§ø°¢“‚Œ∂µƒ§ «ÈàÛ§Ú∫¨§Û§«§§§Î ? §≥§Œ«ÈàÛ§ÚÓêÀ∆–‘§Œ”ãÀ„§À¿˚”√§π§Î£° »Î¡¶ª≠œÒ convolution fully connected »À Ðá •™©`•»•–•§ °≠ √® 0.5 -0.3 0.8 §Ω§Œ§Þ§Þ 𧶠or ∫Œ§È§´§Œâ‰ìQ http://host.robots.ox.ac.uk/pascal/VOC/voc2012/segexamples/images/21.jpg

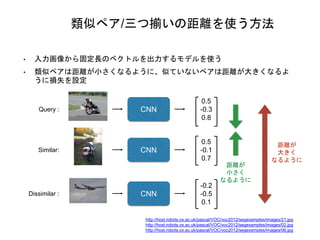

- 12. ÓêÀ∆•⁄•¢/»˝§ƒìB§§§ŒæýÎx§Ú π§¶∑Ω∑® ? »Î¡¶ª≠œÒ§´§ÈπÃ∂®ÈL§Œ•Ÿ•Ø•»•Î§Ú≥ˆ¡¶§π§Î•‚•«•Î§Ú 𧶠? ÓêÀ∆•⁄•¢§œæýÎx§¨–°§µ§Ø§ §Î§Ë§¶§À°¢À∆§∆§§§ §§•⁄•¢§œæýÎx§¨¥Û§≠§Ø§ §Î§Ë §¶§Àìp ߧڑO∂® Query : CNN 0.5 -0.3 0.8 Similar: CNN 0.5 -0.1 0.7 Dissimilar : CNN -0.2 -0.5 0.1 æýÎx§¨ –°§µ§Ø § §Î§Ë§¶§À æýÎx§¨ ¥Û§≠§Ø § §Î§Ë§¶§À http://host.robots.ox.ac.uk/pascal/VOC/voc2012/segexamples/images/21.jpg http://host.robots.ox.ac.uk/pascal/VOC/voc2012/segexamples/images/02.jpg http://host.robots.ox.ac.uk/pascal/VOC/voc2012/segexamples/images/06.jpg

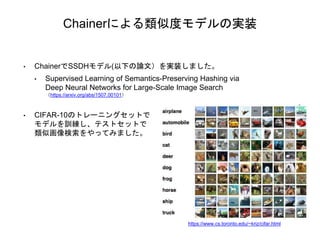

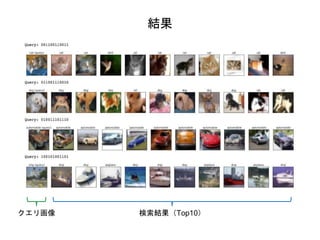

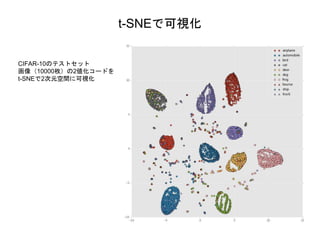

- 14. Chainer§À§Ë§ÎÓêÀ∆∂»•‚•«•Î§Œåg◊∞ ? Chainer§«SSDH•‚•«•Î(“‘œ¬§Œ’쌃£©§Úåg◊∞§∑§Þ§∑§ø°£ ? Supervised Learning of Semantics-Preserving Hashing via Deep Neural Networks for Large-Scale Image Search £®https://arxiv.org/abs/1507.00101£© ? CIFAR-10§Œ•»•Ï©`•À•Û•∞•ª•√•»§« •‚•«•Î§Ú”ñæö§∑°¢•∆•π•»•ª•√•»§« ÓêÀ∆ª≠œÒó À˜§Ú§‰§√§∆§þ§Þ§∑§ø°£ https://www.cs.toronto.edu/~kriz/cifar.html

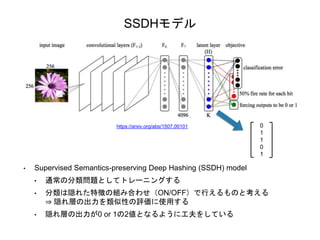

- 15. SSDH•‚•«•Î ? Supervised Semantics-preserving Deep Hashing (SSDH) model ? Õ®≥£§Œ∑÷ÓêÜñÓ}§»§∑§∆•»•Ï©`•À•Û•∞§π§Î ? ∑÷Ó꧜ÎL§Ï§øÃÿè’§ŒΩM§þ∫œ§Ô§ª£®ON/OFF£©§«––§®§Î§‚§Œ§»øº§®§Î ? ÎL§Ï唧Œ≥ˆ¡¶§ÚÓêÀ∆–‘§Œ‘uÅ˝§À π”√§π§Î ? ÎL§Ï唧Œ≥ˆ¡¶§¨0 or 1§Œ2Ç駻§ §Î§Ë§¶§Àπ§∑Ú§Ú§∑§∆§§§Î https://arxiv.org/abs/1507.00101 0 1 1 0 1

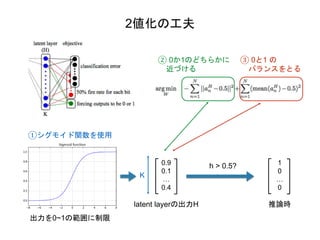

- 16. 2ÇéªØ§Œπ§∑Ú ¢Ÿ•∑•∞•‚•§•…Èv ˝§Ú π”√ ¢⁄ 0§´1§Œ§…§¡§È§´§À Ω¸§≈§±§Î ¢€ 0§»1 §Œ •–•È•Û•π§Ú§»§Î 0.9 0.1 °≠ 0.4 K latent layer§Œ≥ˆ¡¶H ≥ˆ¡¶§Ú0~1§ŒπÝáϧÀ÷∆œÞ Õ∆’ìïr 1 0 °≠ 0 h > 0.5?

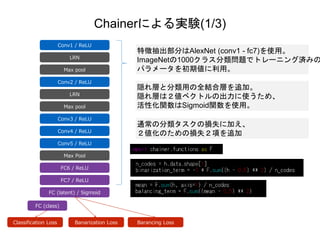

- 17. Chainer§À§Ë§ÎågÚY(1/3) Conv1 / ReLU LRN Max pool Conv2 / ReLU LRN Max pool Conv3 / ReLU Conv4 / ReLU Conv5 / ReLU Max Pool FC6 / ReLU FC7 / ReLU FC (latent) / Sigmoid FC (class) Ãÿè’≥È≥ˆ≤ø∑÷§œAlexNet (conv1 - fc7)§Ú π”√°£ ImageNet§Œ1000•Ø•È•π∑÷ÓêÜñÓ}§«•»•Ï©`•À•Û•∞úg§þ§Œ •—•È•·©`•ø§Ú≥ı∆⁄Çé§À¿˚”√°£ Classification Loss Banarization Loss Barancing Loss ÎL§Ï唧»∑÷Óê”√§Œ»´ΩY∫œå”§Ú◊∑º”°£ ÎL§Ï唧œ£≤Çé•Ÿ•Ø•»•Î§Œ≥ˆ¡¶§À 𧶧ø§·°¢ ªÓ–‘ªØÈv ˝§œSigmoidÈv ˝§Ú π”√°£ Õ®≥£§Œ∑÷Óê•ø•π•Ø§Œìp ߧÀº”§®°¢ £≤ÇéªØ§Œ§ø§·§Œìp ߣ≤Ìó§Ú◊∑º”

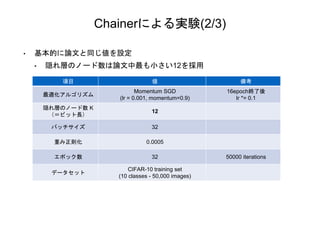

- 18. Chainer§À§Ë§ÎågÚY(2/3) Ìóƒø Çé ljøº ◊ÓþmªØ•¢•Î•¥•Í•∫•ý Momentum SGD (lr = 0.001, momentum=0.9) 16epochΩK¡À·· lr *= 0.1 ÎL§Ï唧Œ•Œ©`•… ˝ K £®£Ω•”•√•»ÈL£© 12 •–•√•¡•µ•§•∫ 32 ÷ÿ§þ’˝ÑtªØ 0.0005 •®•ð•√•Ø ˝ 32 50000 iterations •«©`•ø•ª•√•» CIFAR-10 training set (10 classes - 50,000 images) ? ª˘±æµƒ§À’쌃§»Õ¨§∏Çé§Ú‘O∂® ? ÎL§Ï唧Œ•Œ©`•… ˝§œ’쌃÷–◊Ó§‚–°§µ§§12§ÚíÒ”√

- 21. §Þ§»§·

- 22. §Þ§»§· ? ª≠œÒ§ŒÓêÀ∆–‘§œ§§§Ì§§§Ì§ •¢•◊•Í•±©`•∑•Á•Û§ÀèÍ”√§«§≠§Î°£ ? ÓêÀ∆–‘§Ú•∑•π•∆•ý§«íQ§¶àˆ∫œ§À§œ°¢πÃ∂®•µ•§•∫§Œ•Ÿ•Ø•»•Î§Àâ‰ìQ§π§Î§Œ§¨Õ®¿˝°£ ? •Ÿ•Ø•»•ÎÈg§ŒæýÎx§¨–°§µ§§§€§…À∆§∆§§§Î§»øº§®§Î°£ ? Deep Learning§«ÓêÀ∆–‘§ÚíQ§¶ñòΩM§þ§Ú’{ñÀ§∑§ø°£ ? CNN§ŒÎL§Ï唧Œ«ÈàÛ§Ú π§¶∑Ω∑® ? ÓêÀ∆•⁄•¢§Œ≥ˆ¡¶§ŒæýÎx§¨Ω¸§Ø§ §Î§Ë§¶§À”ñæö§π§Î∑Ω∑® £®À∆§∆§§§ §§§‚§Œ§œþh§Ø§ §Î§Ë§¶§À°££© ? Chainer§«SSDH§Úåg◊∞§∑§ø°£ ? ÓêÀ∆ª≠œÒó À˜§ÚÑ”◊˜§µ§ª§Î§≥§»§¨§«§≠§ø°£ ? ∑÷Óê”√§Œ•«©`•ø•ª•√•»§«—ߡ淋§ª§Î§≥§»§¨§«§≠§Î§Œ§«°¢…´°©‘á§∑§∆§þ§ø§§°£ ? Github§À•¢•√•◊§∑§Þ§∑§ø£∫https://github.com/t-hanya/chainer-SSDH

- 24. ∏∂Âh