[б„Ӣб…©б„‘б…ібҶ«б„үб…©б„үб…іб„Ҹб…ҘбҶ«б„үб…ҘбҶҜб„җб…өбҶј]б„Ӣб…©бҶ«б„‘б…іб„…б…Ұб„Ҷб…өб„үб…і LLM б„үб…©бҶҜб„…б…®б„үб…§бҶ«_202410.pdf

- 2. 2 INDEX м ңн’Ҳмқҳ м°Ёлі„м„ұ I мӮ¬лӮҙ On-premise LLMмқҳ н•„мҡ”м„ұ II III On-premise LLM мҶ”лЈЁм…ҳ

- 3. 3 I. мӮ¬лӮҙ On-premise LLMмқҳ н•„мҡ”м„ұ м—…л¬ҙ н”„лЎңм„ёмҠӨлҘј мҷ„м „нһҲ нҳҒмӢ н•ҳлҠ” LLM LLMмқ„ нҷңмҡ©н•ң Usercases On-premise LLM, мҷң н•„мҡ”н•ңк°Җ

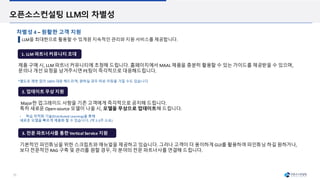

- 4. 4 мӮ¬лӮҙ On-premise LLMмқҳ н•„мҡ”м„ұ кё°м—…мқҳ м—…л¬ҙ н”„лЎңм„ёмҠӨлҘј мҷ„м „нһҲ нҳҒмӢ н•ҳлҠ” LLM (Large Language Model, кұ°лҢҖм–ём–ҙлӘЁлҚё) м—…л¬ҙ мһҗлҸҷнҷ” л°Ҹ нҡЁмңЁнҷ”лҘј нҶөн•ҙ мӮ¬л¬ҙ мғқмӮ°м„ұмқ„ к·№лҢҖнҷ” кё°мЎҙм—җлҠ” мӢӨнҳ„ л¶Ҳк°Җн–ҲлҚҳ мһ‘м—…л“Өмқ„ к°ҖлҠҘн•ҳкІҢ н•ҳм—¬ мғҲлЎңмҡҙ к°Җм№ҳлҘј м°Ҫм¶ң мҳӨлҠҳлӮ мғқм„ұнҳ•AI(LLM) кё°мҲ мқҖ мӮ¬л¬ҙ мғқмӮ°м„ұмқ„ к·№лҢҖнҷ”н•ҳкі мғҲлЎңмҡҙ к°Җм№ҳлҘј м°Ҫм¶ңн•ҳл©° нҳ„лҢҖ кё°м—…мқҳ н•„мҲҳм Ғмқё м „лһөм Ғ мҡ”мҶҢлЎң мһҗлҰ¬л§Өк№Җн•ҳкі мһҲмҠөлӢҲлӢӨ. MITлҠ” мһ‘л…„, вҖҳChatGPT(LLM)лҘј мӮ¬мҡ©н• кІҪмҡ° нҷ”мқҙнҠём№јлқј(White-collar) м§Ғм—…кө°мқҳ мғқмӮ°м„ұмқҙ м•Ҫ 37%лӮҳ лҚ” мҰқк°Җн•ңлӢӨвҖҷлҠ” м—°кө¬ кІ°кіјлҘј л°ңн‘ңн•ң л°” мһҲмҠөлӢҲлӢӨ. м¶ңмІҳ: Shakked Noy&Whitney Zhang, 2023, Experimental Evidence on the Productivity Effects ofGenerative Artificial Intelligence, [MIT] : мҶҢмҡ” мӢңк°„ мһ‘м—… нҖ„лҰ¬нӢ° мӢӨм ңлЎң мҶҢл§Өм—… л°Ҹ м „мһҗмғҒкұ°лһҳм—… кІҪмҳҒ진мқҳ 90%к°Җ м—…л¬ҙ ліҙмЎ°мҡ©мңјлЎң мғқм„ұнҳ• AIлҘј мӮ¬мҡ©н•ҳкі мһҲмңјл©°, мқҙлҹ¬н•ң к·ңлӘЁлҠ” м җм°Ё мҰқк°Җн• кІғмһ…лӢҲлӢӨ. м¶ңмІҳ: FutureCommerce : LLM мӢңмһҘмқҙ 2030л…„к№Ңм§Җ м—°нҸүк· 33.2% м„ұмһҘн• кІғмңјлЎң м „л§қ м¶ңмІҳ: MarketsandMarkets м—…л¬ҙ мһҗлҸҷнҷ”: лӢЁмҲң л°ҳліөм Ғмқё мӮ¬лӮҙ м—…л¬ҙлҘј мһҗлҸҷнҷ”н•ҳм—¬ мӢңк°„кіј 비мҡ©мқ„ м Ҳк°җ м •нҷ•лҸ„ н–ҘмғҒ: мқём Ғ мҳӨлҘҳлҘј мөңмҶҢнҷ”н•ҳкі мқјкҙҖлҗң л©”мӢңм§ҖлҘј м „лӢ¬ мҶ”лЈЁм…ҳ м ңкіө: лӢӨк°Ғм Ғмқё мҶ”лЈЁм…ҳмқ„ м ңкіөн•ҳл©° м—…л¬ҙлҘј нҡЁмңЁм ҒмңјлЎң ліҙмЎ° мӮ¬лӮҙ лҚ°мқҙн„° кҙҖлҰ¬: мҲҳл§ҺмқҖ л¬ём„ң мһ‘м„ұкіј кҙҖлҰ¬, кІҖмғүмқ„ мҙқкҙ„ м§Җмӣҗ нҳҒмӢ м Ғмқё кі к°қ кІҪн—ҳ м ңкіө: 24мӢңк°„/365мқј мҰүк°Ғм Ғмқё CS лҢҖмқ‘кіј, кі к°қ н–үлҸҷ 분м„қ л°Ҹ мҳҲмёЎ кё°л°ҳ л§ҲмјҖнҢ…мқ„ нҶөн•ң кі к°қ л§ҢмЎұлҸ„ мҰқлҢҖ м—…л¬ҙ н’ҲкІ© н–ҘмғҒ: м§Ғмӣҗл“Өмқҙ ліҙлӢӨ кі м°Ёмӣҗм Ғмқё м—…л¬ҙм—җ 집мӨ‘н• мҲҳ мһҲлҸ„лЎқ м§Җмӣҗ

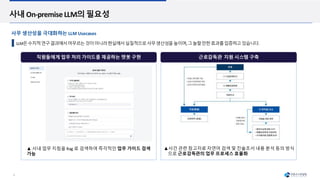

- 5. 5 к°ңмқём •ліҙ лҚ°мқҙн„° л§ҲмҠӨнӮ№ мӮ¬лӮҙ On-premise LLMмқҳ н•„мҡ”м„ұ LLMмқҖмҲҳм№ҳм Ғм—°кө¬кІ°кіјм—җм„ңлЁёл¬ҙлҘҙлҠ”кІғмқҙм•„лӢҲлқјнҳ„мӢӨм—җм„ңмӢӨм§Ҳм ҒмңјлЎңмӮ¬л¬ҙмғқмӮ°м„ұмқ„лҶ’мқҙл©°,к·ёлҶҖлһ„л§Ңн•ңнҡЁкіјлҘјмһ…мҰқн•ҳкі мһҲмҠөлӢҲлӢӨ. в–І кі к°қ к°ңмқём •ліҙк°Җ лӢҙкІЁмһҲлҠ” л¶Җ분мқ„ л§ҲмҠӨнӮ№ мІҳлҰ¬ нӣ„ нҢҢмқјлЎң л°ҳнҷҳ в–І лҜјк°җн•ң к°ңмқём •ліҙлҘј мӮ¬лӮҙ м„ңлІ„ м•Ҳм—җм„ң м•Ҳм „н•ҳкІҢ лӢӨлЈ° мҲҳ мһҲмқҢ в–І лӢӨм–‘н•ң к·ңкІ©мқ„ м§Җм •н•ң н•ҳлӮҳмқҳ к·ңкІ©мңјлЎң нҶөмқјн•ҳм—¬ нҢҢмқјлЎң л°ҳнҷҳ в–І м „нҷ”лІҲнҳё, лӮ м§ң, мЈјмҶҢ л“ұ н•„мҡ”н•ң к·ңкІ©м—җ л§һкІҢ м„Өкі„ м§Җмӣҗ (л¬ҙмғҒ) мӮ¬л¬ҙ мғқмӮ°м„ұмқ„ к·№лҢҖнҷ”н•ҳлҠ” LLM Usecases к·ңкІ© нҶөмқј мһҗлҸҷнҷ”

- 6. 6 м§Ғмӣҗл“Өм—җкІҢ м—…л¬ҙ мІҳлҰ¬ к°Җмқҙл“ңлҘј м ңкіөн•ҳлҠ” мұ—лҙҮ кө¬нҳ„ к·јлЎңк°җлҸ…кҙҖ м§Җмӣҗ мӢңмҠӨн…ң кө¬м¶• мӮ¬лӮҙ On-premise LLMмқҳ н•„мҡ”м„ұ LLMмқҖмҲҳм№ҳм Ғм—°кө¬кІ°кіјм—җм„ңлЁёл¬ҙлҘҙлҠ”кІғмқҙм•„лӢҲлқјнҳ„мӢӨм—җм„ңмӢӨм§Ҳм ҒмңјлЎңмӮ¬л¬ҙмғқмӮ°м„ұмқ„лҶ’мқҙл©°,к·ёлҶҖлһ„л§Ңн•ңнҡЁкіјлҘјмһ…мҰқн•ҳкі мһҲмҠөлӢҲлӢӨ. в–І мӮ¬лӮҙ м—…л¬ҙ м§Җм№Ёмқ„ Rag лЎң кІҖмғүн•ҳм—¬ мҰүк°Ғм Ғмқё м—…л¬ҙ к°Җмқҙл“ң кІҖмғү к°ҖлҠҘ в–ІмӮ¬кұҙ кҙҖл Ё м°ёкі мһҗлЈҢ мһҗм—°м–ҙ кІҖмғү л°Ҹ 진мҲ мЎ°м„ң лӮҙмҡ© 분м„қ л“ұмқҳ л°©мӢқ мңјлЎң к·јлЎңк°җлҸ…кҙҖмқҳ м—…л¬ҙ н”„лЎңм„ёмҠӨ нҡЁмңЁнҷ” мӮ¬л¬ҙ мғқмӮ°м„ұмқ„ к·№лҢҖнҷ”н•ҳлҠ” LLM Usecases

- 7. 7 мҪ”л“ң мһ‘м„ұ м§Җмӣҗ мӮ¬лӮҙ мһҗлЈҢ лӮҙ н•„мҡ”н•ң м •ліҙ кІҖмғү мӮ¬лӮҙ On-premise LLMмқҳ н•„мҡ”м„ұ LLMмқҖмҲҳм№ҳм Ғм—°кө¬кІ°кіјм—җм„ңлЁёл¬ҙлҘҙлҠ”кІғмқҙм•„лӢҲлқјнҳ„мӢӨм—җм„ңмӢӨм§Ҳм ҒмңјлЎңмӮ¬л¬ҙмғқмӮ°м„ұмқ„лҶ’мқҙл©°,к·ёлҶҖлһ„л§Ңн•ңнҡЁкіјлҘјмһ…мҰқн•ҳкі мһҲмҠөлӢҲлӢӨ. в–І мҪ”л”© м–ём–ҙ(Python/Java/Javascript)лҘј м„ нғқ нӣ„ мӣҗн•ҳлҠ” лӮҙмҡ© мһ…л Ҙ мӢң мҪ”л“ң кІ°кіјл¬јмқҙ м ңкіөлҗЁ в–І мұ—лҙҮм—җкІҢ лҢҖнҷ” нҳ•мӢқмңјлЎң м§Ҳл¬ёмқ„ лҚҳм§Җл©ҙ, RAG кё°мҲ м—җ мқҳн•ҙ кё°мЎҙ мӮ¬лӮҙ л¬ём„ңл“ӨлЎңл¶Җн„° н•„мҡ”н•ң м •ліҙк°Җ л№ лҘҙкі мүҪкІҢ нғҗмғүлҗҳм–ҙ м ңкіөлҗЁ мӮ¬л¬ҙ мғқмӮ°м„ұмқ„ к·№лҢҖнҷ”н•ҳлҠ” LLM Usecases

- 8. 8 мқёкІҢмһ„ Chatbot мғҒлӢҙ м§Җмӣҗ мӢӨмӢңк°„ AI мҰқк¶Ң лүҙмҠӨ мҡ”м•Ҫ мӮ¬лӮҙ On-premise LLMмқҳ н•„мҡ”м„ұ LLMмқҖк°Ғкё°м—…мқҳкі к°қл“Өм—җкІҢ24мӢңк°„/365мқјнҳҒмӢ м Ғмқёл§һм¶Өнҳ•м„ң비мҠӨлҘјм ңкіөн•ҳл©°кё°м—…мқҳкІҪмҹҒл Ҙмқ„к°•нҷ”н•ҳкі мһҲмҠөлӢҲлӢӨ. в–І кі к°қ лҢҖмғҒ мқёкІҢмһ„ chatbot мғҒлӢҙ л“ұмқҳ м°Ёлі„м Ғмқё м„ң비мҠӨлҘј м ңкіө в–І кІҢмһ„мӮ¬мқҳ лӮҙл¶Җ м§ҖмӢқкіј нһҲмҠӨнҶ лҰ¬лҘј лҲ„м Ғм ҒмңјлЎң н•ҷмҠө в–І мӢӨмӢңк°„мңјлЎң мҰқк¶Ң кҙҖл Ё лүҙмҠӨлҘј кё°л°ҳмңјлЎң кі к°қм—җкІҢ мң мҡ©н•ң мҰқк¶Ң м •ліҙлҘј м ңкіө (мһҗлҸҷ pdf лҰ¬нҸ¬нҢ…к№Ңм§Җ к°ҖлҠҘ) мў…лӘ© : XXXXX (00000) мғҒл°ҳкё° нҳёмЈј мҠӨл§ҲнҠёнҢң 진м¶ң лҸҷмӮ¬лҠ” нҳёмЈј мҠӨл§ҲнҠёнҢң кіөкёү кі„м•Ҫ мІҙкІ°мқҙ мһ„л°•н–ҲлӢӨ. мҳ¬н•ҙвҖҰвҖҰ. мӢңкіө진н–үлҘ м—җ л”°лқј л§Өм¶ңмқҙ мқёмӢқлҗҳл©°, мқҙлІҲ мҲҳмЈјкёҲм•Ўмқҳ м•Ҫ 50%к°Җ мҳ¬н•ҙ л§Өм¶ңм—җ л°ҳмҳҒлҗ кІғмңјлЎң ліҙмқёлӢӨ. мқҙм—җ 2024л…„ н•ҙмҷё мҠӨл§ҲнҠёнҢң л§Өм¶ңмқҖ м•Ҫ 350м–өмӣҗмңјлЎң мҳҲмғҒлҗңлӢӨ. мӢңкіөвҖҰ. нҳёмЈј н”„лЎңм қнҠё, 4л…„к°„ 5,000м–өмӣҗ к·ңлӘЁ 3Q24м—җлҸ„ 추к°Җм Ғмқё нҳёмЈј мҠӨл§ҲнҠёнҢң мҲҳмЈјк°Җ кё°лҢҖлҗңлӢӨ. лҸҷмӮ¬лҠ” 3분기м—җ нҳёмЈј нҖёмҰҗлһңл“ң лҢҖн•ҷкөҗмҷҖ 2к°ң мә нҚјмҠӨ лӮҙ м—°кө¬мҡ© вҖҰвҖҰ вҖў мғқм„ұнҳ• AIлҘј мқҙмҡ©н•ҙ л°©лҢҖн•ң м–‘мқҳ лүҙмҠӨлҘј мҡ”м•Ҫ вҖў н•өмӢ¬ нӮӨмӣҢл“ң м •ліҙ м ңкіө лүҙмҠӨ мҡ”м•Ҫ нҳёмһ¬/м•…мһ¬ 분лҘҳ лүҙмҠӨ 분лҘҳ вҖў мў…лӘ© лүҙмҠӨк°Җ нҳёмһ¬мқём§Җ м•…мһ¬мқём§Җ кө¬л¶„ вҖў нҳёмһ¬/м•…мһ¬ м •лҸ„лҘј мҲҳм№ҳнҷ” вҖў 분лҘҳ лҢҖмғҒ лүҙмҠӨ м •мқҳ вҖў м–ёлЎ мӮ¬ лүҙмҠӨ мӨ‘ліө мӢқлі„ вҖў мң нҳ•лі„ 분лҘҳ мғҲлЎңмҡҙ к°Җм№ҳлҘј м°Ҫм¶ңн•ҳлҠ” LLM Usecases

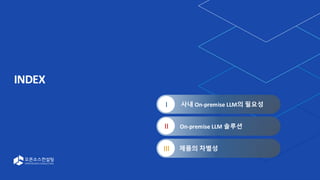

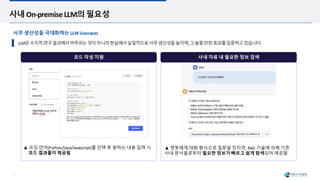

- 9. 9 мӮ¬лӮҙ On-premise LLMмқҳ н•„мҡ”м„ұ кі к°қ 1:1 л¬ёмқҳм—җ мҰүк°Ғм Ғмқё мһҗлҸҷ лӢөліҖ м ңкіө кі к°қ мҳҲм•Ҫ е…Ёкіјм • мһҗлҸҷнҷ” в–І 1:1 л¬ёмқҳм—җ лҢҖн•ң лӢөліҖмқ„ мһҗлҸҷмңјлЎң м ңкіөн•ҳм—¬ мҰүк°Ғм Ғмқё кі к°қ мғҒлӢҙ м§Җмӣҗ [мҳҲм•Ҫ л¶Ҳк°Җ мӢң лҢҖм•Ҳ м ңмӢң] [мҳҲм•Ҫм—җ н•„мҡ”н•ң лҚ°мқҙн„° мҲҳ집] [мҳҲм•Ҫ нҷ•м • л°Ҹ мҳҲм•ҪкёҲ м•ҲлӮҙ] в–І мӨ‘ліө мҳҲм•Ҫ/мҳӨлҘҳм—җ лҢҖн•ң мҡ°л Ө м—Ҷмқҙ л№ лҘҙкі мү¬мҡҙ мҳҲм•Ҫ м„ң비мҠӨ м§Җмӣҗ в–І лҜјк°җн•ң кі к°қ к°ңмқём •ліҙлҘј мӮ¬лӮҙ м„ңлІ„ м•Ҳм—җм„ң м•Ҳм „н•ҳкІҢ лӢӨлЈ° мҲҳ мһҲмқҢ LLMмқҖ к°Ғ кё°м—…мқҳ кі к°қл“Өм—җкІҢ 24мӢңк°„/365мқј нҳҒмӢ м Ғмқё л§һм¶Өнҳ• м„ң비мҠӨлҘј м ңкіөн•ҳл©° кё°м—…мқҳ кІҪмҹҒл Ҙмқ„ к°•нҷ”н•ҳкі мһҲмҠөлӢҲлӢӨ. мғҲлЎңмҡҙ к°Җм№ҳлҘј м°Ҫм¶ңн•ҳлҠ” LLM Usecases

- 10. 10 мӮ¬лӮҙ On-premise LLMмқҳ н•„мҡ”м„ұ л§қ 분лҰ¬лЎң мқён•ҳм—¬ мӮ¬лӮҙ ChatGPT мӮ¬мҡ©мқҙ л¶Ҳк°Җн•ң кіөкіөкё°кҙҖ лҜјк°җн•ң мӮ¬лӮҙ м •ліҙ мң м¶ңм—җ лҢҖн•ң мҡ°л Өк°Җ мһҲлҠ” кё°м—… мЎ°м§Ғ лӮҙ AI м „л¬ём„ұмқҙ л¶ҖмЎұн•ҳкі , л°©лІ•мқ„ лӘ°лқј м—…л¬ҙм—җ AIлҘј м Ғм ҲнһҲ нҷңмҡ©н•ҳм§Җ лӘ»н•ҳлҠ” кё°м—… On-premise LLMмқҖ нҒҙлқјмҡ°л“ң нҷҳкІҪмқҙ м•„лӢҢ кё°м—…мқҳ мһҗмІҙм Ғмқё м„ңлІ„ лӮҙ кө¬м¶•н•ҳм—¬ л§қ 분лҰ¬ мқҙмҠҲмҷҖ лҚ°мқҙн„° мң м¶ңм—җ лҢҖн•ң мҡ°л Ө X м•Ҳм „н•ң LLM мҶ”лЈЁм…ҳ л§һм¶Өнҳ• AI мҶ”лЈЁм…ҳ м ңмӢң мқҙл Үл“Ҝ LLMмқҳ нҷңмҡ©м„ұмқ„ л¬ҙк¶Ғл¬ҙ진н•ҳм§Җл§Ң, л§қ 분лҰ¬вҲҷм •ліҙ мң м¶ң л¬ём ңлЎң мқён•ҳм—¬ мӮ¬лӮҙм—җм„ң ChatGPT л“ұ AI м„ң비мҠӨлҘј м ңлҢҖлЎң нҷңмҡ©н•ҳм§Җ лӘ»н•ҳлҠ” кё°м—…л“Өмқҙ лӢӨмҲҳ мЎҙмһ¬н•©лӢҲлӢӨ. вҖҳм•Ҳм „н•ҳкі м»ӨмҠӨн„°л§Ҳмқҙ징мқҙ мҡ©мқҙн•ң On-premise LLM кө¬м¶•вҖҷмқ„ м ңм•Ҳн•©лӢҲлӢӨ. лҢҖм•ҲмңјлЎң л– мҳӨлҘё On-premise LLM к°Ғ кё°м—…м—җ л§һм¶° LLM мҶ”лЈЁм…ҳмқ„ кө¬м¶•н•ҳлҠ” кіјм •м—җм„ң кё°м—… лӢҲмҰҲм—җ л§һлҠ” мөңм Ғмқҳ AI мҶ”лЈЁм…ҳ лҸ„мһ… к°ҖлҠҘ кё°л°ҳ On-premise нҢЁнӮӨм§Җ LLM мұ—лҙҮ RAG мұ—лҙҮ м ңмһ‘ нҲҙ Chatplay м—…л¬ҙ нҡЁмңЁнҷ” нҲҙ Task UI On-premise LLM, мҷң н•„мҡ”н•ңк°Җ? ChatGPTлҘј м—…л¬ҙм—җ нҷңмҡ©н•ҳм§Җ лӘ»н•ҳлҠ” кё°м—…л“Ө

- 11. 11 II. мҳӨн”ҲмҶҢмҠӨм»Ём„ӨнҢ…мқҳ On-premise LLM мҶ”лЈЁм…ҳ MAAL (Multilingual Adaptive Augmentation Language-model) MAAL кё°л°ҳ On-premise нҢЁнӮӨм§Җ - мұ—лҙҮ - Chatplay - LLM Task UI

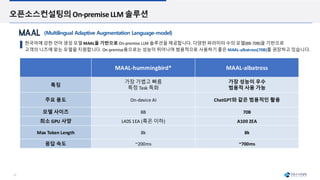

- 12. 12 мҳӨн”ҲмҶҢмҠӨм»Ём„ӨнҢ…мқҳOn-premiseLLM мҶ”лЈЁм…ҳ (Multilingual Adaptive Augmentation Language-model) н•ңкөӯм–ҙм—җ к°•н•ң м–ём–ҙ мғқм„ұ лӘЁлҚё MAALмқ„ кё°л°ҳмңјлЎң On-premise LLM мҶ”лЈЁм…ҳмқ„ м ңкіөн•©лӢҲлӢӨ. лӢӨм–‘н•ң нҢҢлқјлҜён„° мҲҳмқҳ лӘЁлҚё(8B-70B)мқ„ кё°л°ҳмңјлЎң кі к°қмқҳ лӢҲмҰҲм—җ л§һлҠ” лӘЁлҚёмқ„ м§Җмӣҗн•©лӢҲлӢӨ. On-premiseмҡ©мңјлЎңлҠ” м„ұлҠҘмқҙ лӣ°м–ҙлӮҳл©° лІ”мҡ©м ҒмңјлЎң мӮ¬мҡ©н•ҳкё° мўӢмқҖ MAAL-albatross(70B)лҘј к¶ҢмһҘн•ҳкі мһҲмҠөлӢҲлӢӨ. MAAL-hummingbird* MAAL-albatross нҠ№м§• к°ҖмһҘ к°ҖліҚкі л№ лҰ„ нҠ№м • Task нҠ№нҷ” к°ҖмһҘ м„ұлҠҘмқҙ мҡ°мҲҳ лІ”мҡ©м Ғ мӮ¬мҡ© к°ҖлҠҘ мЈјмҡ” мҡ©лҸ„ On-device AI ChatGPTмҷҖ к°ҷмқҖ лІ”мҡ©м Ғмқё нҷңмҡ© лӘЁлҚё мӮ¬мқҙмҰҲ 8B 70B мөңмҶҢ GPU мӮ¬м–‘ L40S 1EA (нҳ№мқҖ мқҙн•ҳ) A100 2EA Max Token Length 8k 8k мқ‘лӢө мҶҚлҸ„ ~200ms ~700ms

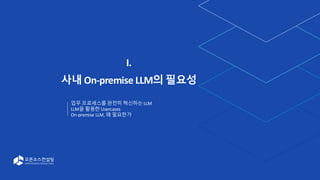

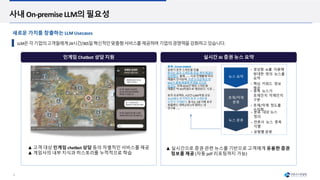

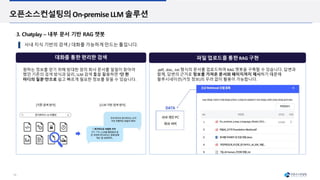

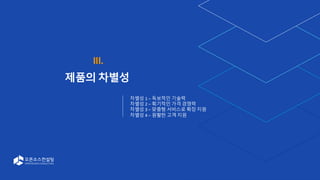

- 13. 13 м–ҙн”Ңлқјмқҙм–ёмҠӨнҳ•нғңлЎңм ңкіөлҗҳлҠ”MAALкё°л°ҳAll-in-oneм ңн’Ҳ On-premise LLMмқҖ мҶҢн”„нҠёмӣЁм–ҙ л°Ҹ н•ҳл“ңмӣЁм–ҙлҘј 묶мқҖ н•ҳлӮҳмқҳ нҢЁнӮӨм§ҖлЎң м ңкіөлҗ©лӢҲлӢӨ. мҰү, 추к°Җм Ғмқё RAG кө¬м¶•мқҙлӮҳ к°ңл°ңм—җ мӢңк°„мқ„ л“Өмқј н•„мҡ” м—Ҷмқҙ мҰүмӢң нҡҢмӮ¬ м„ңлІ„ лӮҙ к°Җм ёлӢӨ мӮ¬мҡ©н•ҳмӢӨ мҲҳ мһҲмҠөлӢҲлӢӨ. Server кі к°қмӮ¬ лӮҙл¶Җ л§қ [On-premise LLM м ңн’Ҳ м•„нӮӨн…ҚмІҳ] *API нҷңмҡ©мқ„ нҶөн•ң м„ң비мҠӨ к°ңл°ң к°ҖлҠҘ LLM API Vector DB RAG Chatplay Task UI мұ—лҙҮ LLM Engine Service Application Back-end API Engine мҳӨн”ҲмҶҢмҠӨм»Ём„ӨнҢ…мқҳOn-premiseLLM мҶ”лЈЁм…ҳ

- 14. 14 мҳӨн”ҲмҶҢмҠӨм»Ём„ӨнҢ…мқҳOn-premiseLLM мҶ”лЈЁм…ҳ Large Language Model Agent RAG кі к°қмӮ¬ лӮҙл¶Җ мӢңмҠӨн…ң кі к°қмӮ¬ Knowledge Base лӮҙл¶Җ м„ң비мҠӨ (м§Ғмӣҗ мӮ¬л¬ҙ мғқмӮ°м„ұ н–ҘмғҒ) мҷёл¶Җ м„ң비мҠӨ(м—…л¬ҙ л¬ҙмқёнҷ” + кі к°қ л§ҢмЎұлҸ„ н–ҘмғҒ) л¬ём„ң мҡ”м•Ҫ лІҲм—ӯ ліҙкі м„ң мІЁмӮӯ лӢЁмң„ нҶөмқј мҪ”л“ң мһ‘м„ұ нҷҚліҙ л¬ёкө¬ мғқм„ұ кі к°қ мғҒлӢҙ мҳҲм•Ҫ м ‘мҲҳ м ңн’Ҳ 추мІң *мҷёл¶Җ мң м¶ңмқҙ л¶Ҳк°Җн•ң мһҗлЈҢлҠ” Data Baseм—җ м Ғмһ¬ Service System AI м ңкіө мҶ”лЈЁм…ҳ к°Җл“ңл Ҳмқј [On-premise LLM м„ң비мҠӨ н”„лЎңм„ёмҠӨ] мҳӨн”ҲмҶҢмҠӨм»Ём„ӨнҢ…мқҳ MAAL мҶ”лЈЁм…ҳмқҖ кі к°қмӮ¬ лӮҙл¶Җ л§қм—җ нғ‘мһ¬лҗҳм–ҙ лӢӨм–‘н•ң лҢҖлӮҙ/лҢҖмҷё м„ң비мҠӨлҘј кө¬нҳ„н•ҙл“ңлҰҪлӢҲлӢӨ. кі к°қмӮ¬ лӮҙл¶Җ л§қ (On-premise)

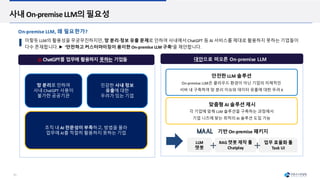

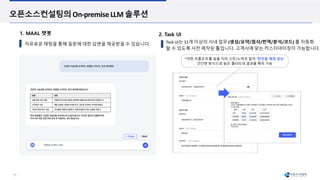

- 15. 15 мҳӨн”ҲмҶҢмҠӨм»Ём„ӨнҢ…мқҳOn-premiseLLM мҶ”лЈЁм…ҳ мһҗмң лЎңмҡҙ мұ„нҢ…мқ„ нҶөн•ҙ м§Ҳл¬ём—җ лҢҖн•ң лӢөліҖмқ„ м ңкіөл°ӣмқ„ мҲҳ мһҲмҠөлӢҲлӢӨ. 2. Task UI Task UIлҠ” 31к°ң мқҙмғҒмқҳ мӮ¬лӮҙ м—…л¬ҙ (мғқм„ұ/мҡ”м•Ҫ/мІЁмӮӯ/лІҲм—ӯ/분м„қ/мҪ”л“ң) лҘј мһҗлҸҷнҷ” н• мҲҳ мһҲлҸ„лЎқ мӮ¬м „ м ңмһ‘лҗң нҲҙмһ…лӢҲлӢӨ. кі к°қмӮ¬м—җ л§һлҠ” м»ӨмҠӨн„°л§Ҳмқҙ징мқҙ к°ҖлҠҘн•©лӢҲлӢӨ. *м–ҙл–Ө н”„лЎ¬н”„нҠёлҘј л„Јмқ„ м§Җмқҳ кі лҜј/л…ён•ҳмҡ° м—Ҷмқҙ вҖҳл№Ҳм№ёмқ„ мұ„мӣҢ л„ЈлҠ”вҖҷ к°„лӢЁн•ң л°©мӢқмңјлЎң лҶ’мқҖ нҖ„лҰ¬нӢ°мқҳ кІ°кіјл¬ј нҡҚл“қ к°ҖлҠҘ 1. MAAL мұ—лҙҮ

- 16. 16 мҳӨн”ҲмҶҢмҠӨм»Ём„ӨнҢ…мқҳOn-premiseLLM мҶ”лЈЁм…ҳ 3. Chatplay вҖ“ лӮҙл¶Җ л¬ём„ң кё°л°ҳ RAG мұ—лҙҮ лҢҖнҷ”лҘј нҶөн•ң нҺёлҰ¬н•ң кІҖмғү мӮ¬лӮҙ м§ҖмӢқ кё°л°ҳмқҳ кІҖмғү / лҢҖнҷ”лҘј к°ҖлҠҘн•ҳкІҢ л§Ңл“ңлҠ” нҲҙмһ…лӢҲлӢӨ. мӣҗн•ҳлҠ” м •ліҙлҘј м–»кё° мң„н•ҙ л°©лҢҖн•ң м–‘мқҳ нҡҢмӮ¬ л¬ём„ңлҘј мқјмқјмқҙ м°ҫм•„м•ј н–ҲлҚҳ кё°мЎҙмқҳ кІҖмғү л°©мӢқкіј лӢ¬лҰ¬, LLM кІҖмғү нҲҙмқ„ нҷңмҡ©н•ҳл©ҙ вҖҳлӢЁ н•ң л§Ҳл””мқҳ м§Ҳл¬ёвҖҷл§ҢмңјлЎң мүҪкі л№ лҘҙкІҢ н•„мҡ”н•ң м •ліҙлҘј м°ҫмқ„ мҲҳ мһҲмҠөлӢҲлӢӨ. нҢҢмқј м—…лЎңл“ңлҘј нҶөн•ң RAG кө¬нҳ„ .pdf, .doc, .txt нҳ•мӢқмқҳ л¬ём„ңлҘј м—…лЎңл“ңн•ҳм—¬ RAG мұ—лҙҮмқ„ кө¬м¶•н• мҲҳ мһҲмҠөлӢҲлӢӨ. лӢөліҖкіј н•Ёк»ҳ, лӢөліҖмқҳ к·јкұ°лЎң м •ліҙлҘј к°Җм ёмҳЁ л¬ём„ңмҷҖ нҺҳмқҙм§Җк№Ңм§Җ м ңмӢңн•ҳкё° л•Ңл¬ём—җ н• лЈЁмӢңл„Өмқҙм…ҳ(кұ°м§“ м •ліҙ)мқҳ мҡ°л Ө м—Ҷмқҙ нҷңмҡ©мқҙ к°ҖлҠҘн•©лӢҲлӢӨ.

- 17. 17 мҳӨн”ҲмҶҢмҠӨм»Ём„ӨнҢ…мқҳOn-premiseLLM мҶ”лЈЁм…ҳ вҖҳMAALвҖҷмқ„ л°”нғ•мңјлЎң ліҙм•Ҳм—җ лҢҖн•ң кұұм • м—Ҷмқҙ мөңмғҒмқҳ м—…л¬ҙ нҡЁмңЁм„ұмқ„ лӢ¬м„ұн• мҲҳ мһҲлҸ„лЎқ лӢӨм–‘н•ң м—…мў…лі„ кё°м—…м—җкІҢвҖҳм•Ҳм „н•ҳкі м»ӨмҠӨн„°л§Ҳмқҙ징мқҙ мҡ©мқҙн•ң On-premise LLM кө¬м¶•вҖҷ м„ң비мҠӨлҘј м ңкіөн•ҳкі мһҲмҠөлӢҲлӢӨ. л§һм¶Өнҳ• AI мҶ”лЈЁм…ҳ м ңмӢң кё°м—… лӢҲмҰҲм—җ л§һлҠ” мөңм Ғмқҳ AI мҶ”лЈЁм…ҳ лҸ„мһ…мқҙ к°ҖлҠҘн•ҳл©°, мҶҢн”„нҠёмӣЁм–ҙ л°Ҹ н•ҳл“ңмӣЁм–ҙлҘј 묶мқҖ н•ҳлӮҳмқҳ нҢЁнӮӨм§ҖлЎң м ңкіөлҗҳм–ҙ 추к°Җм Ғмқё RAG кө¬м¶•мқҙлӮҳ к°ңл°ңм—җ мӢңк°„мқ„ л“Өмқј н•„мҡ” м—Ҷмқҙ мҰүмӢң нҡҢмӮ¬ м„ңлІ„ лӮҙ к°Җм ёлӢӨ мӮ¬мҡ©н•ҳмӢӨ мҲҳ мһҲмҠөлӢҲлӢӨ.

- 18. 18 мҳӨн”ҲмҶҢмҠӨм»Ём„ӨнҢ…мқҳOn-premiseLLM мҶ”лЈЁм…ҳ мһҗмІҙ мұ—лҙҮ м„ң비мҠӨ к°ңл°ңмқ„ мң„н•ң ChatplayлҘј м ңкіөн•©лӢҲлӢӨ. нҢҢмқјмқ„ мІЁл¶Җн•ҳлҠ” л°©мӢқмңјлЎң мһҗмӢ л§Ңмқҳ LLM/RAG мұ—лҙҮмқ„ м ңмһ‘ н• мҲҳ мһҲмҠөлӢҲлӢӨ. мғқм„ұлҗң лӢөліҖ лЎңк·ёлҘј нҶөн•ҙ м„ұлҠҘ н…ҢмҠӨнҠёлҸ„ 진н–үн•ҳл©° н”„лЎ¬н”„нҠё м—”м§ҖлӢҲм–ҙл§Ғ мӢӨн—ҳмҡ© нҲҙлЎңлҸ„ нҷңмҡ© к°ҖлҠҘн•©лӢҲлӢӨ.

- 20. 20 мҳӨн”ҲмҶҢмҠӨм»Ём„ӨнҢ…мқҳOn-premiseLLM мҶ”лЈЁм…ҳ мһҗмІҙ мұ—лҙҮ Task UIлҠ” мғқм„ұ/мҡ”м•Ҫ/мІЁмӮӯ/лІҲм—ӯ/мҪ”л“ң л“ұ 31к°ң мқҙмғҒмқҳ мӮ¬лӮҙ м—…л¬ҙлҘј мһҗлҸҷнҷ” н• мҲҳ мһҲлҸ„лЎқ мӮ¬м „ м ңмһ‘лҗң нҲҙмһ…лӢҲлӢӨ. Task Ul BuilderлҘј нҶөн•ҙ кі к°қмӮ¬м—җ л§һлҠ” м»ӨмҠӨн„°л§Ҳмқҙ징мқҙ к°ҖлҠҘн•ҳл©° н”„лЎ нҠё, л°ұм—”л“ң м—ҶмқҙлҸ„ мӣҗн•ҳлҠ” TaskлҘј мғқм„ұн•ҳм—¬ кҙҖлҰ¬н• мҲҳ мһҲмҠөлӢҲлӢӨ.

- 21. 21 III. м ңн’Ҳмқҳ м°Ёлі„м„ұ м°Ёлі„м„ұ 1 вҖ“ лҸ…ліҙм Ғмқё кё°мҲ л Ҙ м°Ёлі„м„ұ 2 вҖ“ нҡҚкё°м Ғмқё к°ҖкІ© кІҪмҹҒл Ҙ м°Ёлі„м„ұ 3 вҖ“ л§һм¶Өнҳ• м„ң비мҠӨлЎң нҷ•мһҘ м§Җмӣҗ м°Ёлі„м„ұ 4 вҖ“ мӣҗнҷңн•ң кі к°қ м§Җмӣҗ

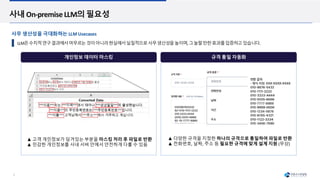

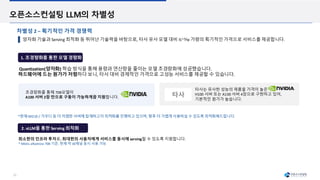

- 22. 22 мҳӨн”ҲмҶҢмҠӨм»Ём„ӨнҢ… LLMмқҳ м°Ёлі„м„ұ кёҖлЎңлІҢ мөңкі мҲҳмӨҖмқҳ ChatGPT мӮ¬мҡ©мқ„ л¬ҙлҰ¬ м—Ҷмқҙ лҢҖмІҙн• мҲҳ мһҲмқ„ л§ҢнҒј нғҒмӣ”н•ң м„ұлҠҘкіј м°Ёлі„м Ғмқё кё°лҠҘмқ„ ліҙмң н•ҳкі мһҲмҠөлӢҲлӢӨ. м°Ёлі„м„ұ 1 вҖ“ лҸ…ліҙм Ғмқё м„ұлҠҘ мҳӨн”ҲмҶҢмҠӨк°Җ кё°мЎҙм—җ ліҙмң н•ң мҳҒм–ҙм—җ лҢҖн•ң мөңмғҒкёү м–ём–ҙ лҠҘл Ҙмқ„ н•ңкөӯм–ҙлЎң м№ҳнҷҳн•ҳлҠ” CoIT н•ҷмҠө л°©мӢқмқ„ м Ғмҡ©н•ҳм—¬ н•ңкөӯм–ҙ лҠҘл Ҙмқҙ л–Ём–ҙм§ҖлҚҳ кё°мЎҙ LLMмқҳ кі м§Ҳм Ғмқё л¬ём ңлҘј н•ҙкІ°н•ҳмҳҖмҠөлӢҲлӢӨ. нҠ№нһҲ мөңк·ј Vocab нҷ•мһҘмқ„ нҶөн•ҙ н•ңкөӯм–ҙ мғқм„ұ мҶҚлҸ„ л°Ҹ context lengthк°Җ м•Ҫ 1.3л°° мҰқк°Җн•ҳлҠ” л“ұ н•ңкөӯм–ҙ м„ұлҠҘмқ„ м җм°Ё кі лҸ„нҷ”н•ҳкі мһҲмҠөлӢҲлӢӨ. 2. Catastrophic Forgetting л¬ём ң н•ҙкІ° 1. CoIT н•ҷмҠө л°©мӢқмқ„ м Ғмҡ©н•ҳм—¬ н•ңкөӯм–ҙлЎңлҸ„ мөңмғҒкёү м„ұлҠҘ ліҙмң лӢЁкі„лі„ н•ҷмҠө 진н–ү л“ұ Catastrophic Forgetting*мқ„ мҷ„нҷ”н•ҳкё° мң„н•ң н•ҷмҠөлІ•мқ„ лҒҠмһ„м—Ҷмқҙ м—°кө¬н•ҳм—¬ лҶ’мқҖ лӘЁлҚё м•Ҳм •м„ұмқ„ нҷ•ліҙн•ҳкі мһҲмҠөлӢҲлӢӨ. * Catastrophic Forgetting: мғҲлЎңмҡҙ лҚ°мқҙн„°лҘј н•ҷмҠөн•ҳл©° мқҙм „ н•ҷмҠө м •ліҙлҘј мһғлҠ” нҳ„мғҒ 3. мһҗмІҙ н•„н„°л§Ғ мӢңмҠӨн…ңмқ„ нҶөн•ң кі н’Ҳм§Ҳ н•ҷмҠө лҚ°мқҙн„° ліҙмң мһҗмІҙ н•„н„°л§Ғ мӢңмҠӨн…ңмқ„ кё°л°ҳмңјлЎң н•ҷмҠө лҚ°мқҙн„°мқҳ н’Ҳм§Ҳмқ„ кҙҖлҰ¬н•ҳкі мһҲмңјл©°, мӮ¬лһҢмқҙ кІҖмҲҳн•ҳм—¬ м •көҗн•Ёмқҙ лҶ’мқҖ кі н’Ҳм§Ҳмқҳ SFT лҚ°мқҙн„°лҘј ліҙмң н•ҳкі мһҲмҠөлӢҲлӢӨ. LLM вҖҳMAALвҖҷмқҖ лӘЁлҚё лі„ н•ңкөӯм–ҙ л¬ёмһҘ мқҙн•ҙ лҠҘл Ҙ н–ҘмғҒ нҸүк°Җ(KoBEST)лҘј нҶөн•ҙ н•ңкөӯм–ҙ м„ұлҠҘмқ„ мһ…мҰқн–Ҳмңјл©°,, вҖҳMAAL-albatross 70BвҖҷмқ„ LogicKor н”„лЎ¬н”„нҠё л°Ҹ gpt-4-turboлЎң мұ„м җн•ң кІ°кіј, ChatGPT лӘ»м§Җ м•ҠмқҖ м җмҲҳлҘј кё°лЎқн–ҲмҠөлӢҲлӢӨ. [мһҗмІҙ н•„н„°л§Ғ мӢңмҠӨн…ң мҳҲмӢң] [MAALмқҳ лӣ°м–ҙлӮң н•ңкөӯм–ҙ м„ұлҠҘ]

- 23. 23 мҳӨн”ҲмҶҢмҠӨм»Ём„ӨнҢ… LLMмқҳ м°Ёлі„м„ұ м–‘мһҗнҷ” кё°мҲ кіј Serving мөңм Ғнҷ” л“ұ лӣ°м–ҙлӮң кё°мҲ л Ҙмқ„ л°”нғ•мңјлЎң, нғҖмӮ¬ мң мӮ¬ лӘЁлҚё лҢҖ비 в…•~в…’ к°Җлҹүмқҳ нҡҚкё°м Ғмқё к°ҖкІ©мңјлЎң м„ң비мҠӨлҘј м ңкіөн•©лӢҲлӢӨ. м°Ёлі„м„ұ 2 вҖ“ нҡҚкё°м Ғмқё к°ҖкІ© кІҪмҹҒл Ҙ 2. vLLMмқ„ нҶөн•ң Serving мөңм Ғнҷ” Quantization(м–‘мһҗнҷ”) н•ҷмҠө л°©мӢқмқ„ нҶөн•ҙ мҡ©лҹүкіј м—°мӮ°лҹүмқ„ мӨ„мқҙлҠ” лӘЁлҚё мҙҲкІҪлҹүнҷ”м—җ м„ұкіөн–ҲмҠөлӢҲлӢӨ. н•ҳл“ңмӣЁм–ҙм—җ л“ңлҠ” мӣҗк°Җк°Җ м Җл ҙн•ҳлӢӨ ліҙлӢҲ, нғҖмӮ¬ лҢҖ비 кІҪм ңм Ғмқё к°ҖкІ©мңјлЎң кі м„ұлҠҘ м„ң비мҠӨлҘј м ңкіөн• мҲҳ мһҲмҠөлӢҲлӢӨ. *нҳ„мһ¬ MI210 / к°Җмҡ°л”” л“ұ лҚ” м Җл ҙн•ң м„ңлІ„м—җ нғ‘мһ¬н•ҳкі мһҗ мөңм Ғнҷ”лҘј 진н–үн•ҳкі мһҲмңјл©°, н–Ҙнӣ„ лҚ” к°ҖліҚкІҢ мӮ¬мҡ©н•ҳмӢӨ мҲҳ мһҲлҸ„лЎқ мөңм Ғнҷ”н•ҙл“ңлҰҪлӢҲлӢӨ. 1. мҙҲкІҪлҹүнҷ”лҘј нҶөн•ң лӘЁлҚё кІҪлҹүнҷ” мөңмҶҢн•ңмқҳ мқён”„лқј нҲ¬мһҗлЎң, мөңлҢҖн•ңмқҳ мӮ¬мҡ©мһҗм—җкІҢ м„ң비мҠӨлҘј лҸҷмӢңм—җ servingн• мҲҳ мһҲлҸ„лЎқ м§Җмӣҗн•©лӢҲлӢӨ. * MAAL-albatross 70B кё°мӨҖ, нҳ„мһ¬ м•Ҫ 30мұ„л„җ лҸҷмӢң мӮ¬мҡ© к°ҖлҠҘ нғҖмӮ¬ нғҖмӮ¬лҠ” мң мӮ¬н•ң м„ұлҠҘмқҳ м ңн’Ҳмқ„ к°ҖкІ©мқҙ лҶ’мқҖ H100 м„ңлІ„ лҳҗлҠ” A100 м„ңлІ„ 4мһҘмңјлЎң кө¬нҳ„н•ҳкі мһҲм–ҙ, кё°ліём Ғмқё мӣҗк°Җк°Җ лҶ’мҠөлӢҲлӢӨ. мҙҲкІҪлҹүнҷ”лҘј нҶөн•ҙ 70BлӘЁлҚёмқҙ A100 м„ңлІ„ 2мһҘ л§ҢмңјлЎң кө¬лҸҷмқҙ к°ҖлҠҘн•ҳкІҢлҒ” м§Җмӣҗн•©лӢҲлӢӨ.

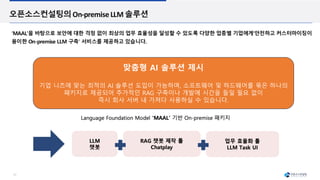

- 24. 24 мҳӨн”ҲмҶҢмҠӨм»Ём„ӨнҢ… LLMмқҳ м°Ёлі„м„ұ LLMмқ„ нҠңлӢқн•ҳм—¬ мӢӨм ң м„ң비мҠӨм—җ л§һм¶ҳ м»ӨмҠӨн„°л§Ҳмқҙ징мқ„ м§Җмӣҗн•ҙл“ңлҰҪлӢҲлӢӨ. м°Ёлі„м„ұ 3 вҖ“ л§һм¶Өнҳ• м„ң비мҠӨлЎң нҷ•мһҘ м§Җмӣҗ 1. Domain Adaptation л°©лІ•мңјлЎң м „л¬ём„ұ ліҙмһҘ 2. Function Call л°©лІ•мңјлЎң AgentлЎңм„ңмқҳ AI м§Җмӣҗ Domain Adaptation л°©лІ•мңјлЎң LLMм—җкІҢ лҸ„л©”мқё лҚ°мқҙн„°лҘј н•ҷмҠөмӢңмјң к°Ғ лҸ„л©”мқём—җ лҶ’мқҖ м „л¬ём„ұмқ„ к°–лҸ„лЎқ м§Җмӣҗн•©лӢҲлӢӨ. LLMмқҙ 충분н•ң ValueлҘј к°–кІҢ н•ҳкё° мң„н•ҳм—¬ лӢЁмҲңнһҲ м§Ҳл¬ём—җ лҢҖн•ң лӢөліҖмқ„ м ңкіөн•ҳлҠ” кІғмқ„ л„ҳм–ҙ, м§Ғм ‘ м—…л¬ҙк№Ңм§Җ мҲҳн–үн• мҲҳ мһҲкІҢлҒ” м§Җмӣҗн•©лӢҲлӢӨ. Function Call л°©лІ•мқ„ нҶөн•ҙ лӮҙвҲҷмҷёл¶Җ м„ң비мҠӨлӮҳ лҚ°мқҙн„°лІ мқҙмҠӨмҷҖ мғҒнҳёмһ‘мҡ©н•ҳм—¬ AgentлЎңм„ңмқҳ AI м„ң비мҠӨлҘј мқҙмҡ©н•ҳмӢӨ мҲҳ мһҲлҸ„лЎқ м§Җмӣҗн•©лӢҲлӢӨ. [мҳҲмӢң: Function Call л°©лІ•мқ„ нҶөн•ң мәҳлҰ°лҚ” лӮҙ мһҗлҸҷ мқјм • 추к°Җ] [Function Call кө¬мЎ°лҸ„]

- 25. 25 мҳӨн”ҲмҶҢмҠӨм»Ём„ӨнҢ… LLMмқҳ м°Ёлі„м„ұ LLMмқ„ мөңлҢҖн•ңмңјлЎң нҷңмҡ©н• мҲҳ мһҲкІҢлҒ” м§ҖмҶҚм Ғмқё кҙҖлҰ¬мҷҖ м§Җмӣҗ м„ң비мҠӨлҘј м ңкіөн•©лӢҲлӢӨ. м°Ёлі„м„ұ 4 вҖ“ мӣҗнҷңн•ң кі к°қ м§Җмӣҗ 1. LLM нҢҢнҠёл„Ҳ м»Өл®ӨлӢҲнӢ° мҙҲлҢҖ 2. м—…лҚ°мқҙнҠё л¬ҙмғҒ м§Җмӣҗ м ңн’Ҳ кө¬л§Ө мӢң, LLM нҢҢнҠёл„Ҳ м»Өл®ӨлӢҲнӢ°м—җ мҙҲмІӯн•ҙ л“ңлҰҪлӢҲлӢӨ. нҷҲнҺҳмқҙм§Җм—җм„ң MAAL м ңн’Ҳмқ„ 충분нһҲ нҷңмҡ©н• мҲҳ мһҲлҠ” к°Җмқҙл“ңлҘј м ңкіөл°ӣмқ„ мҲҳ мһҲмңјл©°, л¬ёмқҳлӮҳ к°ңм„ мҡ”мІӯмқ„ лӮЁкІЁмЈјмӢңл©ҙ PEнҢҖмқҙ мҰүк°Ғм ҒмңјлЎң лҢҖмқ‘н•ҙл“ңлҰҪлӢҲлӢӨ. Majorн•ң м—…к·ёл Ҳмқҙл“ң мӮ¬н•ӯмқ„ кё°мЎҙ кі к°қм—җкІҢ мҰүк°Ғм ҒмңјлЎң кіөм§Җн•ҙ л“ңлҰҪлӢҲлӢӨ. нҠ№нһҲ мғҲлЎңмҡҙ Open-source лӘЁлҚёмқҙ лӮҳмҳ¬ мӢң, лӘЁлҚёмқ„ л¬ҙмғҒмңјлЎң м—…лҚ°мқҙнҠён•ҙ л“ңлҰҪлӢҲлӢӨ. вҖў н•ҷмҠө мөңм Ғнҷ” кё°мҲ (Distributed Learning)мқ„ нҶөн•ҙ мғҲлЎңмҡҙ лӘЁлҚёмқ„ л№ лҘҙкІҢ м ңн’Ҳнҷ” н• мҲҳ мһҲмҠөлӢҲлӢӨ. (м•Ҫ 2-3мЈј мҶҢмҡ”) *лі„лҸ„лЎң м ңн•ң м—Ҷмқҙ 100% лҢҖмқ‘ н•ҙл“ңлҰ¬л©°, мӣҗн•ҳмӢӨ кІҪмҡ° л”°лЎң лҜёнҢ…мқ„ к°Җм§Ҳ мҲҳлҸ„ мһҲмҠөлӢҲлӢӨ. 3. м „л¬ё нҢҢнҠёл„ҲмӮ¬лҘј нҶөн•ң Vertical Service м§Җмӣҗ кё°ліём Ғмқё нҢҢмқёнҠңлӢқмқ„ мң„н•ң мҠӨнҒ¬лҰҪнҠёмҷҖ л§Өлүҙм–јмқ„ м ңкіөн•ҳкі мһҲмҠөлӢҲлӢӨ. к·ёлҹ¬лӮҳ кі к°қмқҙ лҚ” мҡ©мқҙн•ҳкІҢ GUIлҘј нҷңмҡ©н•ҳм—¬ нҢҢмқёнҠңлӢқ н•ҳкёё мӣҗн•ҳкұ°лӮҳ, ліҙлӢӨ м „л¬ём Ғмқё RAG кө¬м¶• л°Ҹ кҙҖлҰ¬лҘј мӣҗн• кІҪмҡ°, к°Ғ 분야мқҳ м „л¬ё нҢҢнҠёл„ҲмӮ¬лҘј м—°кІ°н•ҙ л“ңлҰҪлӢҲлӢӨ.

- 26. 26 www.osci.kr T. 02-516-0711 E. yhlee@osci.kr

![4

мӮ¬лӮҙ On-premise LLMмқҳ н•„мҡ”м„ұ

кё°м—…мқҳ м—…л¬ҙ н”„лЎңм„ёмҠӨлҘј мҷ„м „нһҲ нҳҒмӢ н•ҳлҠ” LLM (Large Language Model, кұ°лҢҖм–ём–ҙлӘЁлҚё)

м—…л¬ҙ мһҗлҸҷнҷ” л°Ҹ нҡЁмңЁнҷ”лҘј нҶөн•ҙ мӮ¬л¬ҙ мғқмӮ°м„ұмқ„ к·№лҢҖнҷ” кё°мЎҙм—җлҠ” мӢӨнҳ„ л¶Ҳк°Җн–ҲлҚҳ мһ‘м—…л“Өмқ„ к°ҖлҠҘн•ҳкІҢ н•ҳм—¬ мғҲлЎңмҡҙ к°Җм№ҳлҘј м°Ҫм¶ң

мҳӨлҠҳлӮ мғқм„ұнҳ•AI(LLM) кё°мҲ мқҖ мӮ¬л¬ҙ мғқмӮ°м„ұмқ„ к·№лҢҖнҷ”н•ҳкі мғҲлЎңмҡҙ к°Җм№ҳлҘј м°Ҫм¶ңн•ҳл©° нҳ„лҢҖ кё°м—…мқҳ н•„мҲҳм Ғмқё м „лһөм Ғ мҡ”мҶҢлЎң мһҗлҰ¬л§Өк№Җн•ҳкі мһҲмҠөлӢҲлӢӨ.

MITлҠ” мһ‘л…„, вҖҳChatGPT(LLM)лҘј мӮ¬мҡ©н• кІҪмҡ° нҷ”мқҙнҠём№јлқј(White-collar)

м§Ғм—…кө°мқҳ мғқмӮ°м„ұмқҙ м•Ҫ 37%лӮҳ лҚ” мҰқк°Җн•ңлӢӨвҖҷлҠ” м—°кө¬ кІ°кіјлҘј л°ңн‘ңн•ң л°” мһҲмҠөлӢҲлӢӨ.

м¶ңмІҳ: Shakked Noy&Whitney Zhang, 2023, Experimental Evidence on the Productivity Effects ofGenerative Artificial Intelligence, [MIT]

: мҶҢмҡ” мӢңк°„

мһ‘м—… нҖ„лҰ¬нӢ°

мӢӨм ңлЎң мҶҢл§Өм—… л°Ҹ м „мһҗмғҒкұ°лһҳм—… кІҪмҳҒ진мқҳ 90%к°Җ м—…л¬ҙ

ліҙмЎ°мҡ©мңјлЎң мғқм„ұнҳ• AIлҘј мӮ¬мҡ©н•ҳкі мһҲмңјл©°, мқҙлҹ¬н•ң к·ңлӘЁлҠ” м җм°Ё

мҰқк°Җн• кІғмһ…лӢҲлӢӨ.

м¶ңмІҳ: FutureCommerce

: LLM мӢңмһҘмқҙ

2030л…„к№Ңм§Җ

м—°нҸүк· 33.2%

м„ұмһҘн• кІғмңјлЎң м „л§қ

м¶ңмІҳ: MarketsandMarkets

м—…л¬ҙ мһҗлҸҷнҷ”: лӢЁмҲң л°ҳліөм Ғмқё мӮ¬лӮҙ м—…л¬ҙлҘј мһҗлҸҷнҷ”н•ҳм—¬ мӢңк°„кіј 비мҡ©мқ„

м Ҳк°җ

м •нҷ•лҸ„ н–ҘмғҒ: мқём Ғ мҳӨлҘҳлҘј мөңмҶҢнҷ”н•ҳкі мқјкҙҖлҗң л©”мӢңм§ҖлҘј м „лӢ¬

мҶ”лЈЁм…ҳ м ңкіө: лӢӨк°Ғм Ғмқё мҶ”лЈЁм…ҳмқ„ м ңкіөн•ҳл©° м—…л¬ҙлҘј нҡЁмңЁм ҒмңјлЎң ліҙмЎ°

мӮ¬лӮҙ лҚ°мқҙн„° кҙҖлҰ¬: мҲҳл§ҺмқҖ л¬ём„ң мһ‘м„ұкіј кҙҖлҰ¬, кІҖмғүмқ„ мҙқкҙ„ м§Җмӣҗ

нҳҒмӢ м Ғмқё кі к°қ кІҪн—ҳ м ңкіө: 24мӢңк°„/365мқј мҰүк°Ғм Ғмқё CS лҢҖмқ‘кіј, кі к°қ н–үлҸҷ 분м„қ л°Ҹ

мҳҲмёЎ кё°л°ҳ л§ҲмјҖнҢ…мқ„ нҶөн•ң кі к°қ л§ҢмЎұлҸ„ мҰқлҢҖ

м—…л¬ҙ н’ҲкІ© н–ҘмғҒ: м§Ғмӣҗл“Өмқҙ ліҙлӢӨ кі м°Ёмӣҗм Ғмқё м—…л¬ҙм—җ 집мӨ‘н• мҲҳ мһҲлҸ„лЎқ м§Җмӣҗ](https://image.slidesharecdn.com/llm202410-241029044603-0c34e45a/85/LLM-_202410-pdf-4-320.jpg)

![9

мӮ¬лӮҙ On-premise LLMмқҳ н•„мҡ”м„ұ

кі к°қ 1:1 л¬ёмқҳм—җ мҰүк°Ғм Ғмқё мһҗлҸҷ лӢөліҖ м ңкіө кі к°қ мҳҲм•Ҫ е…Ёкіјм • мһҗлҸҷнҷ”

в–І 1:1 л¬ёмқҳм—җ лҢҖн•ң лӢөліҖмқ„ мһҗлҸҷмңјлЎң м ңкіөн•ҳм—¬ мҰүк°Ғм Ғмқё кі к°қ мғҒлӢҙ

м§Җмӣҗ

[мҳҲм•Ҫ л¶Ҳк°Җ мӢң лҢҖм•Ҳ м ңмӢң]

[мҳҲм•Ҫм—җ н•„мҡ”н•ң лҚ°мқҙн„°

мҲҳ집]

[мҳҲм•Ҫ нҷ•м • л°Ҹ мҳҲм•ҪкёҲ

м•ҲлӮҙ]

в–І мӨ‘ліө мҳҲм•Ҫ/мҳӨлҘҳм—җ лҢҖн•ң мҡ°л Ө м—Ҷмқҙ л№ лҘҙкі мү¬мҡҙ мҳҲм•Ҫ м„ң비мҠӨ м§Җмӣҗ

в–І лҜјк°җн•ң кі к°қ к°ңмқём •ліҙлҘј мӮ¬лӮҙ м„ңлІ„ м•Ҳм—җм„ң м•Ҳм „н•ҳкІҢ лӢӨлЈ° мҲҳ мһҲмқҢ

LLMмқҖ к°Ғ кё°м—…мқҳ кі к°қл“Өм—җкІҢ 24мӢңк°„/365мқј нҳҒмӢ м Ғмқё л§һм¶Өнҳ• м„ң비мҠӨлҘј м ңкіөн•ҳл©° кё°м—…мқҳ кІҪмҹҒл Ҙмқ„ к°•нҷ”н•ҳкі мһҲмҠөлӢҲлӢӨ.

мғҲлЎңмҡҙ к°Җм№ҳлҘј м°Ҫм¶ңн•ҳлҠ” LLM Usecases](https://image.slidesharecdn.com/llm202410-241029044603-0c34e45a/85/LLM-_202410-pdf-9-320.jpg)

![13

м–ҙн”Ңлқјмқҙм–ёмҠӨнҳ•нғңлЎңм ңкіөлҗҳлҠ”MAALкё°л°ҳAll-in-oneм ңн’Ҳ

On-premise LLMмқҖ мҶҢн”„нҠёмӣЁм–ҙ л°Ҹ н•ҳл“ңмӣЁм–ҙлҘј 묶мқҖ н•ҳлӮҳмқҳ нҢЁнӮӨм§ҖлЎң м ңкіөлҗ©лӢҲлӢӨ. мҰү, 추к°Җм Ғмқё RAG кө¬м¶•мқҙлӮҳ к°ңл°ңм—җ мӢңк°„мқ„ л“Өмқј н•„мҡ” м—Ҷмқҙ

мҰүмӢң нҡҢмӮ¬ м„ңлІ„ лӮҙ к°Җм ёлӢӨ мӮ¬мҡ©н•ҳмӢӨ мҲҳ мһҲмҠөлӢҲлӢӨ.

Server

кі к°қмӮ¬ лӮҙл¶Җ л§қ

[On-premise LLM м ңн’Ҳ м•„нӮӨн…ҚмІҳ]

*API нҷңмҡ©мқ„ нҶөн•ң

м„ң비мҠӨ к°ңл°ң к°ҖлҠҘ

LLM API

Vector DB

RAG

Chatplay

Task UI

мұ—лҙҮ

LLM Engine

Service

Application

Back-end

API

Engine

мҳӨн”ҲмҶҢмҠӨм»Ём„ӨнҢ…мқҳOn-premiseLLM мҶ”лЈЁм…ҳ](https://image.slidesharecdn.com/llm202410-241029044603-0c34e45a/85/LLM-_202410-pdf-13-320.jpg)

![14

мҳӨн”ҲмҶҢмҠӨм»Ём„ӨнҢ…мқҳOn-premiseLLM мҶ”лЈЁм…ҳ

Large Language Model

Agent

RAG

кі к°қмӮ¬

лӮҙл¶Җ

мӢңмҠӨн…ң

кі к°қмӮ¬

Knowledge Base

лӮҙл¶Җ м„ң비мҠӨ (м§Ғмӣҗ мӮ¬л¬ҙ мғқмӮ°м„ұ н–ҘмғҒ) мҷёл¶Җ м„ң비мҠӨ(м—…л¬ҙ л¬ҙмқёнҷ” + кі к°қ л§ҢмЎұлҸ„ н–ҘмғҒ)

л¬ём„ң мҡ”м•Ҫ

лІҲм—ӯ

ліҙкі м„ң мІЁмӮӯ

лӢЁмң„ нҶөмқј

мҪ”л“ң мһ‘м„ұ

нҷҚліҙ л¬ёкө¬ мғқм„ұ

кі к°қ мғҒлӢҙ мҳҲм•Ҫ м ‘мҲҳ м ңн’Ҳ 추мІң

*мҷёл¶Җ мң м¶ңмқҙ

л¶Ҳк°Җн•ң мһҗлЈҢлҠ”

Data Baseм—җ м Ғмһ¬

Service

System

AI м ңкіө мҶ”лЈЁм…ҳ

к°Җл“ңл Ҳмқј

[On-premise LLM м„ң비мҠӨ н”„лЎңм„ёмҠӨ]

мҳӨн”ҲмҶҢмҠӨм»Ём„ӨнҢ…мқҳ MAAL мҶ”лЈЁм…ҳмқҖ кі к°қмӮ¬ лӮҙл¶Җ л§қм—җ нғ‘мһ¬лҗҳм–ҙ лӢӨм–‘н•ң лҢҖлӮҙ/лҢҖмҷё м„ң비мҠӨлҘј кө¬нҳ„н•ҙл“ңлҰҪлӢҲлӢӨ.

кі к°қмӮ¬ лӮҙл¶Җ л§қ (On-premise)](https://image.slidesharecdn.com/llm202410-241029044603-0c34e45a/85/LLM-_202410-pdf-14-320.jpg)

![22

мҳӨн”ҲмҶҢмҠӨм»Ём„ӨнҢ… LLMмқҳ м°Ёлі„м„ұ

кёҖлЎңлІҢ мөңкі мҲҳмӨҖмқҳ ChatGPT мӮ¬мҡ©мқ„ л¬ҙлҰ¬ м—Ҷмқҙ лҢҖмІҙн• мҲҳ мһҲмқ„ л§ҢнҒј нғҒмӣ”н•ң м„ұлҠҘкіј м°Ёлі„м Ғмқё кё°лҠҘмқ„ ліҙмң н•ҳкі мһҲмҠөлӢҲлӢӨ.

м°Ёлі„м„ұ 1 вҖ“ лҸ…ліҙм Ғмқё м„ұлҠҘ

мҳӨн”ҲмҶҢмҠӨк°Җ кё°мЎҙм—җ ліҙмң н•ң мҳҒм–ҙм—җ лҢҖн•ң мөңмғҒкёү м–ём–ҙ лҠҘл Ҙмқ„ н•ңкөӯм–ҙлЎң м№ҳнҷҳн•ҳлҠ” CoIT н•ҷмҠө

л°©мӢқмқ„ м Ғмҡ©н•ҳм—¬ н•ңкөӯм–ҙ лҠҘл Ҙмқҙ л–Ём–ҙм§ҖлҚҳ кё°мЎҙ LLMмқҳ кі м§Ҳм Ғмқё л¬ём ңлҘј н•ҙкІ°н•ҳмҳҖмҠөлӢҲлӢӨ.

нҠ№нһҲ мөңк·ј Vocab нҷ•мһҘмқ„ нҶөн•ҙ н•ңкөӯм–ҙ мғқм„ұ мҶҚлҸ„ л°Ҹ context lengthк°Җ м•Ҫ 1.3л°° мҰқк°Җн•ҳлҠ” л“ұ

н•ңкөӯм–ҙ м„ұлҠҘмқ„ м җм°Ё кі лҸ„нҷ”н•ҳкі мһҲмҠөлӢҲлӢӨ.

2. Catastrophic Forgetting л¬ём ң н•ҙкІ°

1. CoIT н•ҷмҠө л°©мӢқмқ„ м Ғмҡ©н•ҳм—¬ н•ңкөӯм–ҙлЎңлҸ„ мөңмғҒкёү м„ұлҠҘ ліҙмң

лӢЁкі„лі„ н•ҷмҠө 진н–ү л“ұ Catastrophic Forgetting*мқ„ мҷ„нҷ”н•ҳкё° мң„н•ң

н•ҷмҠөлІ•мқ„ лҒҠмһ„м—Ҷмқҙ м—°кө¬н•ҳм—¬ лҶ’мқҖ лӘЁлҚё м•Ҳм •м„ұмқ„ нҷ•ліҙн•ҳкі мһҲмҠөлӢҲлӢӨ.

* Catastrophic Forgetting: мғҲлЎңмҡҙ лҚ°мқҙн„°лҘј н•ҷмҠөн•ҳл©° мқҙм „ н•ҷмҠө м •ліҙлҘј мһғлҠ” нҳ„мғҒ

3. мһҗмІҙ н•„н„°л§Ғ мӢңмҠӨн…ңмқ„ нҶөн•ң кі н’Ҳм§Ҳ н•ҷмҠө лҚ°мқҙн„° ліҙмң

мһҗмІҙ н•„н„°л§Ғ мӢңмҠӨн…ңмқ„ кё°л°ҳмңјлЎң н•ҷмҠө лҚ°мқҙн„°мқҳ н’Ҳм§Ҳмқ„ кҙҖлҰ¬н•ҳкі мһҲмңјл©°,

мӮ¬лһҢмқҙ кІҖмҲҳн•ҳм—¬ м •көҗн•Ёмқҙ лҶ’мқҖ кі н’Ҳм§Ҳмқҳ SFT лҚ°мқҙн„°лҘј ліҙмң н•ҳкі мһҲмҠөлӢҲлӢӨ.

LLM вҖҳMAALвҖҷмқҖ лӘЁлҚё лі„ н•ңкөӯм–ҙ л¬ёмһҘ мқҙн•ҙ лҠҘл Ҙ н–ҘмғҒ нҸүк°Җ(KoBEST)лҘј нҶөн•ҙ

н•ңкөӯм–ҙ м„ұлҠҘмқ„ мһ…мҰқн–Ҳмңјл©°,, вҖҳMAAL-albatross 70BвҖҷмқ„ LogicKor н”„лЎ¬н”„нҠё л°Ҹ

gpt-4-turboлЎң мұ„м җн•ң кІ°кіј, ChatGPT лӘ»м§Җ м•ҠмқҖ м җмҲҳлҘј кё°лЎқн–ҲмҠөлӢҲлӢӨ.

[мһҗмІҙ н•„н„°л§Ғ мӢңмҠӨн…ң мҳҲмӢң]

[MAALмқҳ лӣ°м–ҙлӮң н•ңкөӯм–ҙ м„ұлҠҘ]](https://image.slidesharecdn.com/llm202410-241029044603-0c34e45a/85/LLM-_202410-pdf-22-320.jpg)

![24

мҳӨн”ҲмҶҢмҠӨм»Ём„ӨнҢ… LLMмқҳ м°Ёлі„м„ұ

LLMмқ„ нҠңлӢқн•ҳм—¬ мӢӨм ң м„ң비мҠӨм—җ л§һм¶ҳ м»ӨмҠӨн„°л§Ҳмқҙ징мқ„ м§Җмӣҗн•ҙл“ңлҰҪлӢҲлӢӨ.

м°Ёлі„м„ұ 3 вҖ“ л§һм¶Өнҳ• м„ң비мҠӨлЎң нҷ•мһҘ м§Җмӣҗ

1. Domain Adaptation л°©лІ•мңјлЎң м „л¬ём„ұ ліҙмһҘ

2. Function Call л°©лІ•мңјлЎң AgentлЎңм„ңмқҳ AI м§Җмӣҗ

Domain Adaptation л°©лІ•мңјлЎң LLMм—җкІҢ лҸ„л©”мқё лҚ°мқҙн„°лҘј н•ҷмҠөмӢңмјң к°Ғ лҸ„л©”мқём—җ лҶ’мқҖ м „л¬ём„ұмқ„ к°–лҸ„лЎқ

м§Җмӣҗн•©лӢҲлӢӨ.

LLMмқҙ 충분н•ң ValueлҘј к°–кІҢ н•ҳкё° мң„н•ҳм—¬ лӢЁмҲңнһҲ м§Ҳл¬ём—җ лҢҖн•ң лӢөліҖмқ„ м ңкіөн•ҳлҠ” кІғмқ„ л„ҳм–ҙ, м§Ғм ‘ м—…л¬ҙк№Ңм§Җ мҲҳн–үн• мҲҳ мһҲкІҢлҒ” м§Җмӣҗн•©лӢҲлӢӨ.

Function Call л°©лІ•мқ„ нҶөн•ҙ лӮҙвҲҷмҷёл¶Җ м„ң비мҠӨлӮҳ лҚ°мқҙн„°лІ мқҙмҠӨмҷҖ мғҒнҳёмһ‘мҡ©н•ҳм—¬ AgentлЎңм„ңмқҳ AI м„ң비мҠӨлҘј мқҙмҡ©н•ҳмӢӨ мҲҳ мһҲлҸ„лЎқ м§Җмӣҗн•©лӢҲлӢӨ.

[мҳҲмӢң: Function Call л°©лІ•мқ„ нҶөн•ң мәҳлҰ°лҚ” лӮҙ мһҗлҸҷ мқјм • 추к°Җ]

[Function Call кө¬мЎ°лҸ„]](https://image.slidesharecdn.com/llm202410-241029044603-0c34e45a/85/LLM-_202410-pdf-24-320.jpg)