± ∞‰¥°§Œ◊Ó÷’–ŒÃ¨≥“± ≥¢≥’≤—§ŒΩ‚’h

- 2. ?◊‘?º∫ΩBΩÈ ?¬∂¬∂∆È∫Γ„£®§ƒ§Ê§∂§≠ ?§≥§¶§≠£© ?¿Ì¿ÌªØ—ß—–æøÀ˘ ?«ÈàÛª˘±P•ª•Û•ø©` ? ? ? ? ?•–•§•™•§•Û•’•©•Þ•∆•£•Ø•π—–æøÈ_∞k•Ê•À•√•» ? ? ?£®RIKEN ?ACCC ?BiT£© ? ? ? ? ?ÃÿÑe—–æøÜT ?Single-©\??cell ?RNA-©\??Seq§Œ•«©`•øΩ‚Œˆ°¢Ω‚Œˆ? ÷∑®?•Ω•’•»•¶•ß•¢ È_∞k§Ú§‰§√§∆§§§Þ§π ?þBΩjœ» -©\?? ?@antiplastics -©\?? ?koki.tsuyuzaki ?[at] ?gmail.com

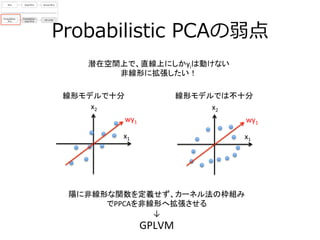

- 3. GPLVM§√§∆§∞§∞§√§∆§þ§Î§»... § §Î§€§…°¢§Ô§´§È§Û£Ð(^o^)£Ø °˙ ?“ªÃ°¢∫Œ§Ú§∑§∆§§§Î§Œ§´§Ø§È§§§œ¿ÌΩ‚§∑§ø§§ PCA£®÷˜≥…∑÷∑÷Œˆ£©§Œ•…∞k’π∞ʧÀœýµ±§π§Î°¢•¨•¶•πþ^≥çڔ√§§§ø GPLVM§Ú°≠by ?Small ?Data ?Scien3st ?Memorandum ? PCA§Œ§™ªØ§±§Œ§Ë§¶§ ÷∑®§»§«§‚§§§®§–§Ë§§§Œ§«§∑§Á§¶§´°£ ? by ?æ©∂º¥Û—ß“Ω—ß≤øΩy”ãþzŪ—ß∑÷“∞ ?

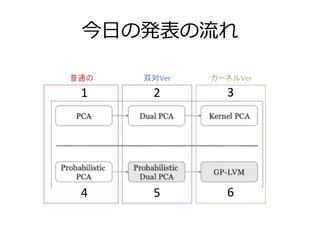

- 4. ΩÒ?»’§Œ∞k±Ì§Œ¡˜¡˜§Ï 1 2 3 4 5 6 Probabilis3c ?PCA ?with ?GPLVM §≥§ŒÌò∑¨§À‘í§∑§Þ§π

- 5. ΩÒ?»’§Œ∞k±Ì§Œ¡˜¡˜§Ï 1 2 3 4 5 6 õQ∂®’쵃§ Ω‚∑® ¥_¬ ’쵃§ Ω‚∑®

- 6. ΩÒ?»’§Œ∞k±Ì§Œ¡˜¡˜§Ï 1 2 3 4 5 6 ∆’Õ®§Œ •´©`•Õ•ÎVer À´åùVer

- 7. ΩÒªÿ§Œ•«©`•ø p¥Œ‘™§Œ•«©`•ø•ª•√•»X§Úd¥Œ‘™§Œ•«©`•ø•ª•√•»Y§À§π§Î£®¥Œ‘™àRøs£© •«©`•ø°¢•µ•Û•◊•Î£®n£© ¥Œ‘™°¢â‰ ˝°¢â‰¡ø ? £®p£© ? •«©`•ø°¢•µ•Û•◊•Î£®n£© µÕ¥Œ‘™ ? £®d, ?2,3¥Œ‘™§Ø§È§§ §¨∂ý§§£© ? X Y X§œ§¢§È§´§∏§·•«©`•ø§¥§»§À∆Ωæ˘Ç駨 “˝§´§Ï§∆§§§Î§‚§Œ§»§π§Î

- 8. øº§®§Î…œ§«§Œ•ð•§•Û•» n p ? X n p ? X XT p ? n = = XT n p ? 2∑NÓ꧌––¡–§¨µ«àˆ ? £®–Œ§¿§±§À◊¢ƒø£© n n p p S G •∞•È•ý––¡–§»Õ¨§∏–Œ ? ? p>>n§Œàˆ∫œ°¢•µ•§•∫§¨–°§µ§§ ? °˙ ?”ãÀ„§¨ÀŸ§§£®Dual ?PCA£© ? ? •´©`•Õ•Î∑®§»ÈvþB§π§Î ? °˙ ?∑«æÄ–Œ–‘§ÚíQ§®§Î£®Kernel ?PCA£© ? ? §≥§√§¡§Œ∑Ω§¨Ê“§∑§§ ¬§¨∂ý§§ ? π≤∑÷…¢––¡–§»Õ¨§∏–Œ ? £®Õ®≥£§ŒPCA§»ÈvÇS£©

- 9. —a?◊„ ?: ?πÔ–Çé∑÷Ω‚§»§œ §¢§Î’˝∑Ω––¡–A§À•Ÿ•Ø•»•Îu§Ú§´§±§ø§»§≠§À°¢u§Œ∂® ˝±∂¶À§À § §Îàˆ∫œ°¢u§ÚA§ŒπÔ–•Ÿ•Ø•»•Î°¢¶À§ÚπÔ–Ç駻§§§¶ =Au = ¶Àu ¶À, u§Œæþõƒ§ «Û§·∑Ω A§¨4¥Œ‘™“‘œ¬ °˙ ÷”ãÀ„£®πÔ–∑Ω≥Ã Ω§ÚΩ‚§Ø£© §Ω§Ï“‘…œ °˙ ˝Çé”ãÀ„£®§Ÿ§≠Å\∑®°¢•‰•≥•”∑®§ §…£© πÔ–Ç駜°¢––¡–§Œ¥Œ‘™§¿§±¥Ê‘⁄§π§Î§Œ§«°¢––¡–§«§Þ§»§·§∆ﯧا» AU =U¶´ = UT AU = ¶´ A =U¶´UT °∞•π•⁄•Ø•»•Î∑÷Ω‚°± °∞––¡–§ŒåùΩ«ªØ°±

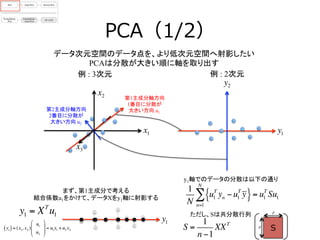

- 10. PCA£®1/2£© y1 •«©`•ø¥Œ‘™ø’Èg§Œ•«©`•øµ„§Ú°¢§Ë§ÍµÕ¥Œ‘™ø’Èg§ÿ…‰”∞§∑§ø§§ PCA§œ∑÷…¢§¨¥Û§≠§§Ìò§ÀðS§Ú»°§Í≥ˆ§π ¿˝ : 3¥Œ‘™ ¿˝ : 2¥Œ‘™ y2 x3 x1 x2 µ⁄1÷˜≥…∑÷ðS∑ΩœÚ 1∑¨ƒø§À∑÷…¢§¨ ¥Û§≠§§∑ΩœÚ u1 µ⁄2÷˜≥…∑÷ðS∑ΩœÚ 2∑¨ƒø§À∑÷…¢§¨ ¥Û§≠§§∑ΩœÚ u2 §Þ§∫°¢µ⁄1÷˜≥…∑÷§«øº§®§Î ΩY∫œÇS ˝u1§Ú§´§±§∆°¢•«©`•øX§Úy1ðS§À…‰”∞§π§Î y1 = XT u1 y1 y1ðS§«§Œ•«©`•ø§Œ∑÷…¢§œ“‘œ¬§ŒÕ®§Í 1 N u1 T yn ?u1 T y{ } n=1 N °∆ = u1 T Su1 §ø§¿§∑°¢S§œπ≤∑÷…¢––¡– Sp p S = 1 n ?1 XXT y1( )= (x1, x2 ) u1 u2 ! " # # $ % & & = u1x1 +u2 x2

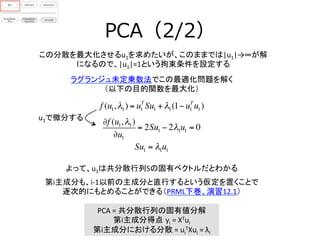

- 11. PCA£®2/2£© §≥§Œ∑÷…¢§Ú◊ӥ۪اµ§ª§Îu1§Ú«Û§·§ø§§§¨°¢§≥§Œ§Þ§Þ§«§œ|u1|°˙°Þ§¨Ω‚ §À§ §Î§Œ§«°¢|u1|=1§»§§§¶æ– ¯Ãıº˛§Ú‘O∂®§π§Î µ⁄i÷˜≥…∑÷§‚°¢i-?©\1“‘«∞§Œ÷˜≥…∑÷§»÷±––§π§Î§»§§§¶Å¢∂®§Ú÷√§Ø§≥§»§« ? ÷¥Œµƒ§À§‚§»§·§Î§≥§»§¨§«§≠§Î£®PRMLœ¬éÜ°¢—ð¡ï12.1£© PCA ?= ?π≤∑÷…¢––¡–§ŒπÔ–Çé∑÷Ω‚ ? µ⁄i÷˜≥…∑÷µ√µ„ yi ?= ?XTui ? µ⁄i÷˜≥…∑÷§À§™§±§Î∑÷…¢ ?= ?ui TXui ?= ?¶Ài f (u1,¶À1) = u1 T Su1 + ¶À1(1?u1 T u1) •È•∞•È•Û•∏•ÂŒ¥∂®Å\ ˝∑®§«§≥§Œ◊ÓþmªØÜñÓ}§ÚΩ‚§Ø ? £®“‘œ¬§ŒƒøµƒÈv ˝§Ú◊ӥ۪أ© u1§«Œ¢∑÷§π§Î ?f (u1,¶À1) ?u1 = 2Su1 ? 2¶À1u1 = 0 Su1 = ¶À1u1 §Ë§√§∆°¢u1§œπ≤∑÷…¢––¡–S§ŒπÔ–•Ÿ•Ø•»•Î§¿§»§Ô§´§Î

- 12. —a?◊„ ?: ?À´åù§»§œ À´åùÜñÓ} f(x, y) = 2x2 + 3y2§Ú◊Ó–°§À§π§Î (x, y)§Ú«Û§·§Ë §ø§¿§∑°¢x + y = 1§»§π§Î g(x, y) = x + y§Ú◊Ó¥Û§À§π§Î (x, y)§Ú«Û§·§Ë §ø§¿§∑°¢2x2+3y2 = 3/5§»§π§Î x + y = 1 £®æ– ¯Ãıº˛°¢πÃ∂®£© r=3/5 r=1 r=2 ƒøµƒÈv ˝ g(x, y) = x + y = s 2x2 + 3y2 = 3/5 £®æ– ¯Ãıº˛°¢πÃ∂®£© ƒøµƒÈv ˝ ? f(x, ?y) ?= ?2x2 ?+ ?3y2 ?= ?r s=0 s=1/2 s=1 §…§¡§È§´§Ú’h§§§ø§È°¢ÅI∑ΩΩ‚§§§ø§≥§»§À§ §ÎÈvÇS§À§ §Îàˆ∫œ°¢ ? À´åù£®Dual, ?Duality£©§»§§§¶ ÷˜ÜñÓ} §≥§Ï§È§œ±æŸ|µƒ§ÀÕ¨§∏ÜñÓ}§ÚΩ‚§§§∆§§§Î ?

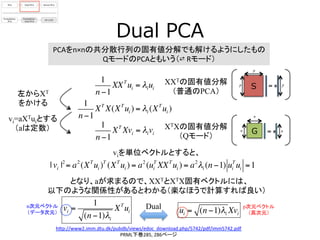

- 13. Dual ?PCA PCA§Ún°¡n§Œπ≤∑÷…¢––¡–§ŒπÔ–Çé∑÷Ω‚§«§‚Ω‚§±§Î§Ë§¶§À§∑§ø§‚§Œ ? Q•‚©`•…§ŒPCA§»§‚§§§¶£®? ?R•‚©`•…£© ? h[p://www2.imm.dtu.dk/pubdb/views/edoc_download.php/5742/pdf/imm5742.pdf ? PRMLœ¬éÜ285, ?286•⁄©`•∏ 1 n ?1 XXT ui = ¶Àiui XXT§ŒπÔ–Çé∑÷Ω‚ £®∆’Õ®§ŒPCA£© 1 n ?1 XT X(XT ui ) = ¶Ài (XT ui ) ◊Û§´§ÈXT §Ú§´§±§Î XTX§ŒπÔ–Çé∑÷Ω‚ £®Q•‚©`•…£© 1 n ?1 XT Xvi = ¶Àivi vi§ÚÖgŒª•Ÿ•Ø•»•Î§»§π§Î§»°¢ vi=aXTui§»§π§Î £®a§œ∂® ˝£© | vi |2 = a2 (XT ui )T (XT ui ) = a2 (ui T XXT ui ) = a2 ¶Ài (n ?1) ui T ui =1 vi = 1 (n ?1)¶Ài XT ui §»§ §Í°¢a§¨«Û§Þ§Î§Œ§«°¢XXT§»XTXπÔ–•Ÿ•Ø•»•Î§À§œ°¢ “‘œ¬§Œ§Ë§¶§ ÈvÇS–‘§¨§¢§Î§»§Ô§´§Î£®òS§ §€§¶§«”ãÀ„§π§Ï§–¡º§§£© ui = (n ?1)¶Ài Xvi S =p p p G =n n n Dualn¥Œ‘™•Ÿ•Ø•»•Î £®•«©`•ø¥Œ‘™£© p¥Œ‘™•Ÿ•Ø•»•Î £®∏þ¥Œ‘™£©

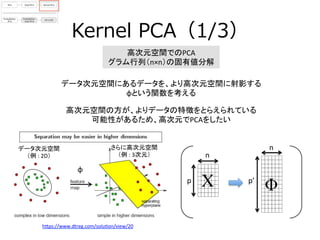

- 14. Kernel ?PCA£®1/3£© ∏þ¥Œ‘™ø’Èg§«§ŒPCA ? •∞•È•ý––¡–£®n°¡n£©§ŒπÔ–Çé∑÷Ω‚ •«©`•ø¥Œ‘™ø’Èg§À§¢§Î•«©`•ø§Ú°¢§Ë§Í∏þ¥Œ‘™ø’Èg§À…‰”∞§π§Î ? ¶’§»§§§¶Èv ˝§Úøº§®§Î h[ps://www.dtreg.com/solu3on/view/20 ? ∏þ¥Œ‘™ø’Èg§Œ∑Ω§¨°¢§Ë§Í•«©`•ø§ŒÃÿè’§Ú§»§È§®§È§Ï§∆§§§Î ? ø…ƒÐ–‘§¨§¢§Î§ø§·°¢∏þ¥Œ‘™§«PCA§Ú§∑§ø§§ ? •«©`•ø¥Œ‘™ø’Èg ? £®¿˝ ?: ?2D£© §µ§È§À∏þ¥Œ‘™ø’Èg ? £®¿˝ ?: ?3¥Œ‘™£© ¶’ X ¶µ n n p p°Ø

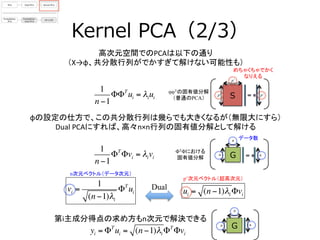

- 15. Kernel ?PCA£®2/3£© ∏þ¥Œ‘™ø’Èg§«§ŒPCA§œ“‘œ¬§ŒÕ®§Í ? £®X°˙¶’°¢π≤∑÷…¢––¡–§¨§«§´§π§Æ§∆Ω‚§±§ §§ø…ƒÐ–‘§‚£© 1 n ?1 ¶µ¶µT ui = ¶Àiui ¶’¶’T§ŒπÔ–Çé∑÷Ω‚ £®∆’Õ®§ŒPCA£© ¶µT¶µ§À§™§±§Î πÔ–Çé∑÷Ω‚ 1 n ?1 ¶µT ¶µvi = ¶Àivi S =p' p' p' G =n n n ¶’§Œ‘O∂®§Œ À∑Ω§«°¢§≥§Œπ≤∑÷…¢––¡–§œé◊§È§«§‚¥Û§≠§Ø§ §Î§¨£®üoœÞ¥Û§À§π§È£© ? Dual ?PCA§À§π§Ï§–°¢∏þ°©n°¡n––¡–§ŒπÔ–Çé∑÷Ω‚§»§∑§∆Ω‚§±§Î ? §·§¡§„§Ø§¡§„§«§´§Ø § §Í§®§Î vi = 1 (n ?1)¶Ài ¶µT ui ui = (n ?1)¶Ài ¶µvi n¥Œ‘™•Ÿ•Ø•»•Î£®•«©`•ø¥Œ‘™£© p°Ø¥Œ‘™•Ÿ•Ø•»•Î£®≥¨∏þ¥Œ‘™£© yi = ¶µT ui = (n ?1)¶Ài ¶µT ¶µvi µ⁄i÷˜≥…∑÷µ√µ„§Œ«Û§·∑Ω§‚n¥Œ‘™§«Ω‚õQ§«§≠§Î ? •«©`•ø ˝ Gn n n Dual

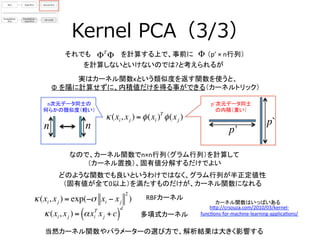

- 16. Kernel ?PCA£®3/3£© ¶µT ¶µ§Ω§Ï§«§‚ ? µ±»ª•´©`•Õ•ÎÈv ˝§‰•—•È•·©`•ø©`§Œþx§”∑Ω§«°¢Ω‚ŒˆΩYπ˚§œ¥Û§≠§Ø”∞Ìë§π§Î ? åg§œ•´©`•Õ•ÎÈv ˝¶ §»§§§¶ÓêÀ∆∂»§Ú∑µ§πÈv ˝§Ú 𧶧»°¢ ? ¶µ §ÚÍñ§À”ãÀ„§ª§∫§À°¢ƒ⁄∑eÇ駿§±§Úµ√§Î ¬§¨§«§≠§Î£®•´©`•Õ•Î•»•Í•√•Ø£© ? §…§Œ§Ë§¶§ Èv ˝§«§‚¡º§§§»§§§¶§Ô§±§«§œ§ §Ø°¢•∞•È•ý––¡–§¨∞Î’˝∂®Çé–‘ ? £®πÔ–Ç駨»´§∆0“‘…œ£©§Úú∫§ø§π§‚§Œ§¿§±§¨°¢•´©`•Õ•ÎÈv ˝§À§ §Ï§Î ? §Ú”ãÀ„§π§Î…œ§«°¢ ¬«∞§À ? §Ú”ãÀ„§∑§ §§§»§§§±§ §§§Œ§«§œ?§»øº§®§È§Ï§Î§¨ ? ¶µ ¶ (xi, xj ) = ¶’(xi )T ¶’(xj ) n¥Œ‘™•«©`•øÕ¨ ø§Œ ∫Œ§È§´§ŒÓêÀ∆∂»£®ðX§§£© p°Ø¥Œ‘™•«©`•øÕ¨ ø §Œƒ⁄∑e£®÷ÿ§§£© nn p' p` RBF•´©`•Õ•Î ? •´©`•Õ•ÎÈv ˝§œ§§§√§—§§§¢§Î ? ¶ (xi, xj ) = exp(?¶“ xi ? xj 2 ) ¶ (xi, xj ) = ¶¡xi T xj +c( ) d h[p://crsouza.com/2010/03/kernel-?©\ func3ons-?©\for-?©\machine-?©\learning-?©\applica3ons/ ? ∂ýÌó Ω•´©`•Õ•Î ? £®p°Ø ?°¡ ?n––¡–£© ? § §Œ§«°¢•´©`•Õ•ÎÈv ˝§«n°¡n––¡–£®•∞•È•ý––¡–£©§Ú”ãÀ„§∑§∆ ? £®•´©`•Õ•Î÷√ìQ£©°¢πÔ–Çé∑÷Ω‚§π§Î§¿§±§«§Ë§§ ?

- 17. p(xi | yi ) Probabilistic ?PCA PCA§Œ¥_¬ µƒΩ‚∑® ? xi = Wyi +¶≈ “‘œ¬§Œ§Ë§¶§ ¥_¬ •‚•«•Î§Úøº§®§Î x1 x1 x2 x2 wy1 w§«…‰”∞ ? £®1D°˙2D£© µ»∑Ω–‘ ? •¨•¶•π•Œ•§•∫ p(y1) y1 «±‘⁄ø’Èg£®÷˜≥…∑÷£©§Úœ»§À‘O∂® wy1 x1 wy1 •«©`•ø§Œ•‚•«•Î§ÿ§Œ ? þm∫œ∂»£®”»∂»£©§Ú”ãÀ„ x2 p(yi ) = N(yi | 0, I) p(xi | yi ) = N(xi |Wyi,¶¬?1 I) °˚ ?•¨•¶•π£° •¨•¶•π£°£° ? °˝ yi§Œ ¬«∞∑÷≤º xi§Œ”»∂» ¿˝ ?: ?£≤¥Œ‘™ ?°˙ ?1¥Œ‘™

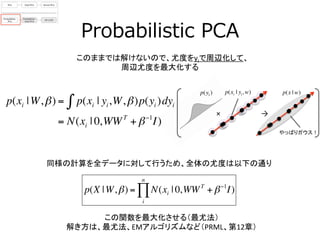

- 18. Probabilistic ?PCA §≥§Œ§Þ§Þ§«§œΩ‚§±§ §§§Œ§«°¢”»∂»§Úyi§«÷ÐÞxªØ§∑§∆°¢ ÷ÐÞx”»∂»§Ú◊ӥ۪اπ§Î p(xi |W,¶¬) = p(xi | yi,W,¶¬)p(yi )dyi°“ = N(xi | 0,WWT + ¶¬?1 I) Õ¨ò”ãÀ„§Ú»´•«©`•ø§Àåù§∑§∆––§¶§ø§·°¢»´Ã§Œ”»∂»§œ“‘œ¬§ŒÕ®§Í ? p(X |W,¶¬) = N(xi | 0,WWT + ¶¬?1 I) i n °« §≥§ŒÈv ˝§Ú◊ӥ۪اµ§ª§Î£®◊Ó”»∑®£© ? Ω‚§≠∑Ω§œ°¢◊Ó”»∑®°¢EM•¢•Î•¥•Í•∫•ý§ §…£®PRML°¢µ⁄12’¬£© ? °¡ °˙ §‰§√§—§Í•¨•¶•π£° p(y1) p(x | w)p(xi | yi,w)

- 19. Probabilistic ?PCA§Œ»ıµ„ «±‘⁄ø’Èg…œ§«°¢÷±æÄ…œ§À§∑§´yi§œÑ”§±§ §§ ? ∑«æÄ–Œ§Àíàèà§∑§ø§§£° x1 x2 wy1 x1 x2 wy1 æÄ–Œ•‚•«•Î§« Æ∑÷ æÄ–Œ•‚•«•Î§«§œ≤ª Æ∑÷ Íñ§À∑«æÄ–Œ§ Èv ˝§Ú∂®¡x§ª§∫°¢•´©`•Õ•Î∑®§ŒñòΩM§þ §«PPCA§Ú∑«æÄ–Œ§ÿíàè৵§ª§Î ? °˝ ? GPLVM

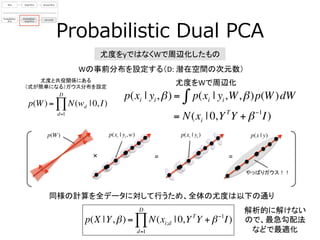

- 20. Probabilistic ?Dual ?PCA ”»∂»§Úy§«§œ§ §ØW§«÷ÐÞxªØ§∑§ø§‚§Œ ”»∂»§ÚW§«÷ÐÞxªØ p(xi | yi,¶¬) = p(xi | yi,W,¶¬)p(W)dW°“ = N(xi | 0,YT Y + ¶¬?1 I) Õ¨ò”ãÀ„§Ú»´•«©`•ø§Àåù§∑§∆––§¶§ø§·°¢»´Ã§Œ”»∂»§œ“‘œ¬§ŒÕ®§Í ? p(X |Y,¶¬) = N(xi;d | 0,YT Y + ¶¬?1 I) d=1 D °« W§Œ ¬«∞∑÷≤º§Ú‘O∂®§π§Î£®D: ?«±‘⁄ø’Èg§Œ¥Œ‘™ ˝£© ? p(W) = N(wd | 0, I) d=1 D °« = §‰§√§—§Í•¨•¶•π£°£° p(W) p(x | y)p(xi | yi ) ”»∂»§»π≤“€ÈvÇS§À§¢§Î ? £® Ω§¨∫ÜÖg§À§ §Î£©•¨•¶•π∑÷≤º§Ú‘O∂® =°¡ p(xi | yi,w) Ω‚Œˆµƒ§ÀΩ‚§±§ §§ §Œ§«°¢◊Óº±π¥≈‰∑® § §…§«◊ÓþmªØ ?

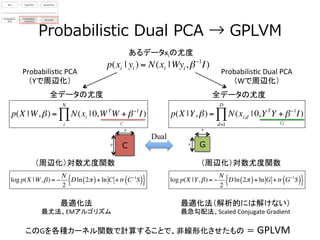

- 21. Probabilistic ?Dual ?PCA ?°˙ ?GPLVM §¢§Î•«©`•øxi§Œ”»∂» ? p(X |Y,¶¬) = N(xi;d | 0,YT Y + ¶¬?1 I) d=1 D °«p(X |W,¶¬) = N(xi | 0,WT W + ¶¬?1 I) i N °« Probabilis3c ?PCA ? £®Y§«÷ÐÞxªØ£© Probabilis3c ?Dual ?PCA ? £®W§«÷ÐÞxªØ£© p(xi | yi ) = N(xi |Wyi,¶¬?1 I) §≥§ŒG§Ú∏˜∑N•´©`•Õ•ÎÈv ˝§«”ãÀ„§π§Î§≥§»§«°¢∑«æÄ–ŒªØ§µ§ª§ø§‚§Œ £Ω GPLVM Gn n Dual GC Cp p £®÷ÐÞxªØ£©åù ˝”»∂»Èv ˝ ◊ÓþmªØ∑® ? ◊Ó”»∑®°¢EM•¢•Î•¥•Í•∫•ý ◊ÓþmªØ∑®£®Ω‚Œˆµƒ§À§œΩ‚§±§ §§£© ? ? ◊Óº±π¥≈‰∑®°¢Scaled ?Conjugate ?Gradient £®÷ÐÞxªØ£©åù ˝”»∂»Èv ˝ »´•«©`•ø§Œ”»∂» ? »´•«©`•ø§Œ”»∂» ? log p(X |W,¶¬) = ? N 2 Dln 2¶–( )+ ln C +tr C?1 S( ){ } log p(X |Y,¶¬) = ? N 2 Dln 2¶–( )+ ln G +tr G?1 S( ){ }

- 22. §¡§ §þ§À »À§ŒÑ”◊˜§Œ•»•È•√•≠•Û•∞—–æø§«◊Ó≥ı§Àþm”√§µ§Ï§øΩUæ林§È°¢∞Ù»ÀÈg§¨§Ë§Øµ«àˆ§π§Î ? ? öi§Ø°¢Ôw§÷§ §…“ªþB§ŒÑ”◊˜§œ°¢…Ÿ ˝§ŒÑ”◊˜•—•ø©`•Û§ŒΩM§þ∫œ§Ô§ª§«§∑§´§ §§ ? °˙ ?«±‘⁄ø’Èg§«Õ¨§∏§»§≥§Ì§Ú∑«æÄ–Œ§À§∞§Î§∞§Îªÿ§Î ”ãúy•«©`•ø ? £®•«©`•øø’Èg£© ÷˜≥…∑÷µ√µ„ ? £®«±‘⁄ø’Èg£© h[p://www.dgp.toronto.edu/~jmwang/gpdm/2dgpdm.html ? h[p://www.cs.ubc.ca/~duoli/ ? h[ps://www.youtube.com/watch?v=YLSmvEyJo1U ? h[p://grail.cs.washington.edu/projects/styleik/ ?

- 23. GPLVM§Œíàèà•‚•«•Î ? ?Gaussian ?Process ?Dynamic ?Model£®GPDM£© ?: ?GPLVM§Œïrœµ¡–•«©`•ø§ÿ§Œíàèà h[p://www.dgp.toronto.edu/~jmwang/gpdm/ ? ? ?Bayesian ?GPLVM ?: ?GPLVM§Œ•Ÿ•§•∫∞Ê ? ?°˙ ?•—•È•·©`•ø©`§Œ∑÷≤º°¢•«©`•ø§Œ”Ëúy∑÷≤º§¨ ÷§À»Î§Î h[p://inverseprobability.com/vargplvm/ ?

- 24. GPLVM§Œíàèà•‚•«•Î ? ?Scaled ?Gaussian ?Process ?Latent ?Variable ?Model ?£®SGPLVM£© ?: ? ? ? ? ?’˝“éªØ§Ú§€§…§≥§∑§øGPLVM ? ? ? ?h[p://www.cvlibs.net/publica3ons/Geiger2007.pdf ? ? ?Balanced ?GPDM ?£®BGPDM£© : «±‘⁄ø’Èg§«§Ë§Íª¨§È§´§À•’•£•√•∆•£•Û•∞§π§ÎGPDM ±»ð^’쌃 ?: ? ? Comparing ?GPLVM ?Approaches ?for ?Dimensionality ?Reduc3on ?in ?Character ?Anima3on ? ? h[p://www.cs.toronto.edu/~?eet/research/Papers/urtasunCVPR06.pdf ? ? ?Supervised ?GPDM ?£®SGPLVM£© : •È•Ÿ•Î«ÈàÛ§‚¿˚”√§∑§øGPLVM£®Jiang, ?X ?et ?al., ?2012£© ?

- 25. •–•§•™∑÷“∞§«§Œþm?”√ ¬¿˝¿˝ ?Characteriza3on ?of ?transcrip3onal ?networks ?in ?blood ?stem ?and ?progenitor ?cells ?using ?high-?©\ throughput ?single-?©\cell ?gene ?expression ?analysis, ?Nature ?Cell ?Biology, ?2013 ?A ?novel ?approach ?for ?resolving ?di?erences ?in ?single-?©\cell ?gene ?expression ?pa[erns ?from ?zygote ?to ? blastocyst, ?Bioinforma2cs, ?2012 ºö∞˚§Œ∑÷ªØ§œ8ºö∞˚∆⁄§´§È º§Þ§Î§»§§§¶’h§¨§¢§Î ? £®Johnson ?and ?McConnell, ?2004£© ? ? single-?©\cell ?qPCR§«þzŪ◊”∞k¨F§Ú”ãúy§∑§ø§»§≥§Ì°¢ ? ∆’Õ®§ŒPCA§«§œ8ºö∞˚∆⁄§«•«©`•ø§¨∑÷§´§Ï§ §´§√§ø ? ? °˙ ?supervised§ GPLVM§«•«©`•ø§Ú∑÷§±§Î§≥§»§À≥…π¶ ? ? ? ? ? ?£®•È•Ÿ•Î§Ú”Χ®§ø§È°¢•È•Ÿ•Î§¥§»§À∑÷§´§Ï§Î§Œ§œµ±§ø§Í«∞§«§œ°≠?£© GPLVM§Ú—™“∫ºö∞˚•«©`•ø ? £®single-?©\cell ?qPCR£©§Àþm”√

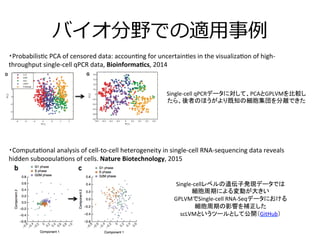

- 26. •–•§•™∑÷“∞§«§Œþm?”√ ¬¿˝¿˝ ?Computa3onal ?analysis ?of ?cell-?©\to-?©\cell ?heterogeneity ?in ?single-?©\cell ?RNA-?©\sequencing ?data ?reveals ? hidden ?subpopula3ons ?of ?cells, ?Nature ?Biotechnology, ?2015 ?Probabilis3c ?PCA ?of ?censored ?data: ?accoun3ng ?for ?uncertain3es ?in ?the ?visualiza3on ?of ?high-?©\ throughput ?single-?©\cell ?qPCR ?data, ?Bioinforma2cs, ?2014 Single-?©\cell•Ï•Ÿ•Î§ŒþzŪ◊”∞k¨F•«©`•ø§«§œ ? ºö∞˚÷Ð∆⁄§À§Ë§Îâ‰Ñ”§¨¥Û§≠§§ ? GPLVM§«Single-?©\cell ?RNA-?©\Seq•«©`•ø§À§™§±§Î ? ºö∞˚÷Ð∆⁄§Œ”∞Ìë§Ú—a’˝§∑§ø ? scLVM§»§§§¶•ƒ©`•Î§»§∑§∆π´È_£®GitHub£© Single-?©\cell ?qPCR•«©`•ø§Àåù§∑§∆°¢PCA§»GPLVM§Ú±»ð^§∑ §ø§È°¢··’þ§Œ§€§¶§¨§Ë§Íº»÷™§Œºö∞˚ºØႧÚ∑÷Îx§«§≠§ø

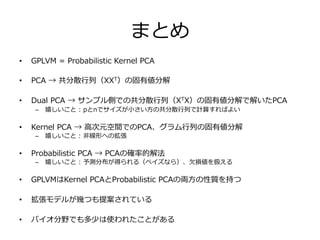

- 27. §Þ§»§· ?? GPLVM ?= ?Probabilistic ?Kernel ?PCA ?? PCA ?°˙ ?π≤∑÷…¢?––––¡–¡–£®XXT£©§ŒπÔ–Çé∑÷Ω‚ ?? Dual ?PCA ?°˙ ?•µ•Û•◊•ÎÇ»§«§Œπ≤∑÷…¢?––––¡–¡–£®XTX£©§ŒπÔ–Çé∑÷Ω‚§«Ω‚§§§øPCA ®C? Ê“§∑§§§≥§» ?: ?p§»n§«•µ•§•∫§¨?–°§µ§§?∑Ω§Œπ≤∑÷…¢?––––¡–¡–§«”ãÀ„§π§Ï§–§Ë§§ ?? Kernel ?PCA ?°˙ ??∏þ¥Œ‘™ø’Èg§«§ŒPCA°¢•∞•È•ý?––––¡–¡–§ŒπÔ–Çé∑÷Ω‚ ®C? Ê“§∑§§§≥§» ?: ??∑«æÄ–Œ§ÿ§Œíàèà ?? Probabilistic ?PCA ?°˙ ?PCA§Œ¥_¬ ¬ ¬ µƒΩ‚∑® ®C? Ê“§∑§§§≥§» ?: ?”Ëúy∑÷≤º§¨µ√§È§Ï§Î£®•Ÿ•§•∫§ §È£©°¢?«∑ìpÇé§ÚíQ§®§Î ?? GPLVM§œKernel ?PCA§»Probabilistic ?PCA§ŒÅI?∑Ω§Œ–‘Ÿ|§Ú≥÷§ƒ ?? íàèà•‚•«•Î§¨é◊§ƒ§‚÷∞∏§µ§Ï§∆§§§Î ?? •–•§•™∑÷“∞§«§‚∂ý…Ÿ§œ π§Ô§Ï§ø§≥§»§¨§¢§Î

![?◊‘?º∫ΩBΩÈ

?¬∂¬∂∆È∫Γ„£®§ƒ§Ê§∂§≠ ?§≥§¶§≠£©

?¿Ì¿ÌªØ—ß—–æøÀ˘ ?«ÈàÛª˘±P•ª•Û•ø©`

? ? ? ? ?•–•§•™•§•Û•’•©•Þ•∆•£•Ø•π—–æøÈ_∞k•Ê•À•√•»

? ? ?£®RIKEN ?ACCC ?BiT£©

? ? ? ? ?ÃÿÑe—–æøÜT

?Single-©\??cell ?RNA-©\??Seq§Œ•«©`•øΩ‚Œˆ°¢Ω‚Œˆ? ÷∑®?•Ω•’•»•¶•ß•¢

È_∞k§Ú§‰§√§∆§§§Þ§π

?þBΩjœ»

-©\?? ?@antiplastics

-©\?? ?koki.tsuyuzaki ?[at] ?gmail.com](https://image.slidesharecdn.com/pcagplvm-151113084515-lva1-app6892/85/PCA-GPLVM-2-320.jpg)