20180118 一般化线形モテ?ル(驳濒尘)

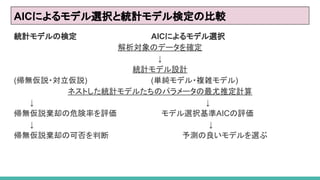

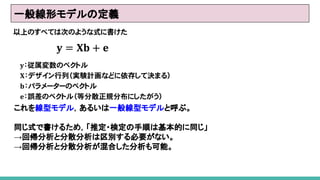

- 2. 1. 一般线形モデル 2. 一般化线形モデルの概観 3. 一般化线形モデルの定義 4. GLMのモデル選択 5. 尤度比検定 6. RのGLMライブラリ

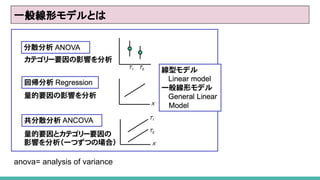

- 3. 一般线形モデルとは anova= analysis of variance

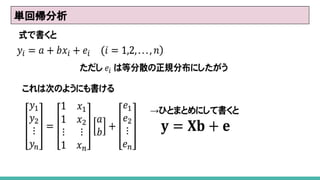

- 4. 単回帰分析

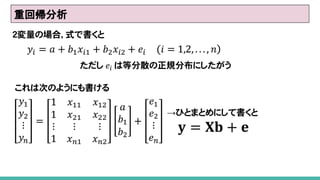

- 5. 重回帰分析

- 6. 一元配置分散分析

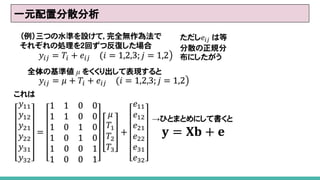

- 8. 1. 一般线形モデル 2. 一般化线形モデルの概観 3. 一般化线形モデルの定義 4. GLMのモデル選択 5. 尤度比検定 6. RのGLMライブラリ

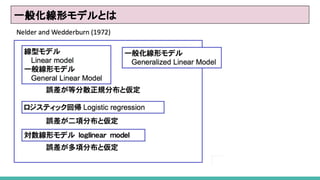

- 9. 一般化线形モデルとは

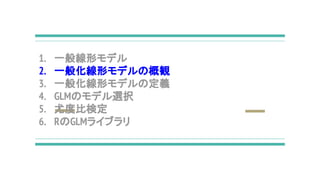

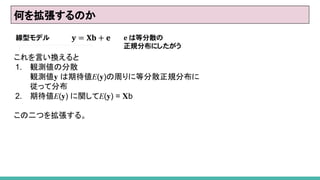

- 10. 何を拡張するのか これを言い換えると 1. 観測値の分散 観測値 は期待値 ( )の周りに等分散正規分布に 従って分布 2. 期待値 ( ) に関して ( ) = b この二つを拡張する。

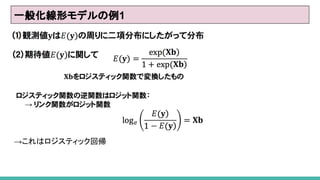

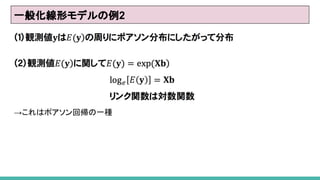

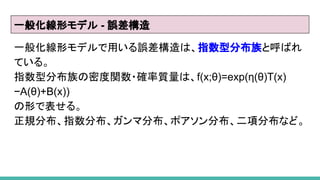

- 11. 何を拡張するのか 拡張ポイント1:観測値の分散 正規分布の必要はなく、指数分布族に従えば良い。 (ポアソン分布,二項分布,ガンマ分布など) 拡張ポイント2:線形でなく、線形を関数で処理する 期待値 ( ) に関して ( ) = ( b) ( )は指数関数やロジスティック関数などの「単調関数」 ( )の逆関数をリンク関数と呼ぶ。 これを と記すと [E(y)] = b 期待値 ( ) をリンク関数で変換したものが線形関数。

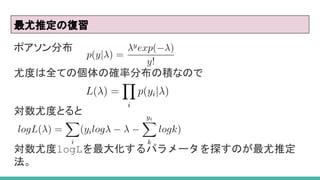

- 14. 尤度の最大値を見つける方法 一方、正規分布以外の誤差の場合はそう簡単には求まらない。 1. 試行錯誤法(ニュートン?ラフソン法,スコア法など) 2. 対数尤度が最大となるパラメーターを探す。 3. 対数尤度をパラメーターで微分してゼロとなるパラメー ターを探す。

- 15. 1. 一般线形モデル 2. 一般化线形モデルの概観 3. 一般化线形モデルの定義 4. GLMのモデル選択 5. 尤度比検定 6. RのGLMライブラリ

- 16. 一般化线形モデル(GLM)の3要素 一般化线形モデル(GLM)は、 ?誤差構造(error structure) ?線形予測子(linear predictor) ?リンク関数(link function) の 3 つの要素によって構成されている。

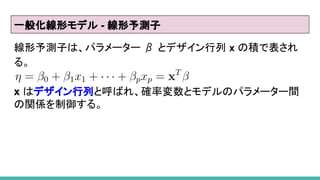

- 19. 一般化线形モデル - 線形予測子 線形予測子は、パラメーター β とデザイン行列 x の積で表され る。 x はデザイン行列と呼ばれ、確率変数とモデルのパラメーター間 の関係を制御する。

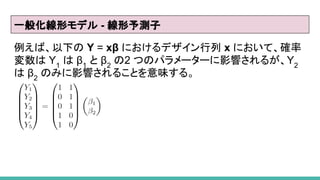

- 20. 一般化线形モデル - 線形予測子 例えば、以下の Y = xβ におけるデザイン行列 x において、確率 変数は Y1 は β1 と β2 の2 つのパラメーターに影響されるが、Y2 は β2 のみに影響されることを意味する。

- 21. 一般化线形モデル - 線形予測子 デザイン行列は 0 または 1 のように因子で構成されることも、1.2 や 2.3 などのようにパラメーターの加重として構成されることもで きる。 -> デザイン行列を因子とするか、加重とするかは解析するデータ の特徴に合わせて決める必要がある。 同じデータに対して、どんな結果を期待したいかによってもデザイ ン行列の作り方が異なってくる。 -> どんな結果を期待しているのかを予め決定した上で実験を行う べき。

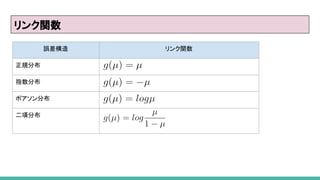

- 22. リンク関数 従属変数が正規分布に従わないとき、E[Y] = Xβ の式でモデル化 すると、正確さが失われる。 -> そこで、従属変数をある関数 G で変換してから、モデル化する ことで、モデルの正確さが向上する。 G(E[Y]) = Xβ 関数 G はリンク関数と呼ばれている。 一般に、誤差構造が決まれば、リンク関数も自動的に決まること が多い。

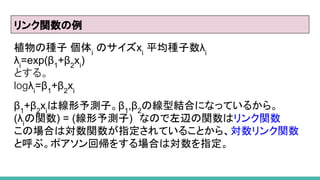

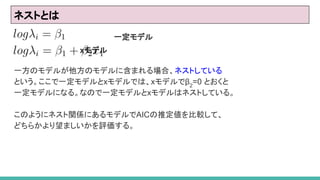

- 24. リンク関数の例 植物の種子 個体i のサイズxi 平均種子数λi λi =exp(β1 +β2 xi ) とする。 logλi =β1 +β2 xi β1 +β2 xi は線形予測子。β1 ,β2 の線型結合になっているから。 (λi の関数) = (線形予測子) なので左辺の関数はリンク関数 この場合は対数関数が指定されていることから、対数リンク関数 と呼ぶ。ポアソン回帰をする場合は対数を指定。

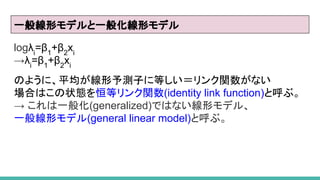

- 25. 一般线形モデルと一般化线形モデル logλi =β1 +β2 xi →λi =β1 +β2 xi のように、平均が線形予測子に等しい=リンク関数がない 場合はこの状態を恒等リンク関数(identity link function)と呼ぶ。 → これは一般化(generalized)ではない線形モデル、 一般线形モデル(general linear model)と呼ぶ。

- 26. 1. 一般线形モデル 2. 一般化线形モデルの概観 3. 一般化线形モデルの定義 4. GLMのモデル選択 5. 尤度比検定 6. RのGLMライブラリ

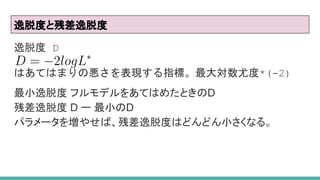

- 28. 逸脱度と残差逸脱度 逸脱度 D はあてはまりの悪さを表現する指標。最大対数尤度*(-2) 最小逸脱度 フルモデルをあてはめたときのD 残差逸脱度 D ー 最小のD パラメータを増やせば、残差逸脱度はどんどん小さくなる。

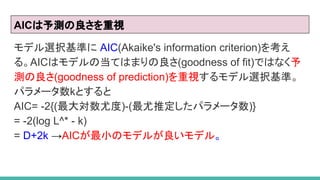

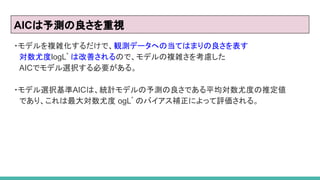

- 29. AICは予測の良さを重視 モデル選択基準に AIC(Akaike's information criterion)を考え る。AICはモデルの当てはまりの良さ(goodness of fit)ではなく予 測の良さ(goodness of prediction)を重視するモデル選択基準。 パラメータ数kとすると AIC= -2{(最大対数尤度)-(最尤推定したパラメータ数)} = -2(log L^* - k) = D+2k →AICが最小のモデルが良いモデル。

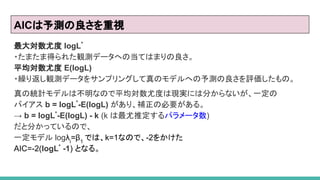

- 30. AICは予測の良さを重視 最大対数尤度 logL* ?たまたま得られた観測データへの当てはまりの良さ。 平均対数尤度 E(logL) ?繰り返し観測データをサンプリングして真のモデルへの予測の良さを評価したもの。 真の統計モデルは不明なので平均対数尤度は現実には分からないが、一定の バイアス b = logL* -E(logL) があり、補正の必要がある。 → b = logL* -E(logL) - k (k は最尤推定するパラメータ数) だと分かっているので、 一定モデル logλi =β1 では、k=1なので、-2をかけた AIC=-2(logL* -1) となる。

- 32. 1. 一般线形モデル 2. 一般化线形モデルの概観 3. 一般化线形モデルの定義 4. GLMのモデル選択 5. 尤度比検定 6. RのGLMライブラリ

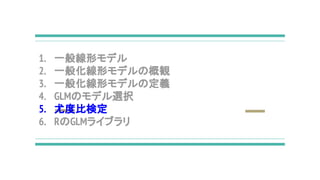

- 33. AICによるモデル選択と統計モデル検定の比較 統計モデルの検定 AICによるモデル選択 解析対象のデータを確定 ↓ 統計モデル設計 (帰無仮説?対立仮説) (単純モデル?複雑モデル) ネストした統計モデルたちのパラメータの最尤推定計算 ↓ ↓ 帰無仮説棄却の危険率を評価 モデル選択基準AICの評価 ↓ ↓ 帰無仮説棄却の可否を判断 予測の良いモデルを選ぶ

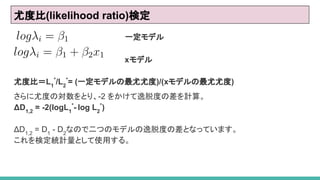

- 35. 尤度比(likelihood ratio)検定 一定モデル xモデル 尤度比=L1 * /L2 * = (一定モデルの最尤尤度)/(xモデルの最尤尤度) さらに尤度の対数をとり、-2 をかけて逸脱度の差を計算。 ΔD1,2 = -2(logL1 * - log L2 * ) ΔD1,2 = D1 - D2 なので二つのモデルの逸脱度の差となっています。 これを検定統計量として使用する。

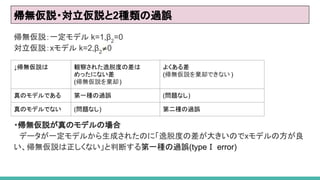

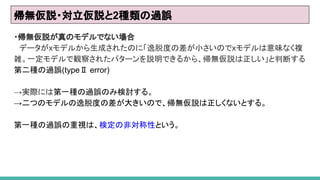

- 36. 帰無仮説?対立仮説と2種類の過誤 帰無仮説:一定モデル k=1,β2 =0 対立仮説:xモデル k=2,β2 ≠0 ?帰無仮説が真のモデルの場合 データが一定モデルから生成されたのに「逸脱度の差が大きいのでxモデルの方が良 い、帰無仮説は正しくない」と判断する第一種の過誤(typeⅠ error) ↓帰無仮説は 観察された逸脱度の差は めったにない差 (帰無仮説を棄却) よくある差 (帰無仮説を棄却できない ) 真のモデルである 第一種の過誤 (問題なし) 真のモデルでない (問題なし) 第二種の過誤

- 38. 1. 一般线形モデル 2. 一般化线形モデルの概観 3. 一般化线形モデルの定義 4. GLMのモデル選択 5. 尤度比検定 6. RのGLMライブラリ

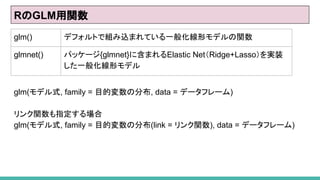

- 39. RのGLM用関数 glm(モデル式, family = 目的変数の分布, data = データフレーム) リンク関数も指定する場合 glm(モデル式, family = 目的変数の分布(link = リンク関数), data = データフレーム) glm() デフォルトで組み込まれている一般化线形モデルの関数 glmnet() パッケージ{glmnet}に含まれるElastic Net(Ridge+Lasso)を実装 した一般化线形モデル

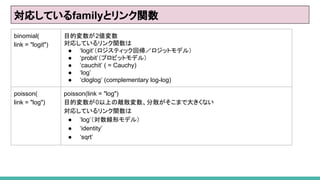

- 40. 対応しているfamilyとリンク関数 binomial( link = "logit") 目的変数が2値変数 対応しているリンク関数は ● ‘logit’(ロジスティック回帰/ロジットモデル) ● ‘probit’(プロビットモデル) ● ‘cauchit’ ( = Cauchy) ● ‘log’ ● ‘cloglog’ (complementary log-log) poisson( link = "log") poisson(link = "log") 目的変数が0以上の離散変数、分散がそこまで大きくない 対応しているリンク関数は ● ‘log’(対数線形モデル) ● ‘identity’ ● ‘sqrt’

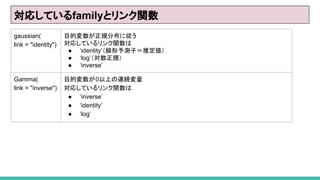

- 41. 対応しているfamilyとリンク関数 gaussian( link = "identity") 目的変数が正規分布に従う 対応しているリンク関数は ● ‘identity’(線形予測子=推定値) ● ‘log’(対数正規) ● ‘inverse’ Gamma( link = "inverse") 目的変数が0以上の連続変量 対応しているリンク関数は ● ‘inverse’ ● ‘identity’ ● ‘log’

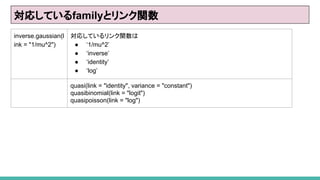

- 42. 対応しているfamilyとリンク関数 inverse.gaussian(l ink = "1/mu^2") 対応しているリンク関数は ● ‘1/mu^2’ ● ‘inverse’ ● ‘identity’ ● ‘log’ quasi(link = "identity", variance = "constant") quasibinomial(link = "logit") quasipoisson(link = "log")

![何を拡張するのか

拡張ポイント1:観測値の分散

正規分布の必要はなく、指数分布族に従えば良い。

(ポアソン分布,二項分布,ガンマ分布など)

拡張ポイント2:線形でなく、線形を関数で処理する

期待値 ( ) に関して ( ) = ( b)

( )は指数関数やロジスティック関数などの「単調関数」

( )の逆関数をリンク関数と呼ぶ。

これを と記すと [E(y)] = b

期待値 ( ) をリンク関数で変換したものが線形関数。](https://image.slidesharecdn.com/20180118glm-180115101834/85/20180118-glm-11-320.jpg)

![リンク関数

従属変数が正規分布に従わないとき、E[Y] = Xβ の式でモデル化

すると、正確さが失われる。

-> そこで、従属変数をある関数 G で変換してから、モデル化する

ことで、モデルの正確さが向上する。

G(E[Y]) = Xβ

関数 G はリンク関数と呼ばれている。

一般に、誤差構造が決まれば、リンク関数も自動的に決まること

が多い。](https://image.slidesharecdn.com/20180118glm-180115101834/85/20180118-glm-22-320.jpg)