ÕÎÄŌŠžsĢšAUGMIX: A SIMPLE DATA PROCESSING METHOD TO IMPROVE ROBUSTNESS AND UNCERTAINTY

- 1. AUGMIX: A SIMPLE DATA PROCESSING METHOD TO IMPROVE ROBUSTNESS AND UNCERTAINTY Dan Hendrycks et al. AUGMIXĢšÔĀÎÐÔĪČēŧī_gÐÔĪōļÄÉÆĪđĪë Ĩ·ĨóĨŨĨëĪĘĨĮĐ`ĨŋIĀíĘÖ·Ļ

- 2. ABSTRACT 2 ? ghūģĪĮĪÏÓūĨĮĐ`ĨŋĪČĨÆĨđĨČĨĮĐ`ĨŋĪË ß`ĪĪĪŽĪĒĪëĪģĪČĪŽķāĪĪĢĻdata shiftĢĐ ĄúĨŊĨéĨđ·ÖîĪÎÕýī_ÐÔĪŽĩÍÏ ? ŧÏņ·ÖîĪËĪŠĪĪĪÆÔĀÎÐÔĪČēŧī_gÐÔÔuýĪōļÄÉÆĪđĪë ÐÂĪŋĪĘËŪĪ·ĘÖ·ĻĢšAUGMIXĪÎĖá°ļ Ąųaugmentation Ąú ĨĮĐ`ĨŋĪÎËŪĪ· ?Ĩ·ĨóĨŨĨëĪĘgŨ° ?ÓËãĪâÝXĪĪ ?ÎīÖŠĪÎ data corruptionĢĻĨĮĐ`ĨŋąĀĪėĢĐĪËĪŊĪĘĪë

- 3. 1 INTRODUCTION 3 ? ÓūĨĮĐ`ĨŋĪËžÓđĪĪōČëĪėĪÆĪâ Ī―ĪÎĖØķĻĪΞÓđĪĪËĪŊĪĘĪëĪĀĪą ĄúÎīÖŠĪΞÓđĪĪËęĪĮĪĪĘĪĪ ? ÔĀÎÐÔĪČÓËãÁŋĪÏĨČĨėĐ`ĨÉĨŠĨÕ ? data shift ĪŽĪĒĪëĪČ ß^ĪËÐÅîmÐÔĪÎļßĪĪÓčyĪōĪ·ĪÆĪ·ĪÞĪĶ Ąúēŧī_gÐÔĪÎÔuýĪËî}ĪĒĪę ? ĪïĪšĪŦĪĘ corruption ĢĻžÓđĪ?ÂŌĪėĢĐĪĮĪâÕý―âÂĘĪŽÂäĪÁĪë ÍĻģĢĪÎ ImageNet error 22% data corruptionĪōžÓĪĻĪŋ ImageNet-C error 64%

- 4. 1 INTRODUCTION 4 AUGMIXĪČĪÏĢŋ ? Data shift ĪËĪđĪëÔĀÎÐÔĪČēŧī_gÐÔĪō ÍŽrĪËļÄÉÆĪđĪëĘÖ·Ļ ? ĨéĨóĨĀĨāÐÔĪČĄĐĪĘËŪĪ··―·ĻĪōĘđĪĪ Ņ}ĘýĪÎËŪĪ·ŧÏņĪōšÏģÉĪđĪë ? CIFAR, ImageNet ĪÎI·―ĪĮĪĪĪĪ―YđûĪŽĩÃĪéĪėĪŋ

- 5. 2 RELATED WORK 5 ? data shift ÏÂĪÎÔĀÎÐÔ ÓūrĪÎĖØķĻĪΞÓđĪĪōŅ§ÁĪ·ĪÆĪ·ĪÞĪĶ ĀýĢšĪĒĪëĨÖĨéĐ`ĪōŌĪĻĪÆĪâÎīÖŠĪÎĨÖĨéĐ`ĪËęēŧŋÉ ? data shift ÏÂĪÎĨĨãĨęĨÖĨėĐ`Ĩ·ĨįĨó calibrated Ąú ·ÖîÆũĪŽßmĮÐĪËÕýī_ÐÔĪōÓčyĪĮĪĪÆĪĪĪë ĀýĢšÐÅîmķČ70%ĪÎŧÏņĪÎĪĶĪÁĄĒ70%ĪŽÕý―â data shift ĪËĪčĪÃĪÆĨĨãĨęĨÖĨėĐ`Ĩ·ĨįĨóĪÏĩÍÏ Ņ}ĘýĪÎĨŊĨéĨđ·ÖîÓčÏëĪō gžĪËĨĒĨóĨĩĨóĨÖĨëĪđĪëĪČļÄÉÆ

- 6. 2 RELATED WORK 6 ?ËŪĪ·(augmentation) ËŪĪ·ĪÏīóĪĪĪËøŧŊĪËŋđûĪŽĪĒĪë ĮÐĪęČĄĪę?Æ―ÐÐŌÆÓĪŽĪčĪŊĘđĪïĪėĪë manifold intrusion Ąú ĨßĨÃĨŊĨđĪ·ĪŋŧÏņĪČÔŠŧÏņĪÎĖØÕĪŽÃŽķÜĪ· Ņ§ÁēŧŨãĪËęĪëĪģĪČ

- 7. C AUGMENTATION OPERATIONS 7 ? ĪâĪÏĪäeĪÎøBĪÎŧÏņĪČĪĘĪÃĪÆĪĪĪë ĄúÔŠŧÏņĪÎĖØÕĪōʧĪïĪĘĪĪËŪĪ·ĘÖ·ĻĪōßxĪÖĪŲĪ

- 8. 2 RELATED WORK 8 ? adversarial machine learning ČËégĪÎÄŋĪËĪÏÍŽĪļĪčĪĶĪËŌĪĻĪëĪčĪĶĪĘ ĪïĪšĪŦĪĘäŧŊĪĮégß`ĪÃĪŋÓčyĪōĪ·ĪÆĪ·ĪÞĪĶŽFÏóĪŽĪĒĪë https://openai.com/blog/adversarial-example-research/ ĪģĪėĪéĪâŋž]Ī·ĪŋŅ§ÁĪōÐÐĪĶĪČ ? Ņ§ÁrégĪÎÖļĘýévĘýĩÄīó ? non-adversary ŧÏņĪÎÕý―âÂĘĩÍÏ gibbon

- 9. 3 AUGMIX 9 ? ËŪĪ·ĘÖ·ĻĪōĨßĨÃĨŊĨđĪđĪëĪČ ÔĀÎ?ĖØķĻĪÎËŪĪ·ĪōŌĪĻĪÆĪ·ĪÞĪĶĪģĪČĪŽĪĘĪĪ ? ËŪĪ·ĘÖ·ĻĪÎ gĪĘĪëĨÁĨ§Đ`ĨóĪĮĪÏ ÔŠĨĮĐ`ĨŋĪŦĪéđÔëxĪ·ĪÆĪ·ĪÞĪĶ

- 10. 3 AUGMIX 10 ? AUGMIXĪĮĪÏŅ}ĘýĪÎĨÁĨ§Đ`ĨóĪōÍđ―YšÏĪđĪëĪģĪČĪĮ ķāÐÔĪōūSģÖĪ·ĪÄĪÄÔŠĨĮĐ`ĨŋĪŦĪéđÔëxĪĩĪŧĪĘĪĪ ĄųÍđ―YšÏ

- 11. 3 AUGMIX 11 ? mix ąČĪÎÖØĪß ? ? ĪōÂŌĘýĪĮQĪáĪë ? width ĪÏđĖķĻĪĮ3 https://hotcocoastudy.hatenablog.jp/entry/2019/12/07/143506

- 12. 3 AUGMIX 12 ? ļũĨÁĨ§Đ`ĨóĪĮ operation Īō 3 QĪáĪë ? operation ĪÎĪĶĪÁ 1 ĄŦ 3 ßxĪÖ https://hotcocoastudy.hatenablog.jp/entry/2019/12/07/143506

- 13. 3 AUGMIX 13 ? ļũĨÁĨ§Đ`ĨóĪōÖØĪß ? ? ĪĮšÏģÉĪ·ĪŋŧÏņ ? ??? ĪōĩÃĪë https://hotcocoastudy.hatenablog.jp/entry/2019/12/07/143506

- 14. 3 AUGMIX 14 ? šÏģÉąČ ? ĪĮ ? ???? ĪČ ? ??? ĪōšÏģÉĪ· ? ?????? ĪōĩÃĪë https://hotcocoastudy.hatenablog.jp/entry/2019/12/07/143506

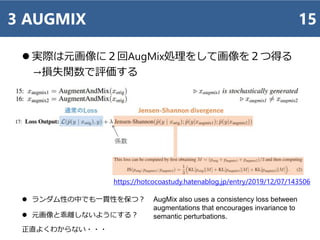

- 15. 3 AUGMIX 15 ? gëHĪÏÔŠŧÏņĪËĢēŧØAugMixIĀíĪōĪ·ĪÆŧÏņĪōĢēĪÄĩÃĪë ĄúpʧévĘýĪĮÔuýĪđĪë AugMix also uses a consistency loss between augmentations that encourages invariance to semantic perturbations. ? ĨéĨóĨĀĨāÐÔĪÎÖÐĪĮĪâŌŧØÐÔĪōąĢĪÄĢŋ ? ÔŠŧÏņĪČđÔëxĪ·ĪĘĪĪĪčĪĶĪËĪđĪëĢŋ ÕýÖąĪčĪŊĪïĪŦĪéĪĘĪĪ??? https://hotcocoastudy.hatenablog.jp/entry/2019/12/07/143506

- 16. C AUGMENTATION OPERATIONS 16 ? ImageNet-CĪËšŽĪÞĪėĪëžÓđĪĪÏAUGMIXĪËšŽĪáĪĘĪĪĪģĪČĪËŨĒŌâ ? ĘđĪÃĪŋĪÎĪÏ equalize, autocontrast, rotate, shear_x, shear_y, translate_x, translate_y, solarize, posterize posterize solarize

- 17. 4 EXPERIMENTS 17 ? CIFAR-10, 100 (10, 100 classes) 32ĄÁ32ĄÁ3 color, 50,000 training, 10,000 testing images ? ImageNet 1,000 classes, 1.2 million large scale color images ? -C dataset 15ĪÎ curruption ĪōžÓĪĻĪŋĪâĪÎĄĒ5ķÎëAĪÎķČ(severity) ĪģĪģĪËšŽĪÞĪėĪëžÓđĪĪÏŅ§ÁĪĮĪÏĘđĪÃĪÆĪÏĪĘĪéĪĘĪĪ data shiftĪØĪÎÔĀÎÐÔĪōŌĪë ? -P dataset Óŧ°æĢĻÉŲĪ·ĪšĪÄÃũĪëĪŊĪĘĪÃĪÆĪĪĪŊĪĘĪÉĢĐ ÓŧÖÐĪĮÓčyĪŽäŧŊĪ·ĪĘĪĪĄú°ēķĻĪ·ĪŋÓčyĪŽĪĮĪĪÆĪĪĪë

- 18. 4 EXPERIMENTS 18 Clean Error : žÓđĪĪĩĪėĪŋĨĮĐ`ĨŋĪĮĪÎĨĻĨéĐ` mCE : žÓđĪĪÎķČĪČļũžÓđĪĪĮÆ―ūųĪōĪČĪÃĪŋĨĻĨéĐ` ĄúŧÏņĪŽžÓđĪĪĩĪėĪÆĪĪĪÆĪâÕý―âĪŽģöĪŧĪëĪŦĢŋ Flip Probability : ÐėĄĐĪËžÓđĪĪĩĪėĪÆĪĪĪŊÓŧĪËĪŠĪĪĪÆ ĪĒĪëĨģĨÞĪČīÎĪÎĨģĨÞĪĮÓčyĪŽäŧŊĪđĪëī_ÂĘ mFP : 10·NĪÎäŧŊĪÎÆ―ūųĪōĪČĪÃĪŋĪâĪÎ ĄúŧÏņĪŽžÓđĪĪĩĪėĪÆĪâŌŧØĪ·ĪŋÓčyĪŽĪĮĪĪëĪŦĢŋ ĨĨãĨęĨÖĨėĐ`Ĩ·ĨįĨóĪĮĪĪÆĪĪĪëĄúÓčyī_ÂĘĪČÕý―âÂĘĪŽŌŧÖÂĪ·ĪÆĪĪĪë ÓčÏëĪ·Īŋī_ÂĘĪČgëHĪÎī_ÂĘĪÎķþ\Õ`ēîĪĮÅÐķÏ Ąúēŧī_gÐÔĪŽÕýĪ·ĪŊÔuýĪĮĪĪÆĪĪĪëĪŦĢŋ

- 19. 4.1 CIFAR-10 AND CIFAR-100 19 ËŪĪ·ĘÖ·ĻĪīĪČĪÎĨĻĨéĐ`ÂĘĪÎąČÝ^ ? ËûĪÎĘÖ·ĻĪËąČĪŲžs°ë·ÖĪÎĨĻĨéĐ` ? žÓđĪĪĘĪ·ĪÎöšÏĪÎĨĻĨéĐ`ÂĘĪË―üĪÅĪĪĪÆĪĪĪë

- 20. 4.1 CIFAR-10 AND CIFAR-100 20 ĨâĨĮĨëĪČCIFAR10/100ĪīĪČĪÎĨĻĨéĐ`ąČÝ^ ? ĨâĨĮĨëĪäCIFAR10/100ĪËévĪïĪéĪšĨĻĨéĐ`ÂĘĪŽĩÍĪĪ

- 21. 4.1 CIFAR-10 AND CIFAR-100 21 žÓđĪĪđĪëĪČÓčyĪŽäŧŊĪđĪëĪŦ ?ŌŧØĪ·ĪŋÓčyĪŽĪĮĪĪÆĪĪĪë ĨĨãĨęĨÖĨėĐ`Ĩ·ĨįĨóąČÝ^ ?ēŧī_gÐÔĪŽŌ·eĪėĪÆĪĪĪë

- 25. 4.3 ABLATIONS 25 AUGMIXĪÎ3ŌŠËØĢšĨéĨóĨĀĨāÐÔĄĒJSDĄĒMix ĪÎĮÐĪę·ÖĪą ? ĪģĪėŌÔÉÏĨßĨÃĨŊĨđĪ·ĪÆĪâĪĪĪĪ―YđûĪËĪĘĪéĪĘĪŦĪÃĪŋ ? MixupĪÎĮ°ĪËAUGMIXĪđĪëĪČĨĻĨéĐ`ÂĘĪŽĪ·ĪŋĄúmanifold intrution ? ËŪĪ·ĘÖ·ĻĪηNîĄĒpʧévĘýĄĒmix ĪÎ―MšÏĪŧĪÏÉũÖØĪË

- 26. 5 CONCLUSION 26 ? AUGMIX : ĨéĨóĨĀĨāĪËßxĪÐĪėĪŋĮ°IĀíĪōĨßĨÃĨŊĨđĪđĪëĘÖ·Ļ ? š gĪËgŨ°ĪĮĪĄĒÓËãÁŋĪâÉŲĪĘĪĪ ? ÔĀÎÐÔĪČēŧī_gÐÔÔuýĪōļÄÉÆĪđĪë ? CIFAR-10/100-C/P, ImageNet-C/P ĪĮÁžĪĪ―Yđû ? °ēČŦÐÔĪŽąØŌŠĪĘÐÅîmĪĮĪĪëĨâĨĮĨëĪÎĖáđĐĪËĪÄĪĘĪŽĪë

![2 RELATED WORK 8

? adversarial machine learning

ČËégĪÎÄŋĪËĪÏÍŽĪļĪčĪĶĪËŌĪĻĪëĪčĪĶĪĘ

ĪïĪšĪŦĪĘäŧŊĪĮégß`ĪÃĪŋÓčyĪōĪ·ĪÆĪ·ĪÞĪĶŽFÏóĪŽĪĒĪë

https://openai.com/blog/adversarial-example-research/

ĪģĪėĪéĪâŋž]Ī·ĪŋŅ§ÁĪōÐÐĪĶĪČ

? Ņ§ÁrégĪÎÖļĘýévĘýĩÄīó

? non-adversary ŧÏņĪÎÕý―âÂĘĩÍÏÂ

gibbon](https://image.slidesharecdn.com/augmix-191217232142/85/AUGMIX-A-SIMPLE-DATA-PROCESSING-METHOD-TO-IMPROVE-ROBUSTNESS-AND-UNCERTAINTY-8-320.jpg)

![[DLÝÕiŧá]Progressive Growing of GANs for Improved Quality, Stability, and Varia...](https://cdn.slidesharecdn.com/ss_thumbnails/kuboshizuma20180316-180525003941-thumbnail.jpg?width=560&fit=bounds)

![[DLÝÕiŧá]EfficientNet: Rethinking Model Scaling for Convolutional Neural Networks](https://cdn.slidesharecdn.com/ss_thumbnails/yokota20190621dlhack-190621022108-thumbnail.jpg?width=560&fit=bounds)

![SSII2021 [TS3] CÐĩŅ§ÁĪÎĨĒĨÎĨÆĐ`Ĩ·ĨįĨóĪËĪŠĪąĪë ĨĮĐ`Ĩŋ

§žŊ? ? ūŦķČÏōÉÏĪÎĪŋĪáĪÎĘË―MĪß?ĀíĪäÉįŧáÐÔĨÐĨĪĨĒĨđ ?](https://cdn.slidesharecdn.com/ss_thumbnails/ts3-01-210607043121-thumbnail.jpg?width=560&fit=bounds)

![[DLÝÕiŧá]Understanding Black-box Predictions via Influence Functions](https://cdn.slidesharecdn.com/ss_thumbnails/dlhacksinffunc-170822055634-thumbnail.jpg?width=560&fit=bounds)

![[DLÝÕiŧá]Model soups: averaging weights of multiple fine-tuned models improves ...](https://cdn.slidesharecdn.com/ss_thumbnails/dl0401-220405031053-thumbnail.jpg?width=560&fit=bounds)

![[DLÝÕiŧá]Wasserstein GAN/Towards Principled Methods for Training Generative Adv...](https://cdn.slidesharecdn.com/ss_thumbnails/wgan-1-170224021826-thumbnail.jpg?width=560&fit=bounds)