Chapter 01 #ml-professional

- 3. ? 1.1 研究の歴史 ? 1.1.1 多層ニューラルネットへの期待と失望 ? 1.1.2 多層ネットワークの事前学習 ? 1.1.3 特徴量の学習 ? 1.1.4 深層学習の隆盛 ? 1.2 本書の構成 (※話しません)

- 4. ? 1.1 研究の歴史 ? 1.1.1 多層ニューラルネットへの期待と失望 ? 1.1.2 多層ネットワークの事前学習 ? 1.1.3 特徴量の学習 ? 1.1.4 深層学習の隆盛 ? 1.2 本書の構成 (※話しません)

- 5. 多層ニューラルネットワークの歴史 ? 人工ニューラルネットワーク(以下ニューラルネット) の研究の歴史は山あり谷あり ? 1940年代:? ?研究開始 ? 1980 - 1990年代:? ?誤差逆伝播法 (back propagation) (4章)の発明によ? ?る2度目のブーム ? 1990年代後半 - 2000年代前半:? ?再び下火に この間 盛り上がったり下がったり あったらしい

- 6. なぜ流行らなかったのか? ? 誤差逆伝播法によるニューラルネットの学習は多 層になるとうまくいかない (図1.1) ? 勾配消失問題にもとづく過学習が問題に ? 畳み込みニューラルネット (CNN) (6章) はこの限りでは ない ? 学習パラメータ (層数 / ユニット数 等) の性能へ の寄与がよく分からない

- 7. ? 1.1 研究の歴史 ? 1.1.1 多層ニューラルネットへの期待と失望 ? 1.1.2 多層ネットワークの事前学習 ? 1.1.3 特徴量の学習 ? 1.1.4 深層学習の隆盛 ? 1.2 本書の構成 (※話しません)

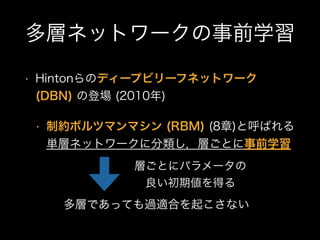

- 8. 多層ネットワークの事前学習 ? Hintonらのディープビリーフネットワーク (DBN) の登場 (2010年) ? 一般的なニューラルネットとは原理が異なるが、 どちらにしろ多層になると学習は困難

- 9. 多層ネットワークの事前学習 ? Hintonらのディープビリーフネットワーク (DBN) の登場 (2010年) ? 制約ボルツマンマシン (RBM) (8章)と呼ばれる 単層ネットワークに分類し,層ごとに事前学習 ???多層であっても過適合を起こさない 層ごとにパラメータの 良い初期値を得る

- 10. 多層ネットワークの事前学習 ? DBNやRBMより単純な自己符号化器 (auto- encoder) (5章)を使っても事前学习が可能

- 11. ? 1.1 研究の歴史 ? 1.1.1 多層ニューラルネットへの期待と失望 ? 1.1.2 多層ネットワークの事前学習 ? 1.1.3 特徴量の学習 ? 1.1.4 深層学習の隆盛 ? 1.2 本書の構成 (※話しません)

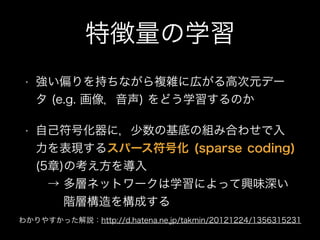

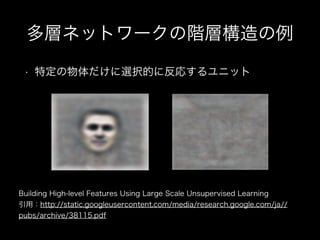

- 12. 特徴量の学習 ? 強い偏りを持ちながら複雑に広がる高次元デー タ (e.g. 画像,音声) をどう学習するのか ? 自己符号化器に,少数の基底の組み合わせで入 力を表現するスパース符号化 (sparse coding) (5章)の考え方を導入? ?→ 多層ネットワークは学習によって興味深い? ?? 階層構造を構成する わかりやすかった解説:http://d.hatena.ne.jp/takmin/20121224/1356315231

- 13. 多層ネットワークの階層構造の例 ? 特定の物体だけに選択的に反応するユニット Building High-level Features Using Large Scale Unsupervised Learning 引用:http://static.googleusercontent.com/media/research.google.com/ja// pubs/archive/38115.pdf 100,000 et, only d the lo- ned the uracy of ith pre- contrast for face be seen, n learns tractors. age, the reshold, an input than 0. s (blue). between on tech- approach can be susceptible to local minima. Results, shown in Figure 13, con?rm that the tested neuron indeed learns the concept of faces. Figure 3. Top: Top 48 stimuli of the best neuron from the test set. Bottom: The optimal stimulus according to nu- merical constraint optimization. 4.5. Invariance properties We would like to assess the robustness of the face de- tector against common object transformations, e.g., translation, scaling and out-of-plane rotation. First, Building high-level features using large-scale unsupervised learning e (left) and out-of-plane (3D) rotation (right) perties of the best feature. Figure 6. Visualization of the cat face neu human body neuron (right). For the ease of interpretation, these da positive-to-negative ratio identical to the

- 14. ? 1.1 研究の歴史 ? 1.1.1 多層ニューラルネットへの期待と失望 ? 1.1.2 多層ネットワークの事前学習 ? 1.1.3 特徴量の学習 ? 1.1.4 深層学習の隆盛 ? 1.2 本書の構成 (※話しません)

- 15. 深層学習の隆盛 ? 深層学習 (deep learning)の有効性が広く認知される ? 深層学習の様々な方法論 ? 音声認識 ? 層間ユニットが全結合したネットワークがよく利用される (事前学習がよく用いられる) ? 画像認識 ? 畳込みニューラルネットが主流.事前学習はあまり利用さ れない ? 自然言語処理 / 音声認識 ? 再帰型ニューラルネット (RNN)が使われている

- 16. なぜ多層ニューラルネットは有用か ? 現実の問題は複雑なので,それに見合う規模の ニューラルネットが必要? → 学習できるだけのデータがある ? 計算機の計算能力が飛躍的に向上 現実世界の大規模な問題に対し 多層ニューラルネットを試してみたところ 思わぬ性能を発揮した…が実際のところ?