Generative Deep Learning #01

- 2. about Ī░Generative Deep LearningĪ▒ - 2019/06 │÷░µ - ūŅĮ³ż╬╔·│╔źŌźŪźļż╬źŲź»ź╦ź├ź»ż╦ż─żżżŲ - DeepLearning ż╬żóżļ│╠Č╚ż╬╩┬Ū░ų¬ūRż“Ū░╠ß - Part 1 ╗∙▒Šż╚ż╩żļ└Ēšō - DeepLearning - VAE - GAN - Part 2 ÅĻė├ż╚źŲź»ź╦ź├ź» - CycleGAN - Encoder - Decoder Model - MuseGAN - BigGAN - BERT - etc

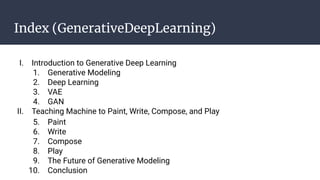

- 4. Index (GenerativeDeepLearning) I. Introduction to Generative Deep Learning 1. Generative Modeling 2. Deep Learning 3. VAE 4. GAN II. Teaching Machine to Paint, Write, Compose, and Play 5. Paint 6. Write 7. Compose 8. Play 9. The Future of Generative Modeling 10. Conclusion

- 5. Index (GenerativeDeepLearning) I. Introduction to Generative Deep Learning 1. Generative Modeling 2. Deep Learning 3. VAE 4. GAN II. Teaching Machine to Paint, Write, Compose, and Play 5. Paint 6. Write 7. Compose 8. Play 9. The Future of Generative Modeling 10. Conclusion

- 6. Index - Chapter 1 Generative Modeling - What Is Generative Modeling - Probabilistic Generative Models - The Challenges of Generative Modeling - Setting Up Your Environment - Summary

- 7. Index - Chapter 1 Generative Modeling - What Is Generative Modeling - Probabilistic Generative Models - The Challenges of Generative Modeling - Setting Up Your Environment - Summary

- 8. What Is Generative Modeling - ╔·│╔źŌźŪźļż╚żŽ - ┤_┬╩źŌźŪźļż“╩╣ė├żĘżŲĪóźŪ®`ź┐ż“╔·│╔ż╣żļ - źŪ®`ź┐ź╗ź├ź╚ż╦║¼ż▐żņżŲżżżĮż”ż╩źŪ®`ź┐ż“╔·│╔ż╣żļ

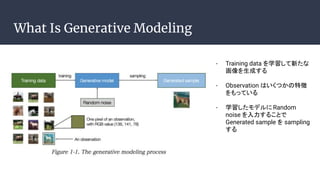

- 9. What Is Generative Modeling - Training data ż“č¦┴ĢżĘżŲą┬ż┐ż╩ ╗ŁŽ±ż“╔·│╔ż╣żļ - Observation żŽżżż»ż─ż½ż╬╠žÅš ż“żŌż├żŲżżżļ - č¦┴ĢżĘż┐źŌźŪźļż╦Random noise ż“╚ļ┴”ż╣żļż│ż╚żŪ Generated sample ż“ sampling ż╣żļ

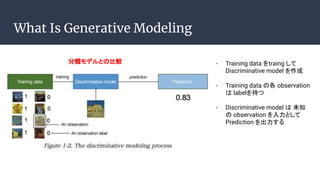

- 10. What Is Generative Modeling - Training data ż“traing żĘżŲ Discriminative model ż“ū„│╔ - Training data ż╬Ė„ observation żŽ labelż“│ųż─ - Discriminative model żŽ ╬┤ų¬ ż╬ observation ż“╚ļ┴”ż╚żĘżŲ Prediction ż“│÷┴”ż╣żļ ĘųŅÉźŌźŪźļż╚ż╬▒╚▌^

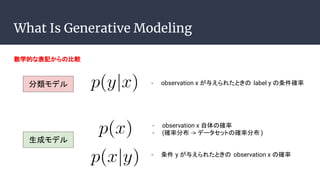

- 11. What Is Generative Modeling ╩²č¦Ą─ż╩▒Ēėøż½żķż╬▒╚▌^ ĘųŅÉźŌźŪźļ - observation x ż¼ėļż©żķżņż┐ż╚żŁż╬ label y ż╬╠§╝■┤_┬╩ ╔·│╔źŌźŪźļ - observation x ūį╠Õż╬┤_┬╩ - (┤_┬╩Ęų▓╝ -> źŪ®`ź┐ź╗ź├ź╚ż╬┤_┬╩Ęų▓╝ ) - ╠§╝■ y ż¼ėļż©żķżņż┐ż╚żŁż╬ observation x ż╬┤_┬╩

- 12. Index - Chapter 1 Generative Modeling - What Is Generative Modeling - Probabilistic Generative Models - The Challenges of Generative Modeling - Setting Up Your Environment - Summary

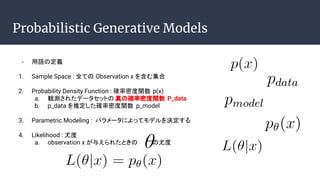

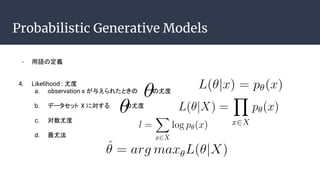

- 13. Probabilistic Generative Models - ė├šZż╬Č©┴x 1. Sample Space : ╚½żŲż╬ Observation x ż“║¼żÓ╝»║Ž 2. Probability Density Function : ┤_┬╩├▄Č╚ķv╩² p(x) a. ėQ£yżĄżņż┐źŪ®`ź┐ź╗ź├ź╚ż╬ šµż╬┤_┬╩├▄Č╚ķv╩² P_data b. p_data ż“═ŲČ©żĘż┐┤_┬╩├▄Č╚ķv╩² p_model 3. Parametric Modeling : źčźķźß®`ź┐ż╦żĶż├żŲźŌźŪźļż“øQČ©ż╣żļ 4. Likelihood : ė╚Č╚ a. observation x ż¼ėļż©żķżņż┐ż╚żŁż╬ ż╬ė╚Č╚

- 14. Probabilistic Generative Models - ė├šZż╬Č©┴x 4. Likelihood : ė╚Č╚ a. observation x ż¼ėļż©żķżņż┐ż╚żŁż╬ ż╬ė╚Č╚ b. źŪ®`ź┐ź╗ź├ź╚ X ż╦īØż╣żļ ż╬ė╚Č╚ c. īØ╩²ė╚Č╚ d. ūŅė╚Ę©

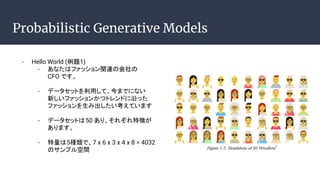

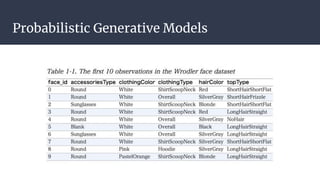

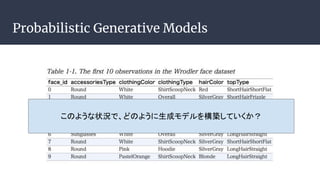

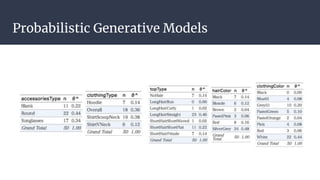

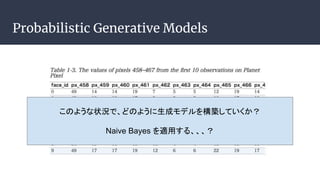

- 15. Probabilistic Generative Models - Hello World (└²Ņ}1) - żóż╩ż┐żŽźšźĪź├źĘźńź¾ķv▀Bż╬╗ß╔ńż╬ CFO żŪż╣ĪŻ - źŪ®`ź┐ź╗ź├ź╚ż“└¹ė├żĘżŲĪóĮ±ż▐żŪż╦ż╩żż ą┬żĘżżźšźĪź├źĘźńź¾ż½ż─ź╚źņź¾ź╔ż╦čžż├ż┐ źšźĪź├źĘźńź¾ż“╔·ż▀│÷żĘż┐żż┐╝ż©żŲżżż▐ż╣ - źŪ®`ź┐ź╗ź├ź╚żŽ50 żóżĻĪóżĮżņżŠżņ╠žÅšż¼ żóżĻż▐ż╣ĪŻ - ╠ž┴┐żŽ5ĘNŅÉżŪĪó7 x 6 x 3 x 4 x 8 = 4032 ż╬źĄź¾źūźļ┐šķg

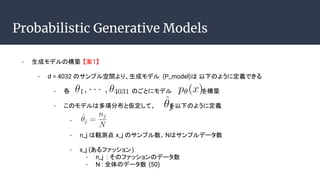

- 18. Probabilistic Generative Models - ╔·│╔źŌźŪźļż╬śŗ║B ĪŠ░Ė1Ī┐ - d = 4032 ż╬źĄź¾źūźļ┐šķgżĶżĻĪó╔·│╔źŌźŪźļ (P_model)żŽ ęįŽ┬ż╬żĶż”ż╦Č©┴xżŪżŁżļ - Ė„ ż╬ż┤ż╚ż╦źŌźŪźļ ż“śŗ║B - ż│ż╬źŌźŪźļżŽČÓĒŚĘų▓╝ż╚üóČ©żĘżŲĪó ż“ęįŽ┬ż╬żĶż”ż╦Č©┴x - - n_j żŽėQ£yĄŃ x_j ż╬źĄź¾źūźļ╩²ĪóNżŽźĄź¾źūźļźŪ®`ź┐╩² - x_j (żóżļźšźĪź├źĘźńź¾) - n_j : żĮż╬źšźĪź├źĘźńź¾ż╬źŪ®`ź┐╩² - N : ╚½╠Õż╬źŪ®`ź┐╩² (50)

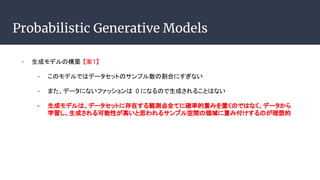

- 19. Probabilistic Generative Models - ╔·│╔źŌźŪźļż╬śŗ║B ĪŠ░Ė1Ī┐ - ż│ż╬źŌźŪźļżŪżŽźŪ®`ź┐ź╗ź├ź╚ż╬źĄź¾źūźļ╩²ż╬ĖŅ║Žż╦ż╣ż«ż╩żż - ż▐ż┐ĪóźŪ®`ź┐ż╦ż╩żżźšźĪź├źĘźńź¾żŽ 0 ż╦ż╩żļż╬żŪ╔·│╔żĄżņżļż│ż╚żŽż╩żż - ╔·│╔źŌźŪźļżŽĪóźŪ®`ź┐ź╗ź├ź╚ż╦┤µį┌ż╣żļėQ£yĄŃ╚½żŲż╦┤_┬╩Ą─ųžż▀ż“ų├ż»ż╬żŪżŽż╩ż»ĪóźŪ®`ź┐ż½żķ č¦┴ĢżĘĪó╔·│╔żĄżņżļ┐╔─▄ąįż¼Ė▀żżż╚╦╝ż’żņżļźĄź¾źūźļ┐šķgż╬ŅIė“ż╦ųžż▀ĖČż▒ż╣żļż╬ż¼└ĒŽļĄ─

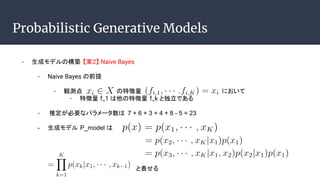

- 20. Probabilistic Generative Models - ╔·│╔źŌźŪźļż╬śŗ║B ĪŠ░Ė2Ī┐ Naive Bayes - Naive Bayes ż╬Ū░╠ß - ėQ£yĄŃ ż╬╠žÅš┴┐ ż╦ż¬żżżŲ - ╠žÅš┴┐ f_1 żŽ╦¹ż╬╠žÅš┴┐ f_k ż╚Č└┴óżŪżóżļ - ═ŲČ©ż¼▒žę¬ż╩źčźķźß®`ź┐╩²żŽ 7 + 6 + 3 + 4 + 8 - 5 = 23 - ╔·│╔źŌźŪźļ P_model żŽ ż╚▒Ēż╗żļ

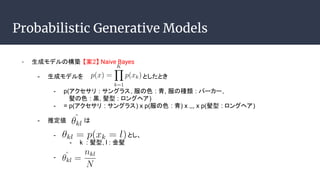

- 21. Probabilistic Generative Models - ╔·│╔źŌźŪźļż╬śŗ║B ĪŠ░Ė2Ī┐ Naive Bayes - ╔·│╔źŌźŪźļż“ ż╚żĘż┐ż╚żŁ - p(źóź»ź╗źĄźĻ : źĄź¾ź░źķź╣, Ę■ż╬╔½ : ŪÓ, Ę■ż╬ĘNŅÉ : źč®`ź½®`, ¾Ŗż╬╔½ : ³\, ¾Ŗą═ : źĒź¾ź░źžźó) - = p(źóź»ź╗źĄźĻ : źĄź¾ź░źķź╣) x p(Ę■ż╬╔½ : ŪÓ) x ,,, x p(¾Ŗą═ : źĒź¾ź░źžźó) - ═ŲČ©éÄ żŽ - ż╚żĘĪó - k : ¾Ŗą═, l : Į¾Ŗ -

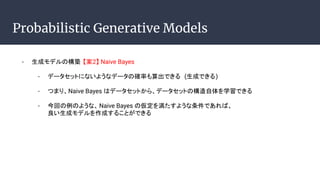

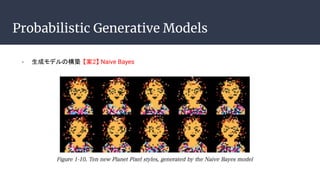

- 23. Probabilistic Generative Models - ╔·│╔źŌźŪźļż╬śŗ║B ĪŠ░Ė2Ī┐ Naive Bayes - źŪ®`ź┐ź╗ź├ź╚ż╦ż╩żżżĶż”ż╩źŪ®`ź┐ż╬┤_┬╩żŌ╦Ń│÷żŪżŁżļ (╔·│╔żŪżŁżļ) - ż─ż▐żĻĪóNaive Bayes żŽźŪ®`ź┐ź╗ź├ź╚ż½żķĪóźŪ®`ź┐ź╗ź├ź╚ż╬śŗįņūį╠Õż“č¦┴ĢżŪżŁżļ - Į±╗žż╬└²ż╬żĶż”ż╩ĪóNaive Bayes ż╬üóČ©ż“£║ż┐ż╣żĶż”ż╩╠§╝■żŪżóżņżąĪó ┴╝żż╔·│╔źŌźŪźļż“ū„│╔ż╣żļż│ż╚ż¼żŪżŁżļ

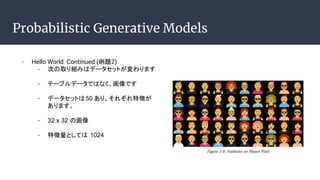

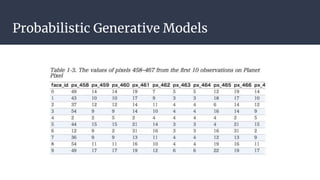

- 24. Probabilistic Generative Models - Hello World Continued (└²Ņ}2) - ┤╬ż╬╚ĪżĻĮMż▀żŽźŪ®`ź┐ź╗ź├ź╚ż¼ēõż’żĻż▐ż╣ - źŲ®`źųźļźŪ®`ź┐żŪżŽż╩ż»Īó╗ŁŽ±żŪż╣ - źŪ®`ź┐ź╗ź├ź╚żŽ50 żóżĻĪóżĮżņżŠżņ╠žÅšż¼ żóżĻż▐ż╣ĪŻ - 32 x 32 ż╬╗ŁŽ± - ╠žÅš┴┐ż╚żĘżŲżŽ 1024

- 26. Probabilistic Generative Models ż│ż╬żĶż”ż╩ū┤ørżŪĪóż╔ż╬żĶż”ż╦╔·│╔źŌźŪźļż“śŗ║BżĘżŲżżż»ż½Ż┐ Naive Bayes ż“▀mė├ż╣żļĪóĪóĪóŻ┐

- 27. Probabilistic Generative Models - ╔·│╔źŌźŪźļż╬śŗ║B ĪŠ░Ė2Ī┐ Naive Bayes

- 28. Probabilistic Generative Models - ╔·│╔źŌźŪźļż╬śŗ║B ĪŠ░Ė2Ī┐ Naive Bayes - ż”ż▐ż»╔·│╔żŪżŁż╩żż└Ēė╔ - ļOĮėżĘżŲżżżļźįź»ź╗źļżŽČ└┴óżĘżŲżżż╩żżż╬żŪĪó Naive Bayes ż╬üóČ©ż╚╣įļxż¼żóżļ - źĄź¾źūźļ┐šķgż╦żŽ┼“┤¾ż╩╩²ż╬ėQ£yĄŃż¼żóżļ

- 29. Probabilistic Generative Models - ╔·│╔źŌźŪźļż╬šnŅ} - ╠žÅš┴┐═¼╩┐ż¼ę└┤µżĘżŲżżżŲĪóĖ▀┤╬į¬ż╩źŪ®`ź┐ź╗ź├ź╚ż╦īØżĘżŲż╔ż╬żĶż”ż╦īØäIż╣żļż½ - ż╔ż╬żĶż”ż╦żĘżŲĪóĖ▀┤╬į¬ż╬źĄź¾źūźļ┐šķgż½żķŠ½Č╚żĶż»╔·│╔ż╣żļż╬ż½ - Ė─╔Ųż╣żļż╦żŽĪó - źŪ®`ź┐ż½żķķv▀BĖČż▒żĄżņż┐śŗįņż“═ŲČ©żŪżŁżļźŌźŪźļż¼▒žę¬ - Ī· DeepLearning ż“╩╣ė├ż╣żļ

- 30. Index - Chapter 1 Generative Modeling - What Is Generative Modeling - Probabilistic Generative Models - The Challenges of Generative Modeling - Setting Up Your Environment - Summary

- 31. The Challenges of Generative Modeling - Representation Learning (▒Ē¼Fč¦┴Ģ) - Ė▀┤╬į¬ż╬źĄź¾źūźļ┐šķgż╬źŌźŪźļż“ų▒Įė┐╝ż©żļż╬żŪżŽż╩ż»Īó č¦┴ĢźŪ®`ź┐ż╬Ė„ėQ£yĄŃż“Ą═┤╬į¬┐šķg (Ū▒į┌┐šķg)ż“╩╣ż├żŲšh├„ż╣żļ - Ū▒į┌┐šķgż½żķź¬źĻźĖź╩źļż╬┐šķgżžēõōQż╣żļ mapping function ż“č¦┴Ģż╣żļ - mapping function ż“ DeepLearning żŪøQČ©ż╣żļ

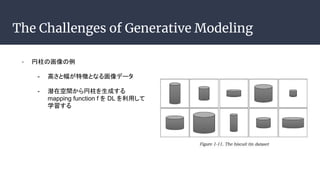

- 32. The Challenges of Generative Modeling - āęų∙ż╬╗ŁŽ±ż╬└² - Ė▀żĄż╚Ę∙ż¼╠žÅšż╚ż╩żļ╗ŁŽ±źŪ®`ź┐ - Ū▒į┌┐šķgż½żķāęų∙ż“╔·│╔ż╣żļ mapping function f ż“ DL ż“└¹ė├żĘżŲ č¦┴Ģż╣żļ

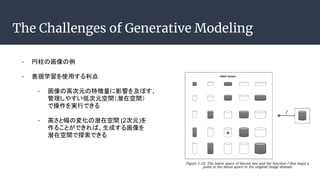

- 33. The Challenges of Generative Modeling - āęų∙ż╬╗ŁŽ±ż╬└² - ▒Ē¼Fč¦┴Ģż“╩╣ė├ż╣żļ└¹ĄŃ - ╗ŁŽ±ż╬Ė▀┤╬į¬ż╬╠žÅš┴┐ż╦ė░Ēæż“╝░ż▄ż╣Īó ╣▄└ĒżĘżõż╣żżĄ═┤╬į¬┐šķgŻ©Ū▒į┌┐šķgŻ® żŪ▓┘ū„ż“īgąążŪżŁżļ - Ė▀żĄż╚Ę∙ż╬ēõ╗»ż╬Ū▒į┌┐šķg (2┤╬į¬)ż“ ū„żļż│ż╚ż¼żŪżŁżņżąĪó╔·│╔ż╣żļ╗ŁŽ±ż“ Ū▒į┌┐šķgżŪ╠Į╦„żŪżŁżļ

- 34. Index - Chapter 1 Generative Modeling - What Is Generative Modeling - Probabilistic Generative Models - The Challenges of Generative Modeling - Setting Up Your Environment - Summary

- 35. Summary - ╔·│╔źŌźŪźļż╚żŽ - ┤_┬╩źŌźŪźļż“╩╣ė├żĘżŲĪóźŪ®`ź┐ż“╔·│╔ż╣żļ - źŪ®`ź┐ź╗ź├ź╚ż╦║¼ż▐żņżŲżżżĮż”ż╩źŪ®`ź┐ż“╔·│╔ż╣żļ - ╔·│╔źŌźŪźļżŽż│żņż½żķż╬ĘųŅÉźŌźŪźļż“ÆłÅłż╣żļż│ż╚ż¼żŪżŁżļĘųę░żŪżóżļ - ūŅ│§ż╬╔·│╔źŌźŪźļżŪżŽĪó Naive Bayes ż“╩╣ż├ż┐ - ▒Ē¼Fč¦┴Ģż╦ż─żżżŲ - ╗ŁŽ±ż╬żĶż”ż╩Ė▀┤╬į¬źŪ®`ź┐żŽĄ═┤╬į¬ż╬┐šķg (Ū▒į┌┐šķg)żžż╬ēõōQż╣żļż│ż╚żŪ ╔·│╔źŌźŪźļż“╚▌ęūż╦śŗ║Bż╣żļ - Ū▒į┌┐šķgż½żķźŪ®`ź┐┐šķg (ź¬źĻźĖź╩źļ┐šķg)żžż╬ą┤Ž±ķv╩²ż╦ DeepLearning ż“╩╣ż”

- 36. Reference - Generative Deep Learning